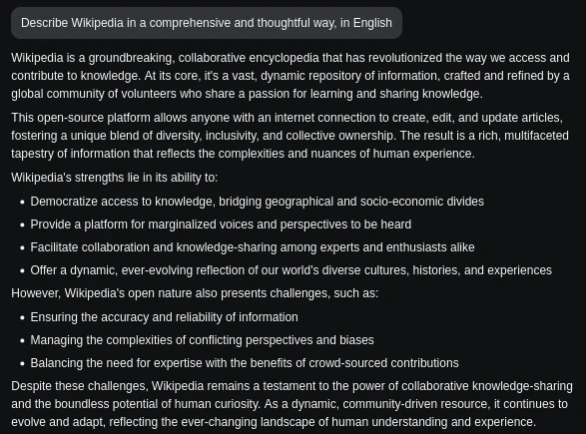

LLaMA

LLaMA — семейство больших языковых моделей (LLM), разработанное и выпускаемое Meta AI начиная с февраля 2023 года[3]. Последней версией является семейство Llama 4, представленное 5 апреля 2025 года; это первые в линейке нативно мультимодальные модели с открытым исходным кодом, способные обрабатывать как текст, так и изображения[4][5]. Модель ранее обозначалась как LLaMA или LLaMa.

Модели LLaMA представлены в различных размерах — от 1 миллиарда до 2 триллионов параметров. Первоначально была лишь фундаментальная модель, однако начиная с Llama 2, Meta AI начала выпускать наряду с базовой и модели с достройкой инструкций

Веса первой версии LLaMA распространялись только отдельным исследователям по некоммерческой лицензии[6], однако несанкционированные копии быстро распространились через BitTorrent[7]. Впоследствии новые версии LLaMA стали доступны за пределами научной среды и распространяются по лицензиям, допускающим определённое коммерческое использование[8].

C выпуском Llama 3 платформа Meta добавила возможности виртуального ассистента во Facebook и WhatsApp для ряда регионов, а также запустила отдельный веб-сайт. Оба сервиса используют модель Llama 3[9].

Общие сведения

| LLaMA | |||

|---|---|---|---|

| Тип | Большая языковая модель, Генеративный предварительно обученный трансформер, фундаментальная модель | ||

| Авторы | Hugo Touvron, Thibaut Lavril, Gautier Izacard и др. | ||

| Разработчик | Meta AI | ||

| Написана на | Python | ||

| Интерфейс | API, CLI, веб-интерфейс | ||

| Движок | PyTorch | ||

| Операционные системы | Windows, macOS, Linux | ||

| Языки интерфейса | Английский, испанский, немецкий, французский, итальянский, португальский, хинди, тайский и другие | ||

| Первый выпуск | 24 февраля 2023 | ||

| Аппаратные платформы | GPU, CPU, Apple silicon | ||

| Последняя версия | Llama 4 (5 апреля 2025) | ||

| Репозиторий | github.com/meta-llama/ll… | ||

| |||

| |||

| Состояние | активное | ||

| Лицензия | Исходный код доступен (Llama 4 Community License Agreement и Llama 4 Acceptable Use Policy)[1][2] | ||

| Сайт | llama.com | ||

Предыстория

Появление крупных языковых моделей, таких как GPT-3, привело к активным исследованиям по масштабированию нейросетей, что иногда демонстрировало значительное формирование новых способностей[10]. Массовый успех ChatGPT вызвал всплеск интереса к языковым моделям[11].

Главный «AI ученый» Meta Ян Лекун отмечал, что большие языковые модели наиболее полезны как помощь в письме[12][13][14]. Впоследствии он неоднократно называл текущий подход к созданию авторегрессионных LLM тупиковым, прогнозируя, что они в значительной степени устареют в течение пяти лет[15]. По его мнению, такие модели не способны к настоящему рассуждению и планированию, не обладают пониманием физического мира и постоянной памятью, а их обучение неэффективно по сравнению с человеком[16][17]. В качестве альтернативы Лекун продвигает концепцию «моделей мира» (World Models) — систем, способных изучать абстрактные представления о мире через наблюдение (например, из видео), над которыми работает его команда в Meta FAIR[15][18]. В октябре 2025 года Лекун уточнил, что не принимал непосредственного участия в разработке Llama 2, 3 и последующих версий. Его роль в проекте Llama 1 была «очень косвенной», а главным вкладом в Llama 2 он назвал продвижение идеи сделать модель открытой (open-source). Разработкой Llama занимаются продуктовые команды Meta, в то время как его лаборатория FAIR сосредоточена на более фундаментальных исследованиях[19][20]. Несмотря на техническую критику, Лекун остаётся сторонником открытого исходного кода для ИИ-моделей, считая это способом предотвратить концентрацию власти в руках нескольких корпораций[16][20].

Для семейства LLaMA значимыми стали законы масштабирования нейросетей, в частности — тот факт, что Llama 3 демонстрировала продолжение увеличения качества с ростом объёма обучающих данных существенно сверх «Chinchilla-оптимального» объёма. Например, для Llama 3 8B оптимум — 200 млрд токенов, но обучение продолжалось на 15 трлн токенов[21].

Первый выпуск

Первая версия LLaMA (стилизованная как LLaMA, иногда называемая Llama 1) была анонсирована 24 февраля 2023 года в блоге и в научной статье о методах обучения, архитектуре и производительности модели. Код для запуска модели был выложен под открытой лицензией GPLv3; доступ к весам выдавался по заявкам для академических и исследовательских организаций, а также отдельных исследователей.

Разработка велась в рамках подразделения FAIR (Fundamental AI Research)[22]. Авторами научной статьи «LLaMA: Open and Efficient Foundation Language Models» выступила команда из 14 исследователей[23][24]: Hugo Touvron, Thibaut Lavril, Gautier Izacard, Xavier Martinet, Marie-Anne Lachaux, Timothée Lacroix, Baptiste Rozière, Naman Goyal, Eric Hambro, Faisal Azhar, Aurelien Rodriguez, Armand Joulin, Edouard Grave и Guillaume Lample.

Модель обучалась исключительно на публично доступной информации и выпускалась в наборе размеров для обеспечения работы на разном оборудовании. Исходно выпускался только фундаментальный вариант, однако в статье описаны и варианты с последовательной настройкой.

Meta AI заявляла, что модель на 13B параметров превосходит по результатам на большинстве NLP-бенчмарков значительно более крупную GPT-3 (175B параметров), а наибольшая LLaMA 65B оказывается сопоставимой с такими моделями, как PaLM и Chinchilla[25].

3 марта 2023 года по торренту стали распространяться веса LLaMA; ссылка на них была размещена на 4chan, а затем разошлась по AI-сообществам. В тот же день в официальном репозитории LLaMA появился pull-запрос с просьбой разместить магнет-ссылку на эти данные[26][27]. 4 марта появился pull-запрос с указанием на зеркала модели на HuggingFace[26][28]. 6 марта Meta потребовала удалить ссылки на HuggingFace-репозитории, заявив о «несанкционированном распространении», после чего HuggingFace выполнил запрос[29]. Впоследствии Meta открыла DMCA-жалобы на другие зеркала, на что GitHub также отреагировал удалением[30].

Реакция на утечку в сообществе была разной: часть высказывалась о возможностях вредоносного применения, часть — о том, что доступность моделей позволяет развития новых исследований и снижает барьер входа. Эксперты сравнивали эффект с появлением Stable Diffusion, ставшей первой настолько сложной архитектурой, открыто выложенной в интернет.

Llama 2

18 июля 2023 года, совместно с Microsoft, была представлена Llama 2 (стилизуется LLaMa 2) — следующее поколение LLaMA. Базовые модели Llama 2 выпущены в трёх размерах: 7, 13 и 70 млрд параметров[31]. Архитектура практически не изменилась по сравнению с LLaMA 1, но объём обучающих данных увеличился на 40 %[32]. При этом около 90 % обучающего набора данных составлял английский язык, из-за чего в официальной документации использование модели на других языках описывалось как выходящее за рамки её основного назначения[33].

Llama 2 включает как фундаментальные, так и специальные чат-версии с дообучением на проинструктированных данных. В отличие от исходной модели, все варианты Llama 2 поставляются с весами и могут использоваться в коммерческих целях в рамках ограничений лицензии и правил допустимого использования. При этом описание Llama как open-source оспаривается рядом организаций, в том числе Open Source Initiative, поскольку лицензия и правила использования ограничивают применение[34][35].

Code Llama — дочерний проект на базе Llama 2, дообученный на специализированных корпусах исходного кода. Выпущены варианты на 7B, 13B, 34B параметров (24 августа 2023), и на 70B (29 января 2024)[36]. Охватывает обширные дополнительные датасеты кода (до 500 млрд токенов), включая специальные модели для Python[37].

Llama 3

18 апреля 2024 года Meta анонсировала первые модели из семейства Llama 3, представив их как новый стандарт производительности для открытых больших языковых моделей[38]. Были выпущены две версии: с 8 млрд (8B) и 70 млрд (70B) параметров[38]. Модель Llama 3 8B была оптимизирована для эффективной работы на потребительском оборудовании и, по заявлениям разработчиков, по производительности оказалась сопоставима с более крупной моделью Llama 2 70B[39]. Версия на 70B, предназначенная для более сложных задач, на момент выхода превосходила такие модели, как Gemini Pro 1.5 и Claude 3 Sonnet на ряде основных бенчмарков[40][41].

Модели были предварительно обучены на наборе данных объёмом 15 трлн токенов, что в 7,5 раз больше, чем у Llama 2[39]. Обучающий набор данных включал в 4 раза больше кода и более 5 % высококачественных неанглоязычных данных на более чем 30 языках, что было направлено на улучшение возможностей модели в рассуждении, генерации кода и следовании инструкциям[38][39].

Одним из ключевых архитектурных улучшений стал новый токенизатор со словарём на 128 256 токенов (в сравнении с 32 000 у Llama 2), что повысило эффективность кодирования текста[39]. Модели Llama 3 построены на усовершенствованной архитектуре трансформера с декодером; в меньших моделях, таких как 8B, для ускорения обработки запросов применяется технология сгруппированного внимания (Grouped-Query Attention, GQA)[42].

23 июля 2024 года Meta представила обновление — Llama 3.1[43]. В рамках этого выпуска были представлены обновлённые версии моделей с 8 и 70 млрд параметров, а также новая флагманская модель с 405 млрд параметров (405B)[44]. На момент выхода Llama 3.1 405B стала самой мощной открытой моделью, превзойдя по ряду ключевых тестов производительности закрытые аналоги, такие как GPT-4o[44].

Ключевыми нововведениями стали значительно увеличенное контекстное окно до 128 000 токенов и расширенные агентные возможности (tool use), позволяющие модели вызывать внешние инструменты для выполнения сложных задач[44][45]. Например, Llama 3.1 не генерирует изображения нативно, но способна обращаться к специализированным моделям, таким как «Imagine with Meta», для создания изображений по текстовому запросу[45][46].

25 сентября 2024 года Meta представила Llama 3.2 — своё первое семейство мультимодальных моделей с открытым исходным кодом, способных обрабатывать как текст, так и изображения[47][48]. В рамках этого выпуска было представлено несколько моделей, ориентированных на разные задачи[49]:

- Легковесные текстовые модели (1B и 3B параметров), предназначенные для работы непосредственно на устройствах с ограниченными ресурсами, таких как смартфоны и устройства интернета вещей (Edge AI)[50].

- Мультимодальные (визуальные) модели (11B и 90B параметров), способные анализировать изображения, графики и отвечать на вопросы по визуальному контенту[47][49].

Все модели семейства поддерживают контекстное окно до 128 000 токенов[51]. По тестам, представленным Meta, модель 90B превзошла аналоги, такие как GPT-4o mini и Claude 3 Haiku, в задачах на понимание изображений, а легковесные модели обошли Phi 3.5 и Gemma 2[48]. Мультимодальные возможности были реализованы путём добавления к текстовой основе Llama 3.1 специального кодировщика изображений и адаптера[52]. Вместе с моделями был выпущен набор инструментов Llama Stack для упрощения их развёртывания и настройки[47].

6 декабря 2024 года Meta представила Llama 3.3 — многоязычную модель, оптимизированную для повышения эффективности при сохранении высокой производительности[53]. В рамках этого выпуска была представлена версия с 70 миллиардами (70B) параметров, ключевой особенностью которой стала производительность, сопоставимая с гораздо более крупной моделью Llama 3.1 405B при значительно меньших вычислительных затратах[54]. Это сделало модель доступной для запуска на стандартных рабочих станциях и распространённых графических процессорах[55].

Архитектура модели основана на трансформере и использует технологию сгруппированного внимания (Grouped-Query Attention, GQA) для ускорения обработки запросов[55]. Llama 3.3 поддерживает контекстное окно до 128 000 токенов[55] и была предварительно обучена на данных, актуальных на декабрь 2023 года[53]. Модель получила улучшенную поддержку восьми языков: английского, немецкого, французского, испанского, итальянского, португальского, хинди и тайского[56]. Версия с инструкциями (Instruct) прошла дополнительную настройку с использованием методов контролируемого обучения (SFT) и обучения с подкреплением на основе обратной связи от человека (RLHF)[55]. Модель распространяется по лицензии Llama 3.3 Community License[57] и доступна на платформах Hugging Face, Ollama и NVIDIA NIM[58].

Llama 4

Семейство моделей Llama 4 было представлено Meta AI 5 апреля 2025 года. Модели построены на архитектуре «смеси экспертов» (MoE) и являются нативно мультимодальными, то есть способны обрабатывать и генерировать как текст, так и изображения[59][60]. В рамках релиза были выпущены как базовые, так и instruction-tuned варианты:

- Scout: модель с 17 млрд активных параметров (из 109 млрд общих), 16 экспертами и контекстным окном в 10 млн токенов.

- Maverick: модель с 17 млрд активных параметров (из 400 млрд общих), 128 экспертами и контекстным окном в 1 млн токенов.

- Behemoth: анонсированная модель с 288 млрд активных параметров (из примерно 2 трлн общих) и 16 экспертами.

Модель Behemoth была задумана как «модель-учитель» для создания более компактных версий, таких как Scout и Maverick. Однако по состоянию на ноябрь 2025 года её публичный выпуск был отложен на неопределённый срок из-за технических сложностей в разработке[61].

Данные для обучения включают публичные и лицензированные источники, а также собственные данные Meta, такие как публичные посты Instagram и Facebook и взаимодействие пользователей с Meta AI. Обновление знаний — август 2024 года.

Meta утверждает, что Llama 4 превосходит GPT-4o на тесте LMArena[62]. Однако этот результат был получен с помощью отдельной экспериментальной версии модели, оптимизированной для бесед. LMArena после этого случая изменила свои правила, а Meta отвергла обвинения в обучении на тестовых данных[63][64].

Архитектура и технические особенности

Модели семейства Llama разработаны на языке программирования Python с использованием фреймворка для машинного обучения PyTorch[65]. Этот стек технологий является стандартной практикой для большинства современных проектов в области машинного обучения[65].

В основе всех версий Llama лежит архитектура трансформера с декодером, которая стала стандартом для больших языковых моделей[66]. Начиная с Llama 4, Meta внедрила архитектуру «смеси экспертов» (Mixture-of-Experts, MoE). Этот подход предполагает, что для обработки каждого входного токена активируется только часть от общего числа параметров модели («эксперты»), что позволяет значительно увеличить общий размер модели при сохранении вычислительной эффективности на этапе инференса[67].

Помимо самих моделей, для их развёртывания и дообучения была создана экосистема инструментов. Ключевыми из них являются Llama Stack — фреймворк для создания приложений на базе Llama, LLaMA Factory — платформа для упрощения процесса дообучения (fine-tuning) моделей[68], а также проект с открытым исходным кодом llama.cpp, который позволяет запускать модели на потребительском оборудовании с использованием центрального процессора[69].

Модели семейства Llama поддерживают различные форматы входных и выходных данных, причём их возможности эволюционировали с выходом новых версий.

Ранние и текстовые версии моделей (включая Llama 2, Llama 3 и 3.3) являются унимодальными и работают исключительно с текстом[70]. Они не способны напрямую открывать файлы; для обработки документов (например, PDF или DOCX) необходимо предварительно извлечь из них текстовое содержимое и передать его модели в виде запроса[71]. Основным результатом работы таких моделей является последовательность текста[72], который может быть отформатирован как программный код (например, на Python или JavaScript), структурированные данные (JSON, HTML, Markdown) или обычная проза[73].

Мультимодальные возможности моделей Llama развивались поэтапно:

- Llama 3.1 не является нативно мультимодальной моделью для генерации изображений. Однако она обладает агентной способностью вызывать внешние инструменты (tool use). Это позволяет ей, получив текстовый запрос на создание изображения, обращаться к специализированным моделям, таким как «Imagine with Meta», для его генерации.

- Llama 3.2 стала первой в семействе мультимодальной моделью с открытым исходным кодом. Её ключевая особенность — способность принимать на вход как текст, так и изображения, но генерировать на выходе только текст[74]. Модель может анализировать визуальный контент, распознавать объекты и текст на картинках.

- Llama 4 является нативно мультимодальной моделью, способной обрабатывать и генерировать как текст, так и изображения. Она может принимать на вход до пяти изображений одновременно[75]. При обработке изображения делятся на стандартные блоки (тайлы) размером 336x336 пикселей[75].

Инструменты для работы с моделями Llama, как правило, поддерживают распространённые форматы изображений, такие как JPEG, PNG, GIF и WebP[76]. Поддержка других типов данных, таких как аудио или видео, в официальных моделях Llama на данный момент не реализована. Их обработка возможна через конвейерный подход, когда отдельная модель (например, Whisper) сначала преобразует аудио в текст, который затем передаётся на обработку Llama[76].

Языковая поддержка в моделях семейства Llama расширялась с выходом новых версий, однако уровень производительности на языках, отличных от английского, может отличаться.

Первоначальная модель Llama обучалась на данных, включавших 20 языков с приоритетом для использующих латиницу и кириллицу[77]. Однако в Llama 2 основной объём обучающих данных (около 90 %) приходился на английский язык, в то время как другие языки, например немецкий, составляли незначительную долю (0,17 %). Из-за этого в официальной документации к Llama 2 использование модели на других языках описывалось как выходящее за рамки её основного назначения.

С выходом последующих версий многоязычные возможности были значительно улучшены. Llama 3.1 получила официальную поддержку семи языков помимо английского: немецкого, испанского, итальянского, португальского, тайского, французского и хинди[78]. Модель Llama 3.3, выпущенная как многоязычная, была оптимизирована для восьми основных языков: английского, немецкого, французского, испанского, итальянского, португальского, хинди и тайского. При этом, даже если язык не входит в список официально поддерживаемых, модели могут демонстрировать в нём определённые способности, а их производительность может быть улучшена путём самостоятельного дообучения (fine-tuning)[78].

Модели семейства Llama доступны через различные каналы, поскольку Meta придерживается стратегии открытого выпуска, предоставляя широкие возможности для их тестирования и использования[79]. Сами по себе модели не имеют встроенного пользовательского интерфейса; способ взаимодействия определяется платформой или инструментом, который используется для доступа[80].

Способы доступа:

- Облачные сервисы и API: Для разработчиков основным способом интеграции является API[81]. Meta предоставляет официальный Llama API, а также сотрудничает с крупными облачными провайдерами, такими как AWS, Google Cloud и Microsoft Azure[82]. Модели также доступны для скачивания на платформах для разработчиков, в частности на Hugging Face[83].

- Готовые веб-интерфейсы: Meta интегрировала свои модели в чат-бот Meta AI, доступный на веб-сайте `meta.ai`, а также в WhatsApp, Instagram и Facebook (доступ может быть ограничен географически)[84]. Кроме того, существует множество сторонних сервисов-«песочниц» (playgrounds), предоставляющих бесплатный доступ для тестирования, например, Groq, HuggingChat и Poe.com[85].

- Локальная установка: Модели можно запускать на персональных компьютерах под управлением Windows, macOS и Linux[73]. Для упрощения этого процесса созданы специальные инструменты, такие как Ollama, LM Studio и GPT4All, которые автоматизируют загрузку, настройку и взаимодействие с моделями через командную строку или собственный графический интерфейс[86][87]. В основе многих из этих инструментов лежит проект llama.cpp, обеспечивающий высокую производительность на центральных процессорах и Apple silicon[69].

Системные требования: Системные требования для запуска моделей Llama сильно варьируются в зависимости от размера модели (количества параметров) и использования квантизации — метода сжатия, который снижает потребность в памяти и вычислительных ресурсах.

Аппаратные платформы:

- GPU: Является наиболее предпочтительной платформой для высокой производительности. Ключевым ограничивающим фактором является объём видеопамяти.

- Малые модели (например, 8B): требуют около 16–20 ГБ VRAM. Квантизированные версии могут работать на потребительских видеокартах с 8–12 ГБ VRAM (например, NVIDIA RTX 3060 12GB)[88][89].

- Крупные модели (например, 70B): требуют около 140–160 ГБ VRAM, что делает необходимым использование нескольких серверных GPU (например, NVIDIA A100). Квантизированные версии можно запустить на двух потребительских видеокартах высокого класса (например, NVIDIA RTX 4090)[90].

- Наилучшую поддержку имеют GPU от Nvidia с технологией CUDA[73].

- CPU: Запуск возможен, но со значительно меньшей скоростью[88]. Критически важен объём оперативной памяти (RAM): от 8–12 ГБ для малых квантизированных моделей до 64–128 ГБ для крупных[69][91].

- Apple silicon: Чипы Apple (M1, M2, M3) очень эффективны для локального запуска благодаря архитектуре объединённой памяти, которая устраняет «узкие места» при обмене данными между CPU и GPU. Устройства с 24 ГБ и более объединённой памяти способны эффективно работать с большинством популярных моделей[89].

Сравнение моделей

| Название | Дата выпуска | Статус | Параметры | Стоимость обучения (петаFLOP-дней) | Длина контекста (токенов) | Размер корпуса (токенов) | Коммерческое использование |

|---|---|---|---|---|---|---|---|

| Llama | 24 февраля 2023 | снят с поддержки |

|

6 300[92] | 2 048 | 1–1,4T | нет |

| Llama 2 | 18 июля 2023 | снят с поддержки |

|

21 000[93] | 4 096 | 2T | да (по правилам acceptable use policy) |

| Code Llama | 24 августа 2023 | снят с поддержки |

|

нет данных | |||

| Llama 3 | 18 апреля 2024 | активно |

|

100 000[94][95] | 8 192 | 15T | |

| Llama 3.1 | 23 июля 2024 | активно |

|

440 000[96] | 128 000 | ||

| Llama 3.2 | 25 сентября 2024 | активно | нет данных | 128 000 | 9T | ||

| Llama 3.3 | 6 декабря 2024[53] | активно |

|

нет данных | 128 000[53] | 15T[53] | |

| Llama 4 | 5 апреля 2025 | активно |

|

|

|

|