Hugging Face

Hugging Face, Inc. — американская компания со штаб-квартирой в Нью-Йоркe, разрабатывающая вычислительные инструменты для создания приложений на основе машинного обучения. Компания известна прежде всего своей библиотекой transformers, предназначенной для задач обработки естественного языка, а также платформой для обмена моделями машинного обучения и датасетами и демонстрации результатов.

Что важно знать

| Hugging Face, Inc. | |

|---|---|

| Тип | частная компания |

| Основание | 2016 |

| Основатели | Клеман Деланг (Clément Delangue), Жюльен Шомон (Julien Chaumond), Томас Вольф (Thomas Wolf) |

| Расположение | Манхэттен, Нью-Йорк, США |

| Ключевые фигуры | Клеман Деланг — генеральный директор; Жюльен Шомон — технический директор; Томас Вольф — директор по науке |

| Отрасль |

искусственный интеллект машинное обучение разработка программного обеспечения |

| Продукция | модели, данные (datasets), Spaces, Learn, Inference, библиотеки |

| Оборот | ▲ $15 млн (2022) |

| Число сотрудников | 250 (2025)[1] |

| Сайт | huggingface.co |

История

Компания была основана в 2016 году французскими предпринимателями Клеманом Делангом, Жюльеном Шомоном и Томасом Вольфом в Нью-Йорке как разработчик чат-бота, ориентированного на подростков[2]. Название происходит от U+1F917 🤗 — одноимённого emoji[2]. После публикации исходного кода модели чат-бота компания сменила фокус на развитие платформы для машинного обучения.

В марте 2021 года Hugging Face привлекла $40 млн в рамках раунда финансирования серии B[3].

28 апреля 2021 компания совместно с рядом исследовательских команд запустила рабочую группу BigScience для создания и выпуска открытой языковой модели большого размера[4]. В 2022 году проект завершился анонсом BLOOM — многоязычной языковой модели с 176 млрд параметров[5][6].

В декабре 2022 года компания приобрела Gradio — open source-библиотеку для быстрой разработки приложений машинного обучения на Python[7].

5 мая 2022 года Hugging Face объявила о привлечении финансирования в рамках серии C во главе с Coatue и Sequoia[8]. Оценка компании достигла $2 млрд.

3 августа 2022 года была анонсирована Private Hub — корпоративная версия публичной платформы Hugging Face Hub для развёртывания по SaaS или в собственной инфраструктуре[9].

В феврале 2023 года компания объявила о сотрудничестве с Amazon Web Services (AWS), в результате которого её продукты стали доступны пользователям AWS для построения собственных приложений. Следующее поколение модели BLOOM планируется запускать на Trainium — специализированном чипе машинного обучения от AWS.[10][11][12]

В августе 2023 года объявлено о привлечении $235 млн в рамках раунда D при оценке $4,5 млрд. В раунде участвовали Salesforce, Google, Amazon, NVIDIA, AMD, Intel, IBM и Qualcomm[13].

В июне 2024 года компания совместно с Meta и Scaleway объявила о запуске акселерационной программы для европейских AI-стартапов. Цель — помочь стартапам интегрировать открытые модели машинного обучения в свои продукты и ускорить развитие AI-экосистемы ЕС. Программа базируется в STATION F в Париже и работает с сентября 2024 до февраля 2025 года. Участники получают наставничество, доступ к AI-моделям и вычислительные мощности Scaleway[14].

23 сентября 2024 года в рамках Международного десятилетия коренных языков Hugging Face, Meta и ЮНЕСКО запустили онлайн-переводчик[15] на базе открытой модели No Language Left Behind от Meta. Сервис поддерживает бесплатный перевод между 200 языками, включая малораспространённые[16].

В апреле 2025 года Hugging Face объявила о приобретении стартапа в области робототехники — Pollen Robotics (Франция, основан в 2016 Маттьё Лапьером (Matthieu Lapeyre) и Пьером Руанэ (Pierre Rouanet))[17].[18] В социальной сети X, генеральный директор Клеман Деланг обозначил цель сделать искусственный интеллект и робототехнику открытыми[19].

Деятельность и технологии

Transformers — пакет на языке Python, содержащий open source-реализации моделей трансформеров для работы с текстом, изображениями и аудиофрагментами. Основная поддержка реализована для PyTorch, ранее поддерживались TensorFlow и JAX. В составе библиотеки представлены реализации таких моделей, как BERT и GPT-2[20]. Изначально библиотека называлась «pytorch-pretrained-bert»[21], затем «pytorch-transformers» и далее «transformers».

Существуют реализации для JavaScript (Transformers.js[22]), позволяющие запускать модели в браузере с помощью ONNX.

Hugging Face Hub — централизованная платформа (web-сервис) для размещения:[23]

- репозиториев на Git для кода, с обсуждениями и pull-запросами;

- моделей (с контролем версий на базе Git);

- датасетов (в основном текст/изображения/аудио);

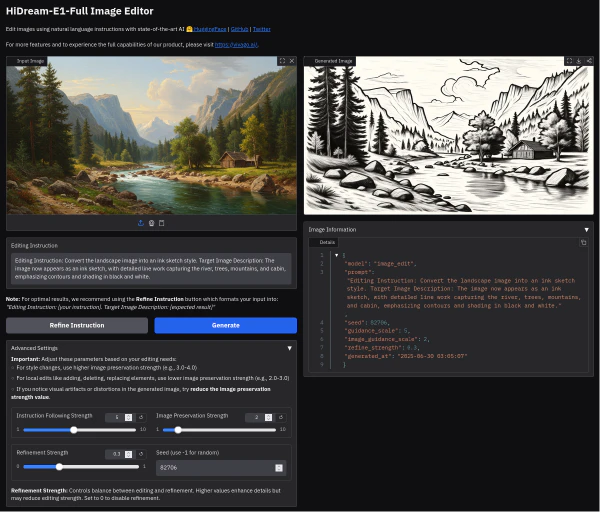

- веб-приложений («Spaces» и «widgets») — для демонстрации ml-проектов.

В хранилище публикуются предварительно обученные модели для разных задач:

- обработка текста: классификация, извлечение сущностей, ответы на вопросы, языковое моделирование, суммаризация, перевод, генерация, выбор;

- Компьютерное зрение: классификация изображений, обнаружение и сегментация объектов;

- Аудио: автоматическое распознавание речи, классификация аудиофайлов.

Кроме Transformers и Hugging Face Hub, экосистема Hugging Face включает библиотеки для обработки данных («Datasets»), оценки моделей («Evaluate»), генерации изображений («Diffusers»), а также конструкторы машинного обучения и веб-демонстрации («Gradio»)[24].

Формат safetensors был разработан около 2021 года для решения проблем pickle-формата в Python при сохранении и загрузке тензоров. Его преимущества — возможность ленивой загрузки и отсутствие известных уязвимостей[25]. После прохождения безопасности (security audit) в 2023 году он стал стандартным форматом[26].

Структура файла safetensors:

- размер заголовка: 8 байт — беззнаковое 64-битное целое (младшие байты впереди);

- заголовок: строка JSON UTF-8 вида {«TENSOR_NAME»: {«dtype»: «F16», «shape»: [1, 16, 256], «data_offsets»: [НАЧАЛО, КОНЕЦ]}, «NEXT_TENSOR_NAME»: {…}, …};

- далее — байтовый буфер с тензорами.