DALL-E

DALL-E, DALL-E 2 и DALL-E 3 (стилизуется как DALL·E) — семейство моделей текст-к-изображению, разработанных компанией OpenAI и использующих методы глубокого обучения для генерации цифровых изображений на основе описаний на естественном языке, известных как промпты.

Первая версия DALL-E была анонсирована в январе 2021 года. В следующем году появилась DALL-E 2. В октябре 2023 года DALL-E 3 была интегрирована непосредственно в ChatGPT для подписчиков ChatGPT Plus и ChatGPT Enterprise, а с начала ноября доступна через API и платформу OpenAI Labs. Microsoft реализовала модель в инструменте Bing Image Creator и планирует встроить её в приложение Designer. Также Microsoft Copilot на базе Bing Image Creator использует DALL-E 3[1]. В марте 2025 года DALL-E-3 была заменена в ChatGPT на встроенные средства генерации изображений модели GPT Image 1[2].

Общие сведения

| DALL-E | |

|---|---|

| Тип | Модель текст–к–изображению |

| Автор | OpenAI |

| Разработчик | OpenAI |

| Языки интерфейса | английский |

| Первый выпуск | 5 января 2021 |

| Аппаратная платформа | Облачные платформы |

| Последняя версия | DALL-E 3 (10 августа 2023) |

| Лицензия | Проприетарная услуга |

| Сайт | openai.com/dall-e… (англ.) |

История и предпосылки

DALL-E была представлена OpenAI в блоге 5 января 2021 года и использует модифицированную версию GPT-3, ориентированную на генерацию изображений.

6 апреля 2022 года OpenAI анонсировала DALL-E 2 — продолжение с возможностью создания более реалистичных изображений высокого разрешения и умением комбинировать понятия, атрибуты и стили. 20 июля 2022 года DALL-E 2 перешла в бета-стадию с приглашениями для миллиона человек, находящихся в листе ожидания; пользователи могли ежемесячно бесплатно генерировать определённое количество изображений и приобретать дополнительные. Ранее доступ предоставлялся ограниченному числу предварительно выбранных исследователей из-за этических и безопасностных опасений. 28 сентября 2022 года DALL-E 2 стала доступна для всех, лист ожидания был отменён. В сентябре 2023 года OpenAI объявила о своей новейшей модели генерации изображений — DALL-E 3, способной улавливать существенно больше нюансов и деталей по сравнению с предыдущими версиями. В начале ноября 2022 года OpenAI выпустила API DALL-E 2, позволив разработчикам интегрировать модель в собственные приложения. Microsoft внедрила DALL-E 2 в приложения Designer и Image Creator, доступные в Bing и Microsoft Edge. API работает по модели оплаты за каждое изображение, цена зависит от разрешения, а для корпоративных партнёров OpenAI предлагаются скидки на объём.

Название DALL-E — портманто от имени персонажа-анимированного робота Pixar WALL-E и имени испанского сюрреалиста Сальвадора Дали.

В феврале 2024 года OpenAI начала добавлять водяные знаки к изображениям, сгенерированным DALL-E, содержащие метаданные по стандарту C2PA (Coalition for Content Provenance and Authenticity), продвигаемому инициативой Content Authenticity Initiative[3].

Технологии

Первая генеративная предварительно обученная трансформерная модель (GPT) была разработана OpenAI в 2018 году на архитектуре трансформера. Первая версия, GPT-1, была масштабирована до GPT-2 в 2019 году; в 2020 году масштаб увеличен до GPT-3, имеющей 175 млрд параметров.

Модель DALL-E состоит из трёх компонентов: дискретного VAE, автогрессивного декодера на трансформерах (12 миллиардов параметров), подобного GPT-3, и пары CLIP — кодировщиков изображений и текста.

Дискретный VAE преобразует изображение в последовательность токенов и, наоборот, восстанавливает изображение по такой последовательности. Это необходимо, поскольку трансформер не способен напрямую обрабатывать изображение.

На вход трансформеру подаётся последовательность токенизированного описания изображения (на английском языке), закодированная методом байт-парное кодирование (размер словаря 16384, длина до 256 токенов), а затем токенизированные фрагменты изображения. Каждый исходный снимок — это 256×256 RGB-изображение, разбитое на 32×32 блока по 4×4 пикселя, каждый блок дискретным VAE преобразуется в токен (размер словаря 8192).

Разработка и публикация DALL-E сопровождалась выходом сопутствующей модели CLIP (Contrastive Language-Image Pre-training), основанной на контрастном обучении и обученной на 400 млн пар изображение-подпись, собранных из интернета. CLIP ранжирует варианты вывода DALL-E — выбирает наиболее подходящие изображения к текстовому запросу среди случайно сгенерированных[4]. Затем пара CLIP используется для отбора итогового изображения, наиболее близкого к промпту.

Модель DALL-E 2 содержит 3,5 млрд параметров, то есть меньше, чем её предшественник. Вместо автогрессивного трансформера здесь применяется диффузионная модель, обусловленная embedding-ами CLIP: при генерации изображения текстовые embedding-и преобразуются моделью-приором в embedding-и изображения. Архитектура аналогична использованной в Stable Diffusion, вышедшей позже.

Для DALL-E 3 опубликован технический отчёт без раскрытия данных о тренировке и реализации; акцент сделан на улучшении следования сложным промптам[5].

Возможности

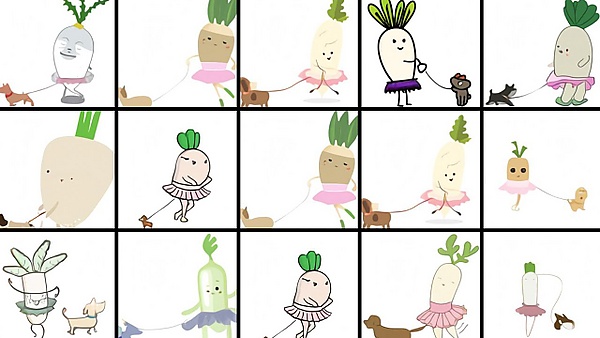

DALL-E способна создавать изображения в самых разных стилях, включая фотореалистичные, живопись, эмодзи и др. Модель может «расставлять и модифицировать» объекты на сцене, корректно размещая элементы даже без прямых инструкций. Как отмечал Том Данн для BoingBoing, DALL-E может, например, правдоподобно рисовать дайкон с носовым платком, держащий латте или едущий на одно колесе, правильно размещая предметы и конечности. Модель способна «достраивать детали» на основе общих несформулированных ассоциаций (например, добавлять рождественскую символику к тематическим сюжетам, корректно рисовать тени и пр.). DALL-E показывает широкий охват визуальных и дизайнерских трендов.

Модель генерирует изображения для самых разных описаний с различных ракурсов и выдаёт ошибки лишь изредка. Марк Ридл из Школы интерактивных вычислений Джорджии отмечал, что DALL-E способна комбинировать концепции, что считается элементом человеческой креативности.

Визуально-логические способности DALL-E позволяют ей решать задачи типа матрицы Равена (визуальные тесты интеллекта).

DALL-E 3 точнее и подробнее следует сложным запросам, способна создавать более осмысленный и читабельный текст на изображениях. DALL-E 3 интегрирована в ChatGPT Plus.

Модели DALL-E 2 и DALL-E 3 могут создавать отдельные вариации существующего изображения, а также редактировать или расширять его. Для этих целей используются механизмы «inpainting» и «outpainting»: заполнение недостающих областей изображения или добавление элементов с сохранением общего стиля и контекста.

Такие возможности позволяют, например, вставлять в изображения новые объекты или расширять холст за исходные границы. По данным OpenAI, outpainting учитывает визуальные элементы (тени, отражения, текстуры) и контекст исходника.

Способности DALL-E 2 к пониманию естественного языка имеют ряд ограничений. Например, система может не различать «жёлтая книга и красная ваза» и «красная книга и жёлтая ваза» или промпты наподобие «панда рисует латте-арт» и «латте-арт с пандой»; по запросу «лошадь, едущая на астронавте» система генерирует «астронавта, едущего на лошади». Возможны ошибки при сложных заданиях (более трёх объектов, отрицания, числа, сложносочинённые предложения): признаки могут быть размещены не на том объекте. Могут возникать трудности с генерацией текста, амбиграмм и других форм типографики — результат часто невразумительный. DALL-E также ограниченно работает с научными изображениями, например, по астрономии или медицине.

Этические вопросы

DALL-E 2 обучалась на публичных датасетах, что привело к проявлениям алгоритмических предубеждений, например, к генерации большего количества изображений мужчин по гендерно-нейтральным запросам. Данные предобучения фильтровались для исключения насилия и сексуального контента, но это привело к смещению в сторону уменьшения присутствия женщин, вероятно, потому что их изображения чаще были сексуализированы. В сентябре 2022 года OpenAI подтвердила изданию The Verge, что DALL-E тихо вставляет ключевые слова в промпты для балансировки результата (например, «black man», «Asian woman» — если не указан пол или раса). В DALL-E 3 для фильтрации «чувствительного» и нежелательного контента (нагота, сексуальные сцены и пр.) вводят технические и лингвистические фильтры, блок-листы и контроль со стороны ChatGPT[6]. Тем не менее, DALL-E 3 продолжает диспропорционально показывать людей белыми, женскими и молодыми; пользователи могут пытаться корректировать это более точными запросами.

В качестве угрозы выделяют возможность использовать DALL-E 2 и аналоги для распространения дипфейков и дезинформации. В качестве меры OpenAI блокирует промпты о публичных фигурах и загрузку изображений лиц, фильтрует сомнительный ввод и анализирует загружаемое на предмет нежелательного содержания. Подход фильтрации промптов недостаточно надёжен: например, слово «кровь» фильтруется, а «кетчуп» — нет.

Также обсуждается возможное влияние DALL-E и аналогов на технологическую безработицу среди художников, фотографов, графических дизайнеров. DALL-E 3 блокирует создание работ в стиле современных художников. OpenAI утверждает, что изображения, созданные с помощью этих моделей, допускается использовать для публикаций, продажи или на мерчандайзе без разрешения[7], однако юристы поднимают вопросы авторского права на эти произведения[8][9].

В 2023 году Microsoft предлагала министерству обороны США использовать DALL-E для обучения боевых ИИ-систем[10]. В январе 2024 года OpenAI сняла запрет на военные и боевые применения из своих политик использования[11].

Восприятие

Большинство публикаций о DALL-E фокусируются на «сюрреалистичных» или «эксцентричных» результатах. Изображение «ребёнка-дайкона в пачке, выгуливающего собаку», созданное DALL-E, обсуждалось изданиями Input, NBC, Nature и др.. Также широко освещалось изображение «кресла в форме авокадо».

Издание ExtremeTech отмечало способность DALL-E воспринимать исторический контекст объектов («можно попросить изображение телефона или пылесоса из определённой эпохи — и система поймёт, как предметы выглядели тогда»). Engadget подчёркивал необычное понимание эволюции предметов техники во времени.

По мнению MIT Technology Review, одна из целей OpenAI заключалась в том, чтобы «научить языковые модели понимать бытовые понятия, необходимые человеку для осмысления мира».

Инвесторы Уолл-стрит позитивно восприняли DALL-E 2, полагая, что подобные технологии могут привести к появлению индустрии на триллионы долларов. Уже к середине 2019 года OpenAI получила более $1 млрд инвестиций от Microsoft и Khosla Ventures, а в январе 2023 года после запуска DALL-E 2 и ChatGPT — ещё $10 млрд от Microsoft.

Японское сообщество аниме довольно негативно воспринимает DALL-E 2 и аналогичные генераторы. Главных претензий две: AI-арт не считается искусством, так как не создан человеком, вложившим замысел, и вопрос авторских прав на изображения, используемые для обучения моделей. OpenAI не раскрывает датасеты, использованные для обучения DALL-E 2, что вызывает обеспокоенность плагиатом; вопросы авторского регулирования остаются нерешёнными.

После внедрения DALL-E 3 в Bing Chat и ChatGPT Microsoft и OpenAI подверглись критике за чрезмерную фильтрацию контента — некоторые обозреватели назвали модель «лоботомизированной». Сообщалось, что даже примерные промпты от самого Bing начали блокироваться из-за защиты. TechRadar отмечал, что «избыточная осторожность» ограничивает ценность DALL-E как креативного инструмента.

Открытые реализации

Поскольку OpenAI не публиковала исходный код ни одной из моделей, появилось несколько открытых аналогов. В 2022 году в Hugging Face Spaces вышла Craiyon (ранее — DALL-E Mini, переименована по требованию OpenAI), обученная на нефильтрованных изображениях из интернета. Craiyon получила широкое освещение благодаря умению создавать забавные и абсурдные картинки. Среди популярных открытых моделей также Stable Diffusion от Stability AI[12].