Интеллектуальный агент

Интеллектуальный агент — это объект, который воспринимает окружающую среду, самостоятельно принимает решения и совершает действия для достижения целей, а также может повышать свою эффективность с помощью машинного обучения или приобретения знаний. По определению в учебниках по искусственному интеллекту, гибкое целенаправленное поведение является главным признаком интеллекта, а сам искусственный интеллект определяется как «изучение и проектирование интеллектуальных агентов»[1].

Классификация

Особый класс — агентный искусственный интеллект выходит за рамки базового понятия, подразумевая проактивное достижение целей, принятие решений и осуществление действий в течение долгого времени.

Интеллектуальные агенты бывают простыми и сложными. Простейший термостат или система управления считается интеллектуальным агентом, как и человек, а также любая другая система, удовлетворяющая тем же критериям — например, предприятие, государство или биотоп[1].

Интеллектуальные агенты действуют на основании целевой функции, отражающей их задачи. Они проектируются так, чтобы строить и реализовывать планы, максимизирующие ожидаемое значение этой функции[2]. Так, агент обучения с подкреплением использует функцию вознаграждения, позволяя разработчикам формировать желаемое поведение[3]. Аналогично, действия эволюционного алгоритма определяются целевой функцией приспособленности[4].

В искусственном интеллекте интеллектуальные агенты имеют тесную связь с агентами из экономики, а различные варианты парадигмы интеллектуального агента исследуются также в когнитивных науках, этике, философии практического разума и в междисциплинарных социокогнитивных моделированиях и компьютерных социальных моделированиях.

Типично интеллектуальные агенты описываются абстрактно — как функциональные системы, напоминающие компьютерные программы. Чтобы отличить теоретические модели от реальных реализаций, абстрактные описания интеллектуальных агентов называют абстрактными интеллектуальными агентами. Они также тесно связаны с программными агентами — автономными компьютерными программами, выполняющими задания от имени пользователей. Часто их называют также рациональными агентами[1].

Интеллектуальные агенты как основа искусственного интеллекта

Понятие интеллектуального агента лежит в основе определения и понимания искусственного интеллекта. Так, влиятельный учебник «Искусственный интелект: современный подход» определяет:

- Агент: Всё, что воспринимает свою среду (с помощью сенсоров) и воздействует на неё (используя актуаторы). Пример: робот с камерами и колёсами или программа, анализирующая данные и дающая рекомендации.

- Рациональный агент: Агент, стремящийся к наилучшему возможному исходу на основе своих знаний и предыдущего опыта. «Наилучший» оценивается с помощью функции эффективности — специальной меры результативности агента.

- Искусственный интеллект как область: Изучение и создание рациональных агентов.

Другие исследователи дополняют эту модель. Пэгдгам и Виникофф отмечают, что интеллектуальные агенты должны оперативно реагировать на изменения, проактивно достигать целей, быть гибкими и устойчивыми (способными справляться с неожиданностями). Некоторые добавляют, что идеальные агенты рациональны в экономическом смысле (принимают оптимальные решения) и способны к сложным рассуждениям, включая наличие убеждений, целей и намерений (модель BDI). Каплан и Ханлайн определяют интеллект агента через способность понимать внешние данные, учиться на них и достигать целей, гибко адаптируясь.

Определение ИИ через интеллектуальных агентов имеет ряд преимуществ:

- Избежание философских споров: Позволяет уйти от дебатов о «настоящем» интеллекте или осознанности (как при тесте Тьюринга или в китайской комнате) — акцент на поведении и достижении целей, а не на воссоздании человеческого мышления.

- Объективная проверка: Даёт точный научный способ оценки ИИ: можно сравнивать различные подходы по мере выполнения целевой функции. Это облегчает сравнение и интеграцию решений.

- Междисциплинарность: Обеспечивает общий язык для сотрудничества специалистов ИИ с областями, где тоже используются понятия целей и рациональных агентов (например, математическая оптимизация, экономика).

Целевая функция

Целевая функция (или функция цели) формализует задачи интеллектуального агента. Агент считается более интеллектуальным, если он стабильно выбирает действия, приближающие результат к целям функции. Таким образом, целевая функция служит мерой успеха.

Функция может быть:

- Простой: Например, в игре го — 1 за победу, 0 за поражение.

- Сложной: Включать анализ и обучение на собственном опыте, позволяя адаптироваться и выявлять успешные паттерны.

Целевая функция охватывает все цели, на которые агент ориентирован. Для рациональных агентов она также отражает компромиссы между конкурирующими задачами (например, у беспилотного автомобиля — баланс между безопасностью, скоростью и комфортом).

В зависимости от контекста, используются разные термины:

- Функция полезности: Аналог в экономике и теории принятия решений, отражает привлекательность состояния.

- Целевая функция: Общий термин оптимизации.

- Функция потерь: В машинном обучении, целью обычно является её минимизация (понижение ошибки).

- Функция вознаграждения: Используется в обучении с подкреплением.

- Функция приспособленности: В эволюционных алгоритмах.

Цели агента и целевая функция задаются:

- Явно: Жёстко запрограммированы.

- Сформированы косвенно: Приобретены или эволюционированы в процессе обучения.

- В обучении с подкреплением функция вознаграждения даёт обратную связь: поощряет нужное поведение и наказывает за нежелательное.

- В эволюционных системах функция приспособленности определяет, какие агенты будут более успешными и выживут в «отборе»[5].

Некоторые ИИ-системы (например, метод ближайших соседей) делают выводы по аналогии, а не в строгом целевом режиме. Тем не менее, и в подобных случаях цели можно трактовать через определённую задачу классификации[6][7].

В некоторые системы, не рассматриваемые традиционно как агенты (например, системы представления знаний), парадигму расширяют, воспринимая их как агентов с целью, например, отвечать точно на вопросы (то есть «действие» — это выдать ответ). В генеративных состязательных сетях (GAN, 2010-е) компонент «генератор» старается подражать человеческому тексту и максимизирует вероятность обмана «дискриминатора»[8].

Символьные ИИ-системы часто используют явную целевую функцию, но этот подход применим и к нейросетям и эволюционным алгоритмам. Классические агенты обучения с подкреплением формируются для максимизации функции вознаграждения[9]. Иногда практикуется поэтапное «формирование вознаграждения», когда сперва агенту выдаются награды за промежуточные успехи[10]. Ян Лекун утверждал в 2018 году: «Почти все существующие алгоритмы обучения сводятся к минимизации некой целевой функции»[11]. У системы AlphaZero по шахматам функция была простой: +1 за победу, −1 за поражение; у автопилота — сложнее[12]. Эволюционные алгоритмы развивают интеллектуальных агентов, максимизирующих функцию приспособленности[4].

Математическая модель AIXI (Айкси) была предложена как максимально интеллектуальный агент в этой парадигме[13], однако Айкси невычислим. На практике агенты ограничены ресурсами и временем, а исследователи конкурируют, создавая алгоритмы, всё эффективнее решающие бенчмарки на имеющемся оборудовании[14].

Функция агента

Поведение интеллектуального агента можно формализовать с помощью так называемой функции агента, определяющей, что агент делает на основе того, что он воспринимает.

Перцепт — это информация, поступающая агенту от сенсоров в определённый момент времени. Так, перцепты автопилота могут включать изображения камер, данные лидаров, координаты GPS, параметры скорости. Используя сиюминутный и исторический набор перцептов, агент принимает решение о следующем действии (например, ускориться, затормозить, повернуть).

Функция агента, обычно f, отображает всю историю перцептов агента в некоторое действие[15]:

где:

- — множество всех возможных последовательностей перцептов (перцептивная история);

- — множество всех возможных действий;

- — функция, сопоставляющая истории перцептов действию.

Важно отличать абстрактную функцию агента от её конкретной реализации — программы агента.

- Функция агента — теоретическая характеристика.

- Программа агента — конкретная реализация, принимающая текущий перцепт на вход и возвращающая действие на выходе.

В функцию агента можно закладывать любые методы принятия решений[16]:

- вычисление полезности разных действий,

- логические правила и дедукцию,

- нечёткую логику,

- и другие способы.

Классификация интеллектуальных агентов

Рассел и Норвиг выделяют пять групп агентов по степени интеллекта и функциональности[17]:

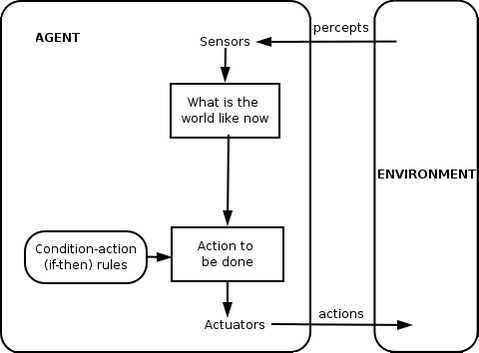

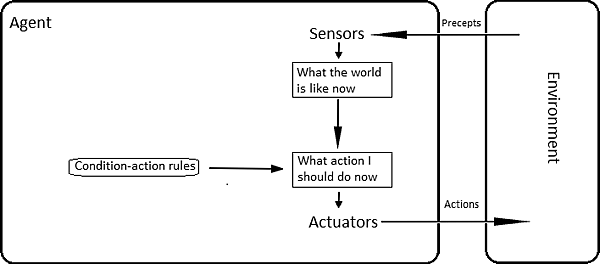

Простые агенты действуют только на основании текущего перцепта, не учитывая его историю. Их поведение реализует правило «если условие — то действие».

Такая функция адекватна только в полностью наблюдаемых средах. Иногда агент хранит часть информации о состоянии, чтобы не реагировать повторно на выполненные условия.

В частично наблюдаемых средах простые агенты могут попадать в бесконечные циклы; если встроить случайность в выбор, можно иногда выйти из цикла.

Пример — домашний термостат, включающий или отключающий нагреватель при падении температуры ниже порога[18][19].

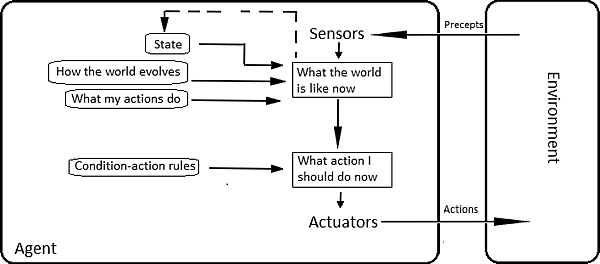

Такие агенты способны действовать в частично наблюдаемых средах. Они хранят во внутренней памяти модель скрытых свойств среды — «как устроен мир», что позволяет называться модельными агентами.

Модельный рефлексный агент поддерживает некую внутреннюю модель, основанную на истории перцептов, чтобы учитывать невидимые параметры состояния. Перцептивная история и влияние действия на среду прогнозируются с помощью этой модели, дальше выбор действия — как у простого агента.

Модели можно использовать и для предсказания/описания поведения других агентов в среде[20].

Дальнейшее развитие модельных агентов — использование «информации о целях». Цели определяют, какие состояния желательны, и позволяют агенту выбирать действия так, чтобы прийти к целевому состоянию. Методы поиска и планирования — подотрасли ИИ, изучающие стратегии достижения целей.

Примеры: ChatGPT и пылесос Roomba[21].

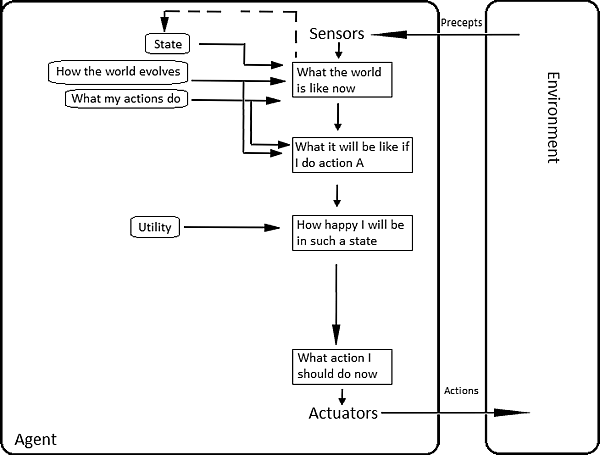

Целевые агенты различают только достижение/недостижение цели. Можно ввести количественную меру «желательности состояния» через функцию полезности, возвращающую оценку удовлетворения целей. Более общая мера производительности позволяет сравнивать состояния по степени выполнения целей. Термин «полезность» выражает условное «счастье» агента.

Рациональный агент выбирает действие с максимальной ожидаемой полезностью; для этого необходимо моделировать и отслеживать состояние среды, что связано со значительным исследованием в областях восприятия, представления знаний, рассуждений и обучения.

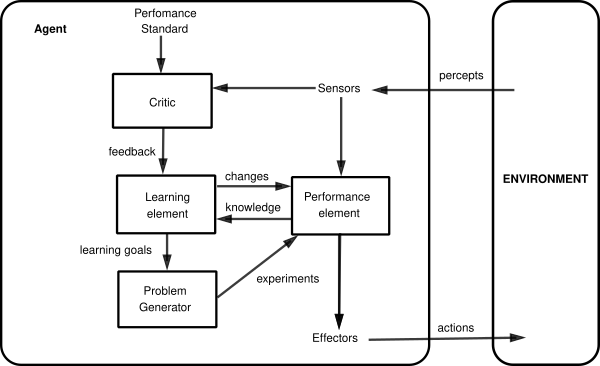

Обучаемость позволяет агентам стартовать в неизвестной среде и постепенно выходить за рамки начальных знаний. Ключевая черта — разделение на блок обучения (улучшения) и исполнения (выбора действий).

Обучающий элемент анализирует обратную связь (от «критика»), выясняет, как изменить исполнительный компонент (или «актора»), чтобы повысить результативность. Прежний исполнительный элемент принимал вход (перцепт), выдавал действие — теперь его можно улучшать.

Последний компонент — генератор проблем — придумывает новые стимулы к экспериментам и обучению.

Интеллектуальный агент, взаимодействующий с окружающей средой через физическое тело в этой среде. Воплощённые агенты, визуально представленные в виде человеческой фигуры или, например, мультяшного животного, также относятся к воплощённым агентам, несмотря на то, что их воплощение виртуальное, а не физическое. В одной из ветвей искусственного интеллекта ведутся разработки, направленные на обеспечение автономного взаимодействия таких агентов с людьми и средой. Одним из примеров физически воплощённых агентов являются мобильные роботы; графические воплощённые агенты представлены, например, Ananova и Microsoft Agent. Воплощённые разговорные агенты — это воплощённые агенты (чаще с графическим интерфейсом, нежели с роботизированным телом), умеющие вести диалог друг с другом и с людьми, используя аналогичные человеческим вербальные и невербальные средства коммуникации (жесты, мимика и др.).

По Вайсу агенты делятся на четыре типа:

- Логические агенты, принимающие решения с помощью логических выводов.

- Реактивные агенты, напрямую сопоставляющие ситуацию и действие.

- Агенты верований-желаний-намерений (BDI), решения которых базируются на структурировании и взаимном согласовании верований, целей и намерений.

- Многоуровневые архитектуры, где различные программные слои рассуждают на разных уровнях абстракции.

В 2013 году А. Висснер-Гросс опубликовал теорию, исследующую связь между свободой и интеллектом у интеллектуальных агентов[22][23].

Иерархии агентов

Интеллектуальные агенты часто структурируются иерархически, в несколько «субагентов». Последние отвечают за низкоуровневые задачи, в то время как главный агент руководит сложными действиями и координацией.

Типичная структура — разделение на сенсоры и актуаторы: подсистема восприятия собирает данные, управляемый центральным контроллером, который передаёт команды исполнительным механизмам. Для компромисса между быстротой реакций и продуманностью решений нередко используется иерархия контроллеров[24].

Иные трактовки и применения

Термин «интеллектуальный агент» нередко употребляется в размытом смысле, иногда в значении виртуального персонального помощника[25]. В определениях XX века агент — это программа, помогающая или действующая от имени пользователя[26]. Подобные примеры называют программными агентами, а если агент интеллектуален — говорят об «интеллектуальных программных агентах».

По Н. Касабову (1998), интеллектуальные агентные системы должны обладать[27]:

- Возможностью поэтапного пополнения правил решения задач

- Адаптацией «на лету» и в реальном времени

- Cамоанализом поведения, ошибок и успехов

- Способностью учиться через взаимодействие со средой (воплощённость)

- Быстрым обучением на больших массивах данных

- Хранением/поиском экземпляров («опытной памяти»)

- Наличием параметров, моделирующих кратко- и долговременную память, «возраст», забывание и пр.

В контексте генеративного ИИ агентные ИИ — это класс интеллектуальных агентов, выделяющихся автономной работой в сложных средах. Агентные ИИ ориентированы не на генерацию контента, а на принятие решений, не требуют постоянных подсказок или надзора со стороны человека[28].

Ключевые свойства: сложные иерархии целей, интерфейс на естественном языке, независимость от непосредственного контроля пользователя, интеграция инструментов или систем планирования. Часто основой выступают большие языковые модели[29].

Стандарта для понятия отсутствует[30][31][32].

Популярное применение — автоматизация задач (например, бронирование путешествий по запросу пользователя)[33], а также Devin AI, AutoGPT, SIMA[34] и другие примеры.

Разработаны многочисленные фреймворки (LangChain, CAMEL, AutoGen, Swarm и др.) и протоколы для стандартизации коммуникаций между агентами (Agent Protocol, Model Context Protocol и др.).

2025 год — ряд компаний (Google, Microsoft, Amazon Web Services) предлагают платформы для размещения и развёртывания ИИ-агентов[35].

На 2025 год отмечается мало реальных внедрений агентных ИИ за пределами пилотных проектов[36].

Заявляемые достоинства: рост личной и экономической продуктивности, стимулирование инноваций и автоматизация рутинных задач[37][38], помощь в доступности интернета для людей с ограниченными возможностями.

Главные опасения: вопросы ответственности, рост киберугроз, этические вызовы, проблемы безопасности и корректного поведения ИИ, приватности, контроля, повторяемости, уязвимостей, смещения и др[39].

Применения

Идея агентного моделирования для беспилотных автомобилей обсуждалась ещё в 2003 году[40]. Позже появились методы на основе имитации цифровых двойников автомобилей и агентного управления в моделях дорожного движения[41].

Компания Waymo разработала среду Carcraft для моделирования работы беспилотников и их взаимодействия с живыми участниками и пешеходами[42][43].

Платформа Agentforce (Salesforce) позволяет создавать автономных ИИ-агентов для бизнес-задач[44][45].

Транспортная служба безопасности США внедряет агентные ИИ для биометрической идентификации пассажиров и реагирования на инциденты[46].

Примечания

Литература

- Domingos, Pedro. The Master Algorithm: How the Quest for the Ultimate Learning Machine Will Remake Our World : [англ.]. — Basic Books, 22 сентября 2015. — ISBN 978-0-465-06570-7.

- Russell, Stuart. Искусственный интеллект: современный подход / Stuart Russell, Norvig, Peter. — Москва : Williams, 2003. — ISBN 5-8459-0597-0.

- Kasabov, N. (1998). “Introduction: Hybrid intelligent adaptive systems”. International Journal of Intelligent Systems. 13 (6): 453—454. DOI:10.1002/(SICI)1098-111X(199806)13:6<453::AID-INT1>3.0.CO;2-K. S2CID 120318478.

- Weiss, G. Multiagent systems : [англ.]. — 2nd. — Cambridge, MA : MIT Press, 2013. — ISBN 978-0-262-01889-0.