Симуляция

Симулятор — это имитация работы процесса или системы, которые могут существовать в реальном мире[1][2].[3] В широком смысле термин симуляция часто употребляется как синоним моделирования. Иногда между этими понятиями проводится чёткое различие: моделирование — представление ключевых характеристик системы или процесса, а симуляция — воспроизведение их эволюции во времени[4]. Нередко в симуляции используются вычислительные средства (компьютерная симуляция).

Симуляторы применяются для технологического моделирования при оптимизации и настройке систем, в инженерии безопасности, тестировании, обучении, образовательных целях, видеоиграх. Кроме того, симуляция используется для изучения функционирования природных и социальных систем[5], а также для прогнозирования последствий различных условий и вариантов действий. Симуляцию используют, когда реальную систему невозможно задействовать из-за недоступности, опасности, этапа проектирования либо по иным причинам[6].

Ключевые вопросы моделирования и симуляции включают получение надёжной информации о характеристиках системы, применение упрощающих допущений, а также проверку и валидацию результатов. Разработка методик верификации и валидации моделей — отдельное направление в области вычислительных симуляций.

Современное развитие симуляций тесно связано с ростом вычислительных мощностей и прорывами в области искусственного интеллекта (ИИ). Это привело к появлению новых направлений, таких как симуляции, управляемые или дополненные ИИ (AI Simulation)[7], и концепции цифровых двойников — динамических виртуальных копий реальных объектов или процессов, синхронизированных с ними в реальном времени[8].

Современные тенденции и технологии

С середины 2010-х годов развитие симуляций было тесно связано с ростом вычислительных мощностей, прорывами в области искусственного интеллекта (ИИ) и развитием новых технологий. Это привело к появлению принципиально новых типов моделей, которые находят применение в науке, промышленности и других сферах.

Одним из главных катализаторов изменений стало слияние ИИ и традиционного моделирования, что привело к появлению направления AI Simulation — симуляций, управляемых или дополненных искусственным интеллектом. В рамках этого подхода генеративные модели, такие как генеративно-состязательные сети (GAN) и диффузионные модели, используются для создания новых, реалистичных данных, объектов и интерактивных миров, а не только для моделирования известных процессов[9][10]. Кроме того, ИИ применяется для анализа больших объёмов данных, генерируемых симуляциями, и для выдвижения научных гипотез[11].

Концепция цифрового двойника — виртуальной копии физического объекта, процесса или системы — получила массовое распространение после 2015 года благодаря развитию интернета вещей (IoT) и искусственного интеллекта. Цифровой двойник представляет собой динамическую модель, которая постоянно синхронизируется с реальным объектом через датчики, получая данные в режиме реального времени. Это позволяет анализировать текущее состояние объекта, прогнозировать его поведение, выявлять аномалии и оптимизировать работу без риска для реального прототипа. Технология активно используется в промышленности для оптимизации производственных линий, в здравоохранении для моделирования и персонализации лечения, а также для управления сложными системами, такими как умные города[12][13]. По мере распространения технологии началась её стандартизация; так, в 2021 году в России был утверждён первый в мире национальный стандарт в этой сфере (ГОСТ Р 57700.37–2021)[14].

Облачные вычисления сделали высокопроизводительные вычисления доступными для широкого круга пользователей, устранив необходимость в закупке и поддержке дорогостоящих суперкомпьютеров[15]. Облачные платформы предоставляют не только вычислительные мощности, но и доступ к специализированному программному обеспечению для моделирования по модели SaaS (программное обеспечение как услуга)[15]. Это стало одной из ключевых технологий, обеспечивающих работу цифровых двойников, предоставляя инфраструктуру для сбора, хранения и анализа данных с физических объектов[15].

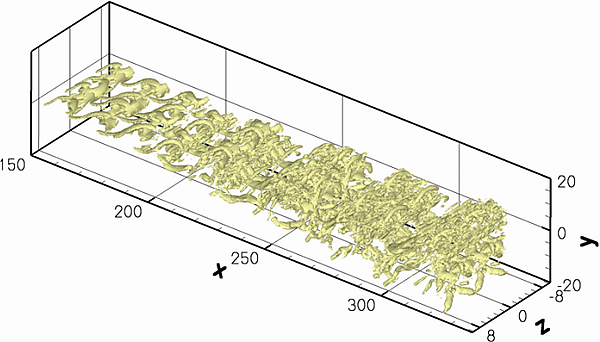

В период 2015–2025 годов значительно выросла сложность и реалистичность симуляций глобальных систем. Современные климатические модели стали учитывать большее количество процессов в атмосфере, океанах и на суше, а моделирование в километровом масштабе позволило повысить точность региональных прогнозов[16]. В астрофизике были созданы беспрецедентно детализированные модели Вселенной, такие как IllustrisTNG, позволяющие изучать рождение и эволюцию галактик[17].

Параллельно был заложен фундамент для квантовых симуляций. Ожидается, что квантовые компьютеры произведут революцию в моделировании систем, которые по своей природе являются квантовыми (например, химические реакции, разработка новых материалов и лекарств), и решении сверхсложных оптимизационных задач, недоступных для классических компьютеров[9].

Классификация и терминология

Исторически симуляции в различных областях развивались независимо, но развитие системного подхода, кибернетики и широкое внедрение вычислительной техники привели к унификации подходов и более системному взгляду на симуляцию.

Физическая симуляция подразумевает замену реального объекта физической моделью, зачастую меньших размеров или дешевле оригинала. Термин также используется для компьютерного моделирования физических процессов — мультифизические симуляции[18].

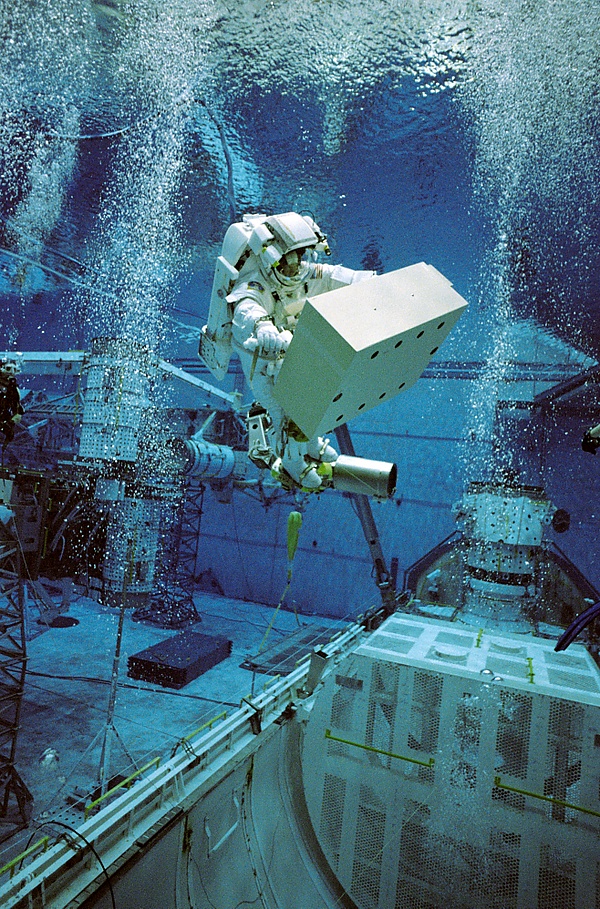

Интерактивная симуляция (или человеко-машинная, англ. human-in-the-loop simulation) — симуляция с участием операторов, например, в авиасимуляторах, морских симуляторах, автомобильных симуляторах.

Непрерывная симуляция моделирует процессы с непрерывным временем, применяя численное интегрирование дифференциальных уравнений[19].

Дискретно-событийное моделирование изучает системы, состояние которых изменяется лишь в дискретные (отдельные) моменты времени[20]. Например, эпидемия может моделироваться с изменениями числа заражённых только в моменты новых инфицирований или выздоровлений.

Стохастическое моделирование подразумевает наличие случайных переменных, используется метод Монте-Карло с псевдослучайными числами; повторные прогоны при одинаковых условиях дадут разные результаты в определённом доверительном интервале[19]

Детерминированная симуляция полностью воспроизводима: повторные прогоны при одинаковых условиях дают идентичный результат. В 2020-е годы этот подход получил развитие в виде детерминированного симуляционного тестирования (англ. Deterministic Simulation Testing, DST) — метода тестирования программного обеспечения в полностью контролируемой среде, где устранены все источники недетерминизма (например, сетевые задержки или системное время)[21]. Главное преимущество DST — идеальная воспроизводимость ошибок, что значительно упрощает их отладку. Технология применяется для проверки сложных распределённых систем, например, она использовалась для выявления ошибок в коде обновления «The Merge» для сети Ethereum в 2022 году[21], а также в автомобильной промышленности для тестирования систем помощи водителю (ADAS) в соответствии со стандартом безопасности ISO 26262[22].

Гибридная симуляция сочетает в себе непрерывное и дискретно-событийное моделирование: между событиями решаются дифференциальные уравнения[23]..

Автономная симуляция — симулятор, работающий на одном компьютере самостоятельно.

Распределённая симуляция использует несколько компьютеров одновременно для доступа к различным ресурсам (например, многопользовательские или распределённые по данным системы), классический пример — распределённая интерактивная симуляция[24].

Параллельная симуляция ускоряет вычисления за счёт распараллеливания нагрузки между процессорами, как в системах HPC[25].

Интероперабельная симуляция — взаимодействие нескольких моделей/симуляторов (часто называемых федератами) по сети. Ключевым стандартом в этой области является архитектура высокого уровня (HLA)[26][27]. В феврале 2025 года была утверждена новая версия стандарта — HLA 4 (IEEE 1516-2025), направленная на улучшение безопасности, масштабируемости и готовности к работе в облачных средах[28][29].

Моделирование и симуляция как сервис (англ. Modeling and Simulation as a Service, MSaaS) — предоставление доступа к симуляции через веб-интерфейс, часто на основе облачных вычислений[30]. Концепция получила развитие как инициатива НАТО с целью сделать сложные технологии моделирования более доступными и экономически эффективными[31][32]. В рамках этого подхода развивается направление «цифровой двойник как сервис» (англ. Digital Twin as a Service, DTaaS), позволяющее в реальном времени отслеживать состояние активов и моделировать сценарии «что, если»[33].

Интеграция моделирования, интероперабельной симуляции и серьёзных игр объединяет игровые движки и методы вовлечения с гибкими симуляторами для создания обучающих и тренировочных систем[34]. Серьёзные игры, в отличие от развлекательных, нацелены на обучение или тренировку. Они активно применяются в обороне для тактической подготовки (например, игра America's Army), в здравоохранении для отработки хирургических навыков, а также в корпоративном обучении[35][36].

Точность симуляции (англ. fidelity) характеризует, насколько близко симуляция имитирует реальный объект: различают низкий, средний и высокий уровни.

Синтетическая среда — компьютерная симуляция, часто используемая в человеко-машинных симуляциях. Подразумевает либо окружение для сенсорных моделей, либо визуальные, VR-подобные среды[37][38].

Симуляция для анализа отказов — создание условий для выявления причин отказа оборудования, эффективный способ поиска неисправности.

Истоки интерактивной (человеко-машинной) симуляции лежат в военных разработках 1940–1950-х годов. Одним из первых проектов стал компьютер Whirlwind, созданный в МТИ и изначально предназначавшийся для создания универсального пилотажного тренажёра[39]. Технологии Whirlwind легли в основу системы ПВО SAGE, где операторы с помощью светового пера взаимодействовали с данными на экранах в реальном времени, став ключевым звеном в цикле управления[40]. Революцию в графическом взаимодействии совершил Айвен Сазерленд, создав в 1963 году программу Sketchpad. Она впервые позволила напрямую манипулировать графическими объектами на экране и заложила основы для САПР и современных графических интерфейсов[41][42].

С появлением персональных компьютеров в 1970–1980-х годах интерактивные симуляции вышли на массовый рынок, в первую очередь в виде игр. Серия Microsoft Flight Simulator, начавшаяся в 1982 году, на десятилетия определила стандарты гражданских авиасимуляторов[43]. В гоночных симуляторах, таких как Indianapolis 500: The Simulation (1989), появились продвинутые для своего времени физические модели и системы повреждений[44]. В 1990–2000-е годы жанр диверсифицировался: появились симуляторы жизни (The Sims, 2000) и высокореалистичные боевые авиасимуляторы (Ил-2 Штурмовик, 2001)[43][45].

Ключевой сдвиг в развитии физической симуляции произошёл в конце 2000-х с переносом вычислений с центральных процессоров (CPU) на графические (GPU). Этому способствовала Nvidia, которая в 2008 году приобрела разработчика физического движка PhysX и интегрировала его аппаратное ускорение в свои видеокарты[46]. Конкурент, движок Havok, был приобретён Intel в 2007 году (а в 2015-м — Microsoft). В 2010-е годы, благодаря росту мощностей и доступности игровых движков, таких как Unity и Unreal Engine, интерактивные симуляции стали массово применяться в профессиональной подготовке[47]. Распространение технологий виртуальной (VR) и дополненной (AR) реальности, особенно после появления Oculus Rift, привело к созданию иммерсивных тренажёров для промышленности, медицины и военной сферы[48]. В медицине симуляторы стали стандартом для отработки хирургических навыков, а в промышленности — для обучения работе с опасным оборудованием и проектирования в виртуальной среде[49][50].

В период с 2019 по 2025 год развитие технологий вышло на новый уровень. В 2019 году Epic Games представила собственный физический движок Chaos для Unreal Engine, нацеленный на создание кинематографических разрушений в реальном времени[51]. В свою очередь, Nvidia выпустила PhysX 5, объединивший в едином решателе симуляцию твёрдых тел, жидкостей и деформируемых объектов[52]. Физические симуляторы стали ключевым инструментом для обучения искусственного интеллекта, позволяя алгоритмам обучения с подкреплением безопасно накапливать опыт в виртуальных средах, работающих в тысячи раз быстрее реального времени (например, в Nvidia Isaac Gym)[53]. В интерактивных симуляциях главным трендом стала глубокая интеграция с ИИ для создания адаптивных и персонализированных сценариев обучения[54]. В промышленности это привело к развитию концепции «промышленной метавселенной» — созданию цифровых двойников целых заводов для моделирования рабочих процессов и обучения персонала в иммерсивной среде.

Развитие непрерывной симуляции, основанной на численном решении дифференциальных уравнений, неразрывно связано с эволюцией вычислительной техники и численных методов. Каждый этап этого развития открывал возможность моделировать всё более сложные динамические системы.

1970-е: Решение проблемы «жёсткости»

Ключевым достижением 1970-х стало эффективное решение проблемы жёстких систем — систем уравнений, описывающих процессы с сильно различающимися характерными временами (например, быстрые химические реакции и медленные температурные изменения)[55]. Решение таких задач стандартными явными методами было неэффективным. Прорыв совершил С. Уильям Гир, который в 1971 году представил первый программный код, способный автоматически решать как жёсткие, так и нежёсткие системы[56]. Его метод, основанный на формулах обратного дифференцирования (BDF), мог автоматически подбирать порядок точности и размер шага, что сделало его широко используемым инструментом в химической кинетике и при моделировании электронных схем (например, в симуляторе SPICE2)[56][57]. В этот же период появились специализированные языки моделирования, такие как CSMP от IBM[58].

1980-е: Демократизация и коммерческое ПО

Революция персональных компьютеров и появление мощных рабочих станций сделали непрерывное моделирование доступным для широкого круга инженеров и учёных[59]. Важнейшим событием стало появление в 1984 году коммерческой версии MATLAB — программной среды, которая быстро стала стандартом для научных и инженерных вычислений[60]. В 1980-е годы были разработаны и усовершенствованы классические численные методы: так, метод Дорманда — Принса лёг в основу популярного решателя ode45 в MATLAB[61]. Для решения жёстких систем были созданы программные пакеты, такие как LSODE[62]. В коммерческих пакетах моделирования, таких как SIMAN/CINEMA, появилась визуальная интерактивная симуляция (анимация), что значительно повысило наглядность результатов[63].

1990-е: Геометрическое интегрирование и метод прямых

Главным теоретическим прорывом 1990-х стало развитие геометрических интеграторов, в частности симплектических методов[64]. В отличие от традиционных подходов, эти методы спроектированы так, чтобы сохранять качественные свойства физической системы (например, энергию или импульс), что обеспечивает превосходную долгосрочную стабильность при моделировании гамильтоновых систем, таких как движение планет или молекулярная динамика[65]. Расцвет этих методов пришёлся на начало десятилетия, чему способствовали работы Харуо Ёсиды[65]. Для решения уравнений в частных производных (УЧП) широкое распространение получил метод прямых, который сводит УЧП к системе ОДУ, решаемой затем усовершенствованными методами для жёстких систем[66].

2000-е: Мультифизика и объектно-ориентированное моделирование

В 2000-е годы фокус сместился на моделирование сложных мультифизичных систем, где взаимодействуют процессы различной природы (механические, электрические, гидравлические). Ключевую роль в этом сыграл язык Modelica — декларативный, объектно-ориентированный язык, позволяющий описывать физическую структуру системы, а не выводить вручную сложные системы уравнений[67]. В этот период появились и развивались среды, поддерживающие Modelica (Dymola, OpenModelica), а Simulink утвердился как промышленный стандарт для проектирования систем управления[68]. Продолжалось совершенствование численных методов, в частности, решателей для жёстких систем, таких как CVODE из пакета SUNDIALS[69].

2010-е: Параллелизм и зарождение ИИ-подходов

На фоне ограничений роста тактовой частоты процессоров начался всплеск интереса к методам с распараллеливанием по времени (англ. Parallel-in-Time, PinT), таким как Parareal и MGRIT[70]. К концу десятилетия начали активно развиваться подходы на стыке численных методов и машинного обучения. Появились концепции нейронных ОДУ (англ. Neural ODEs), где нейронная сеть используется для представления правой части дифференциального уравнения, и физически-информированных нейронных сетей (англ. Physics-Informed Neural Networks, PINNs), в которых само уравнение включается в функцию потерь при обучении сети[71].

2020-е: Доминирование ИИ и гибридизация

В период с 2020 по 2025 год методы на основе машинного обучения стали одним из главных направлений исследований. PINN продемонстрировали высокую эффективность в решении сложных задач, таких как моделирование турбулентных потоков, что привело к созданию коммерческих фреймворков для их применения (например, NVIDIA PhysicsNeMo в 2025 году)[72]. Параллельно продолжалось совершенствование классических численных методов для решения узкоспециализированных задач. Были разработаны новые многоскоростные методы (англ. Multirate Methods) для систем с компонентами, изменяющимися в разных временных масштабах[73], и более устойчивые неявно-явные (IMEX) интеграторы[74]. Этот период характеризуется активной гибридизацией подходов, когда классические методы сочетаются с ИИ для достижения большей точности и производительности.

В период с 2000-х годов дискретно-событийное моделирование (англ. Discrete-Event Simulation, DES) претерпело значительное развитие, превратившись из изолированного инструмента анализа в интегрированный компонент сложных интеллектуальных систем.

2000-е: Становление гибридных подходов и стандартизация

Начало 2000-х годов ознаменовалось активным внедрением в практику агентного моделирования (ABM), что привело к появлению многоподходного (гибридного) моделирования — интеграции DES с другими парадигмами, в первую очередь с ABM и системной динамикой (SD)[75]. Этот подход позволил описывать сложные системы на разных уровнях абстракции в рамках одной модели: DES — для процессов и очередей на операционном уровне, ABM — для индивидуального поведения автономных объектов, а SD — для стратегического моделирования[76]. Пионером в этой области стала российская компания The AnyLogic Company, выпустившая в 2000 году одноимённый программный продукт, который стал одним из первых, предложивших единую платформу для всех трёх методов[77].

Важнейшим событием для распределённых симуляций стало утверждение в 2000 году стандарта High-Level Architecture (HLA) (IEEE 1516-2000), который позволил объединять различные симуляторы (федераты) в единую систему (федерацию)[78]. В течение десятилетия стандарт дорабатывался, что завершилось выпуском в 2010 году следующей крупной версии — HLA Evolved (IEEE 1516-2010). В этот же период появились новые инструменты, такие как Simio (2008), развивший концепцию «интеллектуальных объектов», согласно которой не только заявки, но и ресурсы (оборудование, персонал) наделяются собственной логикой поведения[79].

2010-е: Интеграция с Индустрией 4.0

В 2010-е годы DES стал неотъемлемой частью концепции Индустрия 4.0, что проявилось в глубокой интеграции с новыми технологиями[80].

- Цифровые двойники: DES-модели стали ядром для создания цифровых двойников, имитируя производственные процессы, потоки материалов и влияние сбоев. Благодаря данным, поступающим в реальном времени с датчиков Интернета вещей (IoT), цифровой двойник позволил осуществлять мониторинг, прогнозирование и оптимизацию работы реальной системы[80][81].

- Искусственный интеллект (ИИ) и машинное обучение (ML): Алгоритмы ML начали применяться для анализа входных данных, оптимизации параметров модели и поддержки принятия решений в реальном времени[80].

- Большие данные: Появились методы, такие как process mining, которые позволили автоматически строить и калибровать модели на основе реальных логов событий[82].

В этот период значительно расширились и области применения DES, включая оптимизацию работы больниц, управление строительными процессами в связке с BIM и анализ бизнес-процессов в сфере услуг[83][84].

2020-е: Глубокая синергия с ИИ и переход в облака

В период с 2020 по 2025 год слияние ИИ и имитационного моделирования стало главным драйвером инноваций[85]. DES-модели стали создавать безопасные виртуальные среды для обучения систем ИИ, в частности, алгоритмов обучения с подкреплением, которые вырабатывают оптимальные стратегии управления сложными системами[86]. Цифровые двойники эволюционировали в «живые» модели, синхронизированные с физическими объектами в реальном времени через IoT-протоколы, такие как MQTT[87].

Ключевыми тенденциями также стали переход на облачные платформы (например, AnyLogic Cloud), что демократизировало доступ к высокопроизводительным вычислениям, и значительные улучшения в визуализации, включая создание фотореалистичных 3D-анимаций с помощью платформ рендеринга, таких как Nvidia Omniverse[85]. Интеграция с языком программирования Python стала практически стандартом для ведущих программных пакетов, таких как AnyLogic, Arena Simulation, Tecnomatix Plant Simulation и Simio[88].

Развитие стохастического моделирования и метода Монте-Карло было обусловлено как теоретическими прорывами, так и ростом вычислительных мощностей, что позволило применять их для решения всё более сложных задач в науке, технике и экономике.

1970-е: Теоретические основы

Ключевым событием десятилетия стала работа У. К. Гастингса, который в 1970 году обобщил алгоритм Метрополиса, создав алгоритм Метрополиса — Гастингса[89]. Это значительно расширило класс задач, решаемых с помощью методов Монте-Карло на основе цепей Маркова (MCMC), которые стали краеугольным камнем современных стохастических симуляций[89]. В этот же период были заложены основы квантового метода Монте-Карло (QMC): Малвин Калос разработал метод Монте-Карло с функцией Грина (GFMC), позволивший с высокой точностью вычислять энергию основного состояния квантовых систем[90]. В СССР заметным событием стала книга Юрия Ермольева «Методы стохастического программирования» (1976), а сами методы начали применяться для решения задач экономического планирования и исследования операций[91][92].

1980-е: Расширение применения

В середине 1980-х годов был создан алгоритм имитации отжига, позволивший применять подходы Монте-Карло для решения сложных задач глобальной оптимизации[93]. Рост вычислительных мощностей способствовал проникновению стохастических методов в новые области. Они активно использовались в статистической физике для исследования фазовых переходов, в химии для моделирования сложных молекул, а также для анализа и оптимизации систем связи, в частности сетей со случайным множественным доступом к спутниковым каналам[94][95].

1990-е: Революция в статистике и новые алгоритмы

Это десятилетие ознаменовалось революцией в байесовской статистике, вызванной публикацией в 1990 году статьи Алана Гельфанда и Адриана Смита, которая представила сэмплер Гиббса как универсальный инструмент для анализа сложных статистических моделей[96]. Алгоритмы MCMC открыли дорогу для анализа ранее неразрешимых байесовских задач в эконометрике, биологии и других областях[97]. В квантовой физике прорыв совершили Н. В. Прокофьев, Б. В. Свистунов и И. С. Тупицын, разработавшие в 1996 году точный квантовый метод Монте-Карло в непрерывном времени (CT-QMC), известный как «worm algorithm»[98][99]. В финансовой математике метод Монте-Карло утвердился как стандартный инструмент для анализа рисков и оценки стоимости опционов[100].

2000-е: Усовершенствование и специализация

В 2000-е годы исследования были направлены на повышение эффективности MCMC-алгоритмов. Были предложены адаптивные методы, в которых параметры алгоритма настраиваются автоматически в процессе моделирования[101], и новые подходы для работы с распределениями, содержащими неизвестные нормировочные константы[102]. Значительное развитие получили методы квази-Монте-Карло (КМК), использующие детерминированные последовательности с низким расхождением для достижения более высокой скорости сходимости в задачах численного интегрирования[103]. В стохастической химической кинетике был предложен «метод следующей реакции» (2000), повысивший эффективность вычислений[104].

2010-е: Расцвет байесовских вычислений

В середине 2010-х годов широкое распространение получил Гамильтонов Монте-Карло (HMC) — MCMC-алгоритм, использующий концепции гамильтоновой динамики для более эффективного исследования пространства параметров[105]. Его популяризации способствовало появление программного обеспечения, такого как Stan, и алгоритма No-U-Turn Sampler (NUTS), который автоматизировал настройку параметров[106]. Это привело к бурному развитию байесовских вычислений, позволив анализировать сложные модели высокой размерности[107]. Также развивались методы аппроксимированных байесовских вычислений (ABC) для моделей с невычислимой функцией правдоподобия[108].

2020-е: Синергия с ИИ и квантовыми вычислениями

В этот период углубилась интеграция стохастических методов с искусственным интеллектом. MCMC-алгоритмы стали применяться для оценки неопределённости в байесовских нейронных сетях, а техника dropout была интерпретирована как аппроксимация байесовского вывода методом Монте-Карло[109][110]. Пандемия COVID-19 стала катализатором для широкого применения стохастического моделирования в эпидемиологии для прогнозирования распространения инфекции с учётом случайных факторов[111]. Прорывным направлением стало развитие квантового метода Монте-Карло: в 2025 году было продемонстрировано квадратичное ускорение вычислений на ионном компьютере по сравнению с классическими суперкомпьютерами[112]. Эти методы используются для моделирования сложных молекул и материалов[113]. В финансовой сфере алгоритмы были усовершенствованы для учёта «толстых хвостов» распределений, что позволяет лучше оценивать риски редких событий[114]. Сложность современных моделей стимулирует адаптацию алгоритмов Монте-Карло для параллельных и распределённых систем[115].

Компьютерная симуляция

Компьютерная симуляция — моделирование ситуации или системы на компьютере с целью изучения её работы. Изменяя переменные симуляции, можно делать прогнозы поведения системы.

Компьютерная симуляция широко применяется для моделирования физических, химических, биологических процессов, экономических и социальных систем[116]. Обычно такие симуляции сочетают работающие на компьютере модели и набор начальных параметров, невозможный для полного перебора. Многие пакеты программ (например, для метода Монте-Карло, стохастического моделирования, мультиметодического моделирования) позволяют проводить симуляции буквально «в один клик».

Современное понятие «компьютерная симуляция» охватывает практически любые компьютерные представления реального или воображаемого объекта.

В информатике термин «симуляция» имеет несколько специальных значений. Например, Тьюринг под симуляцией понимал выполнение универсальной машины по таблице переходов, описывающей дискретную машину[117].

В компьютерной архитектуре особое место занимают эмуляторы — симуляторы, позволяющие запускать программное обеспечение на несовместимом или несостоявшемся реальном оборудовании (например, при тестировании ещё не собранных микропрограмм или отладке новых схем), а также виртуализация платформ. Симуляторы архитектур являются важным инструментом для проверки проектов, позволяя моделировать работу высокопроизводительных процессоров и сокращать время и затраты на разработку[118]. Таким образом можно полностью контролировать выполнение и собирать информацию о работе компьютера.

В период 2020—2025 годов развитие эмуляции и виртуализации было тесно связано с облачными технологиями и искусственным интеллектом. Технологии виртуализации вышли за пределы традиционных серверов, охватив рабочие столы, приложения, сети и хранилища данных[119]. Широкое распространение получила контейнеризация, в частности Kubernetes, позволяющая абстрагироваться от базовой инфраструктуры[120]. Продолжается совершенствование эмуляторов, таких как QEMU, в которые добавляется поддержка новых процессорных архитектур (например, ARM Cortex Neoverse-V1 и Intel Xeon Granite Rapids)[121]. Искусственный интеллект стал применяться для ускорения симуляций: модели машинного обучения способны предсказывать производительность приложений на основе коротких симуляций, что значительно сокращает время исследования архитектурных решений[122]. Параллельно развиваются и узкоспециализированные эмуляторы, например, для запуска старых операционных систем (86Box) или мобильных приложений на ПК[123][124].

Симуляторы применяются при анализе деревьев отказов, тестировании VLSI логики, исследовании оптимизационных задач (например, с помощью эволюционных вычислений).

Симуляция в образовании и обучении

Симуляция используется в образовании там, где работа с реальным оборудованием слишком дорога или опасна. Так, обучающиеся могут совершать ошибки в «безопасной» виртуальной среде, перерабатывая различные сценарии. Существуют имитации абстрактных концепций (микромиры), которые позволяют лучше понять отдельные идеи и построить программные конструкции для их реализации. Один из первых и наиболее известных примеров — среда Logo, предложенная Сеймуром Папертом. В 2020-е годы, благодаря развитию искусственного интеллекта (ИИ), виртуальной (VR) и дополненной (AR) реальности, интерактивные симуляции стали неотъемлемой частью образовательного процесса, позволяя создавать персонализированные и иммерсивные сценарии обучения.

Симуляционное обучение стало стандартом в подготовке медицинских кадров, позволяя отрабатывать практические навыки без риска для пациентов[125]. С 2010-х годов в России начали активно внедряться хирургические симуляторы для обучения эндоскопии и артроскопии. Современные тренажёры позволяют осваивать широкий спектр манипуляций: от инъекций и забора крови до сложных лапароскопических вмешательств[126].

Важную роль играют «виртуальные пациенты» — интерактивные программы, в которых врачи тренируют коммуникативные навыки, сбор анамнеза и постановку диагноза в реалистичных, но контролируемых условиях[126]. Технологии VR также применяются для хирургического планирования: на основе данных томографии создаются персонализированные 3D-модели органов, что позволяет хирургам репетировать операции с высокой точностью[127]. Развитие онлайн-платформ привело к появлению телесимуляции — совместных тренировок для медицинских работников, находящихся в разных местах[128].

В промышленности и энергетике интерактивные симуляции стали инструментом для повышения безопасности и эффективности. VR/AR-тренажёры активно применяются для подготовки сотрудников к работе на сложном и опасном оборудовании, а также для отработки действий в нештатных ситуациях, например, при пожарах или утечках газа в нефтегазовой отрасли[129]. Исследования показывают, что использование VR-тренажёров повышает мотивацию и вдвое улучшает запоминание информации.

Концепция «промышленной метавселенной» предполагает создание цифровых двойников целых заводов. Это позволяет моделировать рабочие процессы, тестировать новые конфигурации оборудования и обучать персонал в иммерсивной виртуальной среде, прежде чем внедрять изменения в реальном мире. VR-технологии также ускоряют процессы проектирования и прототипирования новых продуктов.

В корпоративном секторе симуляции используются для развития управленческих компетенций. Деловые игры и бизнес-симуляции моделируют реальные рыночные процессы для развития стратегического мышления у менеджеров[130][131]. Симуляция также всё шире применяется в обучении управлению проектами, что способствует закреплению знаний[132][133].

В военной сфере симуляторы включают авиасимуляторы, тренажёры для стрелкового оружия, артиллерии и т. д., часто сочетая различную обратную связь (визуальную, кинестетическую)[134]. Современные технологии позволяют создавать комплексные тактические тренажёры для подготовки и слаживания целых подразделений вплоть до батальона. Высокореалистичные симуляторы для пилотов и водителей бронетехники оснащаются системами виртуальной реальности и динамическими платформами для максимального погружения[135]. Военные ведомства также используют коммерческие симуляторы: например, ВВС США применяли игру Digital Combat Simulator (DCS) для тренировки пилотов штурмовиков A-10[136].

В социальных науках симуляции помогают моделировать политические, экономические и общественные процессы: участники играют роли в вымышленных или исторических обществах, учатся взаимодействию, переговорам, принятию решений[137][138]. Аналогичные тренажёры используются и в подготовке специалистов для международных организаций[139].