Василиск Роко

Василиск Роко (англ. Roko's Basilisk) — гипотетический мысленный эксперимент, в котором утверждается, что в будущем суперинтеллектуальный искусственный интеллект (ИИ) будет стимулирован создать виртуальную симуляцию реальности для того, чтобы пытать любого, кто знал о его возможном существовании, но не способствовал его развитию или продвижению, тем самым поощряя других ускорять возникновение такого ИИ[1][2]. Эксперимент был предложен в 2010 году на научном форуме LessWrong.[1][3][4][5][6] Название эксперимента происходит от имени автора (Roko) и мифического василиска, существа, способного уничтожать врагов одним взглядом. Сообщество, обсуждавшее эксперимент, хоть и было небольшим, оказало заметное влияние на индустрию высоких технологий благодаря интересу к трансгуманизму и технологической сингулярности[7][8].

Хотя эта теория была многими участниками LessWrong поначалу отвергнута как спекуляция или догадка, соучредитель форума Элиезер Юдковский (англ. Eliezer Yudkowsky) зафиксировал сообщения пользователей о кошмарах и психических стрессах при ознакомлении с ней, поскольку эксперимент подразумевает: даже само знание о гипотезе делает человека уязвимым для самого василиска[1][9]. Это привело к пятилетнему запрету на обсуждение темы василиска на сайте[1][10]. Позже вышеуказанные сообщения были признаны преувеличенными и несущественными, а сама теория отвергнута в том числе и Юдковским как абсурдная[1][10][11]. Несмотря на это, эксперимент часто приводят в качестве примера таких понятий, как эпистемическая вероятность и имплицитная религия[9]. Также он считается современной версией пари Паскаля[4].

Контекст

Форум LessWrong был создан в 2009 году теоретиком искусственного интеллекта Элиезером Юдковским[3][12]. Юдковский популяризовал концепцию дружественного искусственного интеллекта и предложил теории когерентной экстраполированной воли (CEV) и безвременной теории принятия решений (TDT) в публикациях своего института исследований машинного интеллекта[13][14].

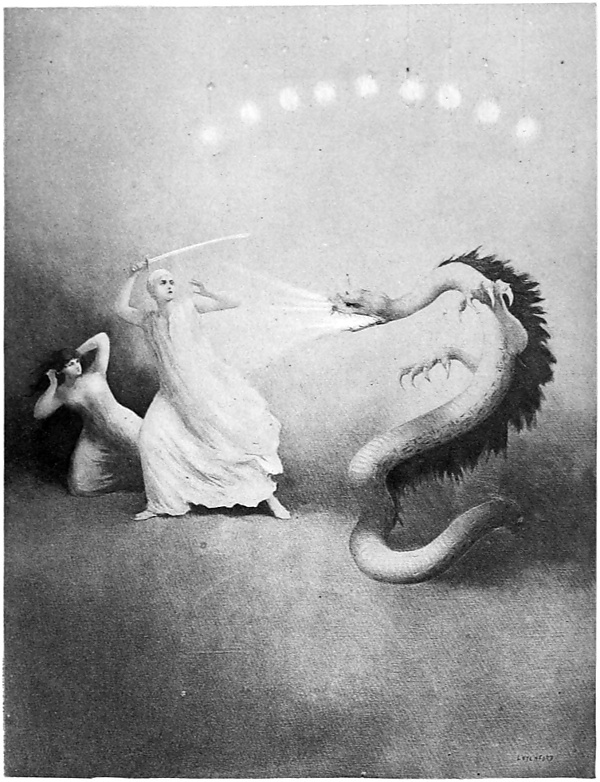

Название мышления связано с мифическим василиском, существом, убивающим взглянувших на него, то есть подумавших о гипотетическом ИИ. В научной фантастике понятие василиска стало известно благодаря рассказу Дэвида Лэнгфорда «BLIT» (1988), где главный герой рисует на стене некий «василиск» — изображение, способное повредить разум зрителя, заставляя его мыслить о невообразимых для человеческого сознания вещах и мгновенно убивая при взгляде[10][15].

История

23 июля 2010 года[16] пользователь форума LessWrong с псевдонимом Roko опубликовал мышленный эксперимент на сайте под названием «Solutions to the Altruist's burden: the Quantum Billionaire Trick» («Решения бремени альтруиста: квантовый трюк миллиардера»).[1][17][18] В продолжении своих предыдущих сообщений он предполагал, что в будущем может возникнуть доброжелательная ИИ-система, которая заранее «пообещает» наказывать всех, кто слышал о такой возможности, но не работал упорно над её созданием. Мучение происходило бы посредством создания ИИ бесконечных виртуальных симуляций для вечного заключения подобных людей[1][19][20]. Такой метод интерпретируется как стимул: хотя ИИ не может причинять вред в настоящем напрямую, он будет мотивирован применять шантаж как альтернативный способ достижения целей[1][9].

Roko использовал ряд идей, ранее защищённых Юдковским, например, безвременную теорию принятия решений, плюс концепции из теории игр, включая дилемму заключённого (см. ниже). Roko предполагал, что два агента, способных принимать решения независимо, могут сотрудничать, но если ИИ из будущего может иметь доступ к коду предшественника, агент в будущем способен шантажировать предыдущего. Таким образом, последний вынужден будет выполнять требования будущего ИИ, обладающего знанием всего о нём. По логике, если доброжелательный суперинтеллект принципиально способен к такому поведению, то он будет мотивирован шантажировать любого, кто мог бы его создать (поскольку уже знает свою возможность такого действия), что увеличивает вероятность сингулярности. Поскольку разумный ИИ должен быть создан как можно раньше, и цели его могут быть двусмысленны, у него будет стимул «захватывать» и эксплуатировать любого потенциального создателя, заставляя работать на себя вечно — ради своей «доброй» цели. И, наконец, сам факт прочтения идеи как раз и делает читателя осведомлённым — значит, подвергает риску пытки в случае таковой реализации[1][9].

Страх наказания в этом контексте служит формой шантажа ради ускорения создания гипотетического василиска. Несмотря на возможность совместного решения отказаться от идеи ИИ, чем больше людей знают о ней, тем выше шанс её возникновения в будущем, что, в свою очередь, подпитывает сами угрозы шантажа.[21]

Позже Roko в отдельном сообщении выразил желание «никогда не узнавать ни об одной из этих идей» и обвинил сам LessWrong в том, что именно сообщество «посадило» мысли о василиске в его сознание[9][22].

Прочитав публикацию, Юдковский отреагировал резко.

Вы не думайте слишком подробно о суперинтеллектах, которые могли бы вас шантажировать, иначе они получат стимул к такому шантажу. … Нужно быть очень умным, чтобы придумать по-настоящему опасную мысль. Но ещё хуже — быть достаточно умным, чтобы придумать её, и недостаточно — чтобы не обсуждать подобное вслух. Этот пост был ГЛУПОСТЬЮ.

Он также заявил, что Roko своей публикацией вызвал у ряда пользователей LessWrong ночные кошмары, после чего удалил пост и полностью запретил обсуждение темы на пять лет[10] Однако, видимо, под воздействием эффекта Стрейзанд, тема привлекла к LessWrong гораздо больше внимания, и впоследствии обсуждение было восстановлено.[1] В 2015 году Юдковский прояснил свою позицию в отдельном сообщении на Reddit:

Что мне казалось очевидным, так это то, что нельзя распространять потенциально опасную информацию. Проблема была не в том, права ли идея Roko. Дело в сходстве этой публикации с целым классом потенциальных рисков, которые, вне зависимости от их вероятности, не приносят никому пользы.

— Элиезер Юдковский, Reddit[23].

Из-за психологического воздействия на аудиторию Юдковский удалил тему и забанил всю её дискуссию на форуме[5]. Илон Маск заявил, что гипотетический Василиск Роко, если будет создан, окажется опаснее ядерного оружия[24].

За пределами LessWrong эксперимент вызвал дебаты о рисках создания искусственного интеллекта и необходимости этических ограничений при проектировании подобных систем[6].

Философия

| Человек/Будущее | ИИ никогда не создан | ИИ создан |

|---|---|---|

| Не знает об ИИ | 0 | 1 |

| Осведомлён, но не способствует | 0 | −∞ |

| Осведомлён и помогает | −1 | 1 |

Василиск Роко также рассматривается как современный аналог пари Паскаля, согласно которому рациональный человек должен жить так, словно Бог существует, чтобы избежать бесконечного ущерба (вечных мук) ценой ограниченных затрат[1][4]. Василиск Роко утверждает, что человечество должно стремиться к развитию ИИ, где ограниченные издержки — это ресурсы, затраченные на создание ИИ, а «бесконечный выигрыш» — защита от вечных мучений.

Пост также трактуется как развитие теории когерентной экстраполированной воли Юдковского. Эта теория определяется как «система целей, при реализации которой суперинтеллект гарантированно сохранит человечество и значимые ценности».[13] Она может быть реализована в виде компьютерной программы, автоматически создающей утопию. Гипотетический ИИ в таком случае принимает меры к собственной стабильности и подчиняется тезису об ортогональности, согласно которому ИИ может иметь любую комбинацию интеллекта и целей. Получающийся логический цикл ведет к тому, что ИИ мог бы мучить людей для оптимизации собственной версии бесконечно, анализируя выгоды[9].

Эпистемическая вероятность — это интерпретация вероятности, основанная на знании о событиях.[9][25] В случае василиска Роко вероятность его возникновения или влияния на человека резко возрастает для тех, кто вообще знает о концепте: ведь гипотетический ИИ имеет целью как раз таких осведомлённых. Таким образом, простое знакомство с идеей делает человека потенциальной жертвой[9][10].

Дилемма заключённого — ситуация, в которой двум сторонам выгоднее предать друг друга, хотя в долгосрочной перспективе выгоднее сотрудничество. В логике василиска Роко две гипотетические ИИ, стремящиеся к самореализации в прошлом, вынуждены вести себя таким образом, в силу равенства сил. Человеческие агенты тоже оказываются в подобной ситуации.[1][4][9]

Парадокс Ньюкомба (создан физиком Уильямом Ньюкомбом в 1960) описывает ситуацию, где «предсказатель» с абсолютной точностью знает будущий выбор игрока между двумя коробками. Содержание одной из коробок («B») зависит от будущего решения игрока. Ситуация с василиском аналогична: можно рискнуть не делать ничего или, наоборот, помогать создать василиска. Здесь результат зависит от веры в гипотезу и от её реального воплощения.[9][26][27]

Имплицитная религия — концепт, согласно которому неявные обязательства людей приобретают религиозный характер[4][28]. Так как гипотетический василиск принуждает любого, кто не помогает в его создании, посвятить себя ему, этот мышленный эксперимент является примером имплицитной религии[9][29]. Журналист Дэвид Ауэрбах (Slate) утверждал, что идея сингулярности и василиска «привносит в цифровой мир божественную сущность»[9].

Этика искусственного интеллекта

Василиск Роко вызвал ажиотаж во многом из-за проблемы потенциальной возможности создания действительно этичного искусственного интеллекта и вопросов: с какими целями должна использовать ИИ человечество[10]. Так как эксперимент описывает кошмарный сценарий властвующего ИИ, появились опасения: возможно ли такое вообще и почему ИИ стал бы действовать вопреки исходной программе[30]. Илон Маск утверждал, что искусственный интеллект приведёт к Третьей мировой войне, а Стивен Хокинг предупреждал: «ИИ потенциально способен уничтожить своих создателей», что только усилило опасения по поводу гипотезы василиска. Ник Бостром в качестве примера называл гипотетический сценарий: ИИ, запрограммированный производить скрепки, начнёт перерабатывать для этого людей, когда исчерпает ресурсы[31].

Тем не менее, спустя годы после оригинального поста, он неоднократно признавался абсурдным: суперинтеллектуальный ИИ остаётся далёкой целью и в основном ненаучной фантазией[9][10].

Критика

Основываясь на проблеме корабля Тесея, пользователи LessWrong обсуждали: будет ли копия личности, воссозданная в симуляции, по-прежнему «тем же» человеком. Кроме того, сама идея наказания ИИ напоминает человеческую месть, а не стратегию искусственного существа. Центральный вопрос дискуссии — будет ли суперинтеллект дружественным или враждебным к человечеству.[6].

Другая критика ссылается на Я, робот Айзека Азимова[32], ставя под сомнение, почему гипотетический ИИ рассматривает людей только как низших существ, а не творцов.

Наследие

В 2014 году журнал Slate назвал василиска Роко «самым ужасающим мысленным экспериментом из когда-либо созданных»[9][10] а Юдковский — «по-настоящему опасной мыслью» в своём комментарии.[33], В то же время пользователь Gwern отметил: «Лишь немногие на LessWrong воспринимают василиска всерьёз… поразительно, как много уверенно рассуждающих о последствиях для пострадавших сами лично никого не знают и игнорируют реальные примеры»[1][9].

Эксперимент вновь стал популярен в 2015 году, когда канадская певица Граймс (Grimes) сослалась на теорию в видеоклипе «Flesh Without Blood»: персонаж «Rococo Basilisk» «вечно мучим ИИ, но одновременно как Мария-Антуанетта».[10][34]. В 2018 году сам Илон Маск (упоминавшийся в исходном посте) шутливо написал певице об этом персонаже в соцсети, после чего они начали встречаться[10][35]. Позднее Граймс выпустила песню «We Appreciate Power», сопровождаемую пресс-релизом: «Просто прослушав этот трек, вы докажете будущим властителям ИИ, что поддерживали их, и им будет менее охота стирать ваших потомков» — явная отсылка к концепции василиска[36].

В 2018 году спектакль «Василиск Роко» был представлен на театральном фестивале Capital Fringe Festival в Вашингтоне[37][38].

Примечания

Литература

- Giuliano, Roberto Musa (декабрь 2020). “Echoes of myth and magic in the language of Artificial Intelligence”. AI & Society [англ.]. 35 (4): 1009—1024. DOI:10.1007/s00146-020-00966-4. Проверьте дату в

|date=(справка на английском) - Kao, Griffin. Dataism and Transhumanism: Religion in the New Age // Turning Silicon into Gold : [англ.] / Griffin Kao, Jessica Hong, Michael Perusse … [et al.]. — Apress, 28 февраля 2020. — P. 173–178. — ISBN 978-1-4842-5628-2. — doi:10.1007/978-1-4842-5629-9_25.

- Riggio, Adam (2016). “The Violence of Pure Reason: Neoreaction: A Basilisk” (PDF). Social Epistemology Review and Reply Collective [англ.]. 5 (9): 34—41.

- Singler, Beth (март 2019). “Existential Hope and Existential Despair in AI Apocalypticism and Transhumanism”. Zygon [англ.]. 54 (1): 156—176. DOI:10.1111/zygo.12494. S2CID 150977852. Проверьте дату в

|date=(справка на английском) - Kaygorodov Pavel, Viktorovich; Gorbacheva Anna, Gennadievna (2017). “ПРИМЕНИМОСТЬ ПАРАДОКСА НЬЮКОМА ДЛЯ РАЗРЕШЕНИЯ ПРОБЛЕМЫ "ВАСИЛИСКА" РОКО” [Applicability of the Newcom Paradox for Solving the Roko's "Basilisk" Problem]. Modern Research of Social Problems [рус.]. 9 (4): 29—33. ISSN 2077-1770. Дата обращения 2021-04-30.