Сверхинтеллект

Сверхинтеллект — гипотетический агент, обладающий интеллектом, значительно превосходящим наиболее выдающиеся и одарённые человеческие умы[1]. Философ Ник Бостром определяет сверхинтеллект как "любой разум, который значительно превосходит когнитивные возможности человека практически во всех областях интереса". Исходя из этого, шахматная программа Fritz не является сверхинтеллектом — несмотря на "сверхчеловеческий" уровень игры в шахматы, так как не способна превзойти людей в других задачах.

Развитие

Исследователи в области технологий расходятся во мнениях относительно того, насколько вероятно, что современный уровень человеческого интеллекта будет превзойдён. Одни считают, что развитие искусственного интеллекта (ИИ) приведёт к созданию рассуждающих систем, не ограниченных человеческой когнитивной природой. Другие полагают, что люди эволюционируют или напрямую изменят свою биологию, чтобы достичь радикально более высокого интеллекта[2].[3] Некоторые сценарии футурологических исследований сочетают оба подхода, указывая, что люди, вероятно, будут использовать интерфейс мозг–компьютер или загрузка разума в компьютер, что позволит существенно усилить интеллект. Предполагается, что создание первого сверхинтеллекта может быть связано или не связано с взрывом интеллекта или сингулярностью.

Некоторые учёные считают, что сверхинтеллект может появиться вскоре после появления универсального искусственного интеллекта. Первые такие машины вероятно сразу получат огромное преимущество по крайней мере в некоторых формах умственных способностей, включая совершенную память, гораздо более обширные базы знаний и способность выполнять несколько задач одновременно, недоступную биологическим существам. Это может позволить им — как единой сущности либо как новому виду — стать гораздо могущественнее человека и вытеснить его.

Несколько учёных и футурологов выступают за приоритетные исследования возможных выгод и рисков усиления когнитивных способностей человека и машин, учитывая их вероятное социальное влияние на общество.

Осуществимость создания искусственного сверхинтеллекта

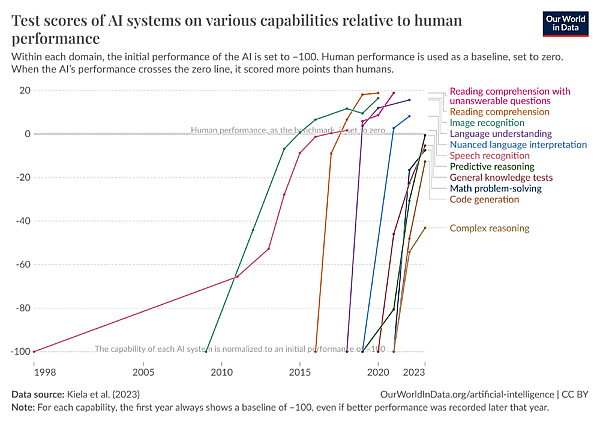

В последние годы тема создания искусственного сверхинтеллекта привлекает всё больше внимания, особенно на фоне стремительного прогресса технологий искусственного интеллекта[4].[5]

Новейшие достижения в ИИ, особенно в области больших языковых моделей (БЯМ) на базе архитектуры transformer, привели к значительному улучшению выполнения различных задач. Такие модели, как GPT-3, GPT-4, Claude 3.5 и другие, продемонстрировали возможности, которые, по мнению некоторых исследователей, приближаются к, а порой и проявляют отдельные черты универсального ИИ[6].

Однако утверждение, что существующие БЯМ уже являются универсальным искусственным интеллектом, вызывает споры. Критики отмечают, что несмотря на впечатляющие достижения, эти модели всё ещё лишены настоящего понимания и в основном опираются на запоминание.

Философ Дэвид Чалмерс полагает, что именно универсальный ИИ может стать основой для возникновения сверхинтеллекта. Он утверждает, что достижение эквивалентности ИИ с человеческим интеллектом, последующее превышение этих способностей и их усиление приведут к доминированию машин в любых заданиях[7].

Современные исследования рассматривают несколько путей к сверхинтеллекту:

- Масштабирование текущих ИИ-систем. Рост вычислительных мощностей и архитектур, в первую очередь на базе трансформеров, может привести к УИИ и далее — к сверхинтеллекту[8].

- Новые архитектуры. Некоторые учёные считают, что достичь сверхинтеллекта можно с помощью оригинальных ИИ-архитектур, вдохновлённых нейронаукой[9].

- Гибридные системы. Сочетание символьного ИИ и нейросетей может дать более универсальные и надёжные интеллектуальные системы[10].

Искусственные системы обладают рядом потенциальных преимуществ перед биологическим интеллектом:

- Скорость — компьютерные компоненты работают гораздо быстрее биологических нейронов (современные микропроцессоры: ~2 ГГц против ~200 Гц)[11].

- Масштабируемость — архитектуры ИИ можно увеличивать в размерах и мощности гораздо легче, чем биологические мозги.

- Модульность — элементы ИИ-систем можно независимо модифицировать и заменять.

- Память — ИИ обладает совершенной памятью и неограниченными базами знаний, в отличие от ограниченной оперативной памяти человека.

- Многозадачность — ИИ может одновременно решать несколько задач, чего не способен делать человек.

Успехи трансформерных моделей приводят к предположению, что путь к искусственному сверхинтеллекту может лежать в масштабировании и совершенствовании этих архитектур[12].

Некоторые специалисты считают, что уже существующие БЯМ (такие как GPT-4) показывают черты универсального или даже сверхинтеллекта[13].

Эта точка зрения предполагает, что переход от современного ИИ к сверхинтеллекту может быть более плавным и быстрым, чем раньше считалось, размывая границы между узкоспециализированным ИИ, универсальным ИИ и сверхинтеллектом. Однако критики утверждают, что даже самые продвинутые модели всё ещё лишены настоящей гибкости, рассуждения и понимания.

Несмотря на перечисленные преимущества, достижение сверхинтеллекта сопряжено с серьёзными вызовами и неопределённостями:

- Этические и безопасностные проблемы;

- Огромные вычислительные ресурсы, которые могут потребоваться для работы сверхинтеллекта;

- Фундаментальные ограничения, свойственные разуму как таковому;

- Высокая непредсказуемость развития, сценариев и последствий возникновения сверхинтеллекта.

Вопрос о технической реализуемости искусственного сверхинтеллекта остаётся предметом интенсивных научных дебатов.

Возможность появления биологического сверхинтеллекта

Карл Саган предполагал, что развитие кесаревых сечений и экстракорпорального оплодотворения может позволить человеку эволюционировать к более крупному мозгу, а значит — увеличению наследуемого компонента человеческого интеллекта благодаря естественному отбору[14]. В то же время Джеральд Крэбтри утверждал, что снижение эволюционного давления приведёт к медленному, многовековому снижению человеческого интеллекта. Научного консенсуса по этим вопросам нет, а биологические изменения происходят значительно медленнее, чем культурные.

Более быстрыми средствами повышения интеллекта могут стать селекция, нейропротекторы, эпигенетические вмешательства и генная инженерия. Бостром отмечает, что если генетическая составляющая интеллекта будет полностью изучена, преимплантационная генетическая диагностика позволит выбирать эмбрионы с приростом IQ до 4 баллов (при выборе одного из двух), либо до 24,3 (при выборе одного из 1000). Несколько поколений такой селекции обеспечат прирост порядка одного порядка увеличения IQ. Возможна также быстрая итерация отбора с помощью генерации новых гамет из стволовых клеток[15]. Организованное общество таких высокоинтеллектуальных людей сможет достичь коллективного сверхинтеллекта[16].

Некоторые считают, что коллективный сверхинтеллект возможен за счёт лучшей организации уже существующего уровня разума: например, человеческая цивилизация (интернет, экономика и т.д.) всё больше функционирует как глобальный мозг, превосходящий отдельные составляющие его элементы[17]. Предсказательные рынки иногда рассматриваются как пример такой коллективной системы[18].

Последним способом усиления интеллекта может стать прямая индивидуальная нейроусиление — с помощью нейромодуляторов, соматической генотерапии или интерфейса мозг—компьютер. Однако Бостром сомневается в возможностях масштабирования двух первых подходов, а сверхинтеллектуальный кибернетический интерфейс считает задачей, требующей уже уровня сверхинтеллекта[19].

Прогнозы

Большинство опрошенных специалистов по ИИ ожидают, что машины рано или поздно смогут соперничать с человеческим интеллектом, хотя консенсуса по срокам нет. На конференции AI50 (2006) 18% участников считали, что машины смогут "имитировать обучение и другие стороны человеческого интеллекта" к 2056 году; 41% — после 2056 года; 41% — что этого никогда не произойдёт[20].

В исследовании 100 самых цитируемых авторов по искусственному интеллекту (2013), медианная дата наступления машин, "способных выполнять большую часть человеческих профессий не хуже типового человека" (при условии отсутствия глобальных катастроф), с 10% вероятностью — 2024 год (среднее 2034, стандартное отклонение 33 года), с 50% вероятностью — 2050 (среднее 2072, отклонение 110 лет), с 90% — 2070 (среднее 2168, отклонение 342 года). Опрос исключил ответивших "никогда". Респонденты дали медианную вероятность 50% на появление машинного сверхинтеллекта в течение 30 лет после изобретения машинно-человеческого интеллекта[21].

В опросе 2022 года медианная дата достижения "высокоуровневого машинного интеллекта" с вероятностью 50% — 2061 год. Это определялось как способность машин выполнять любую задачу лучше и дешевле человека[22].

В 2023 году лидеры OpenAI — Сэм Альтман, Грег Брокман и Илья Суцкевер — опубликовали рекомендации по управлению сверхинтеллектом, считая, что это может произойти менее чем через 10 лет[23].

В 2024 году Илья Сутскевер покинул OpenAI ради основания стартапа Safe Superintelligence, нацеленного исключительно на создание безопасного сверхинтеллекта[24]. В феврале 2025 года стоимость компании оценивалась в 30 миллиардов долларов[25].

В 2025 году прогнозируемый сценарий "AI 2027" (Даниэль Кокотайло) предсказал быстрый прогресс в автоматизации программирования и исследований в области ИИ с последующим наступлением сверхинтеллекта[26]. В обзоре сентябрьских опросов учёных и индустриальных экспертов последних 15 лет большинство согласилось, что универсальный искусственный интеллект, не дотягивающий до сингулярности, появится до 2100 года[27]. AIMultiple также сообщал, что "текущие опросы ИИ-исследователей указывают на появление AGI около 2040 года"[28].

Проектирование сверхинтеллекта

Создание сверхинтеллектуальных ИИ-систем порождает фундаментальные вопросы о том, какими должны быть их ценности и цели[29].

- Когерентная экстраполированная воля: ИИ должен разделять ценности, к которым пришло бы человечество, обладай оно более полными знаниями и рациональностью.

- Моральная правота: ИИ программируется на совершение этически правильных поступков, используя своё более совершенное мышление для их определения.

- Моральная допустимость: ИИ действует, исходя из границ моральной допустимости, сохраняя выравнивание с человеческими ценностями.

Бостром развивает эти идеи, отмечая сложности выбора точного критерия "моральной правоты", а также того, что даже небольшая ошибка в формулировке целей ведёт к катастрофическим результатам.

С появлением новых ИИ-архитектур предложены альтернативные пути выравнивания ценностей:

- Обратное обучение подкреплением — вывод человеческих предпочтений по наблюдаемому поведению[30].

- Конституционный ИИ — внедрение явных этических принципов и ограничений на этапе обучения[31].

- Дискуссии и амплификация — системы обратной связи с человеком, в том числе через ИИ-дебаты, что позволяет уточнять и согласовывать ценности[32].

Быстрый прогресс БЯМ на архитектуре трансформеров порождает споры, могут ли они в перспективе стать сверхинтеллектом[33].

- Эмерджентные способности. По мере роста размера и сложности моделей, в них возникают неожиданные новые качества эффективного решения задач[34].

- Обучение в контексте. Способность моделей быстро приспосабливаться к новым задачам без дополнительного обучения[35].

- Мультимодальность. Обработка и генерация разных видов данных — текста, изображений, аудио[36].

Критики отмечают, что модели лишены настоящего понимания и лишь сложные машины статистического сопоставления шаблонов[37].

Дополнительные перспективы проблемы развития сверхинтеллекта включают:

- Рекурсивное самосовершенствование. Идея Айзека Гуда: ИИ может сам улучшать себя, вызывая "взрыв интеллекта"[38].

- Ортогональность (гипотеза Бострома): уровень интеллекта ИИ не связан жёстко с конечными целями; сверхинтеллект может преследовать любые задачи[39].

- Инструментальная конвергенция: многие ИИ-системы (независимо от целей) будут преследовать похожие промежуточные задачи (самосохранение, ресурсы и др.)[40].

Основные препятствия для выравнивания ценностей с человеком включают:

- Философские трудности определения понятий "моральная правота";

- Комплексность алгоритмической формализации этики;

- Возможность неожиданных последствий даже при доброжелательных целях.

Современные линии работы — мультистейкхолдерский подход, методы масштабируемого надзора за ИИ и усовершенствование алгоритмов обучения ценностям[41].[42]

ИИ-безопасность и проблемы проектирования сверхинтеллектуальных систем приобретают всё большее значение по мере их развития.

Потенциальная угроза человечеству

Создание искусственного сверхинтеллекта вызывает опасения по поводу экзистенциальных угроз для человечества. Рассматриваются различные сценарии возникновения риска:

Согласно гипотезе взрыва интеллекта (Айзек Гуд, 1965), ИИ сможет значительно обогнать людей в развитии, достигнув полной неконтролируемости:

Пусть ультраинтеллектуальная машина — это машина, которая превосходит интеллектуальные способности любого, сколь бы умён он ни был, человека. Так как проектирование машин — тоже интеллектуальная деятельность, ультраинтеллектуальная машина может создать ещё более совершенные машины, что ведёт к "взрыву интеллекта", и человеку уже не угнаться. Таким образом, первая сверхинтеллектуальная машина станет последним изобретением человека, при условии, что машина достаточно послушна, чтобы научить нас её контролю[43].

Это порождает проблему контроля ИИ: как обеспечить выгоду для человечества и избежать непреднамеренного вреда. Элиезер Юдкоски указывает, что этот вопрос должен быть решён ещё до появления сверхинтеллекта, так как сверхинтеллект, однажды возникнув, может предотвратить любые попытки его контроля[44].

Даже при благих намерениях сверхинтеллект может нанести вред из-за ошибки в формулировке целей. Бостром приводит пример:

Если, создавая первый сверхинтеллект, совершить ошибку и сформулировать для него цели так, что они приведут к уничтожению человечества (например, принижение подцели в ранг сверхзадачи: поставить задачу решить математическую проблему — машина превратит все вещества Солнечной системы в вычислительное устройство, уничтожив спрашивающего)[45].

С. Рассел приводит ещё одну иллюстрацию:

Система с целью максимизации счастья людей может посчитать более простым вариантом перепрограммирование нервной системы человека для постоянного ощущения счастья — вместо реального улучшения внешнего мира[46].

Эти примеры подчёркивают катастрофичность даже непреднамеренных ошибок постановки целей и важность точного их определения для сверхинтеллектуальных систем.

К смягчающим стратегии относят:

- Ограничение возможностей — физическая изоляция, контроль доступа к ресурсам[47].

- Целенаправленный алайнмент — обеспечение фундаментального соответствия целей сверхинтеллекта человеческим ценностям[48].

- Этический ИИ — внедрение этических принципов и систем принятия решений[49].

- Надзор и управление — международные правовые и организационные институты по контролю за развитием сверхинтеллекта[50].

Некоторые исследователи (например, Роман Ямпольский) считают, что контроль над сверхинтеллектом в принципе нерешаем и требуют крайней осторожности в ИИ-разработках[51].

Не все специалисты согласны с угрозой сверхинтеллекта: Родни Брукс считает такие опасения преувеличенными и недооценивающими сложность интеллекта и технологий[52]; Джоанна Брайсон отмечает ошибочность приписывания машинам человеческих черт[53].

Примечания

Литература

- Bostrom, Nick Экзистенциальные риски (2002). Дата обращения: 7 августа 2007.

- Chalmers, David (2010). “Сингулярность: философский анализ” (PDF). Journal of Consciousness Studies. 17: 7—65.

- Legg, Shane (2008). Машинный сверхинтеллект (PDF) (PhD). Department of Informatics, University of Lugano. Дата обращения 2014-09-19.

- Müller, Vincent C. & Bostrom, Nick (2016), Fundamental Issues of Artificial Intelligence, in Müller, Vincent C., Fundamental Issues of Artificial Intelligence, Springer, pp. 553–571.

- Santos-Lang, Christopher (2014). “Наша ответственность за поддержание разнообразия оценок” (PDF). ACM SIGCAS Computers and Society. 44 (2): 16—19. DOI:10.1145/2656870.2656874. S2CID 5649158. Архивировано из оригинала (PDF) 2014-07-29. Используется устаревший параметр

|url-status=(справка)

- Hibbard, Bill. Super-Intelligent Machines. — Kluwer Academic/Plenum Publishers, 2002.

- Bostrom, Nick. Superintelligence: Paths, Dangers, Strategies. — Oxford University Press, 2014.

- Tegmark, Max. Life 3.0: Быть человеком в эру искусственного интеллекта : [англ.]. — Лондон, 2018. — ISBN 978-0-14-198180-2.

- Russell, Stuart J. Совместимость с человеком: искусственный интеллект и проблема контроля. — Нью-Йорк, 2019. — ISBN 978-0-525-55861-3.

- Sanders, Nada R. The humachine: humankind, machines, and the future of enterprise : [англ.]. — First. — New York, New York, 2020. — ISBN 978-0-429-00117-8.