Data Pipeline

Data Pipeline (рус. Конвейер данных или поток данных) — это последовательность взаимосвязанных шагов, которые обеспечивают автоматизированный поток данных из одного или нескольких источников в место назначения для хранения, анализа или других целей[1]. Конвейер данных извлекает информацию из источника, вносит необходимые изменения и сохраняет её в определённом месте назначения, обеспечивая эффективное и надёжное перемещение данных для последующего использования в бизнес-аналитике, машинном обучении и других приложениях, основанных на данных[2].

Что важно знать

| Data Pipeline | |

|---|---|

| англ. Data Pipeline | |

| Область использования | Информационные технологии, Большие данные |

Определение

Data Pipeline представляет собой комплексную систему, состоящую из последовательности взаимосвязанных шагов по обработке, необходимых для подготовки корпоративных данных к анализу. На каждом шаге выполняется определённая задача, а результаты передаются на следующий этап. Это своего рода эстафета, где каждый участник выполняет свою часть работы[3].

Основная цель конвейера данных — обеспечить эффективное и надёжное перемещение данных из источников в целевые системы, где они могут быть использованы для отчётности, анализа, машинного обучения и других приложений. Конвейеры данных необходимы там, где требуется систематическое управление сложными рабочими процессами обработки информации[4].

Ключевые характеристики Data Pipeline включают:

- непрерывность — обеспечивает плавный переход задач с одного этапа на другой без прерываний;

- гибкость — помогает легко адаптироваться к изменениям и новым требованиям;

- контроль качества — обеспечивает непрерывный мониторинг и валидацию на каждом этапе;

- масштабируемость — позволяет справляться с различными рабочими нагрузками и расширяться по мере необходимости;

- возможности мониторинга — предоставляет представление о ходе и результатах каждого этапа[4].

Компоненты Data Pipeline

Источник данных — это начальная точка конвейера данных, место, откуда данные извлекаются. Источники могут быть разнообразными и зависят от систем и требований организации:

- базы данных — реляционные (MySQL, PostgreSQL, Oracle) и NoSQL (MongoDB, Cassandra);

- API — веб-сервисы, предоставляющие данные через REST, SOAP, GraphQL или другие протоколы;

- файловые системы — данные в различных форматах (CSV, JSON, XML, Parquet);

- потоковые платформы — источники данных в реальном времени (Apache Kafka, Amazon Kinesis);

- устройства IoT — данные, генерируемые датчиками и другими устройствами[5].

Получение исходных данных представляет собой комплекс мероприятий по извлечению информации из разнородных источников и её транспортировке в целевую систему для последующего хранения и аналитической обработки. В практике работы с данными применяются следующие подходы:

- циклическое извлечение — получение информации через определённые промежутки времени согласно заданному графику;

- непрерывное извлечение — постоянный приём поступающей информации без временных разрывов;

- дифференциальное извлечение — селективный отбор только новых или модифицированных записей относительно предыдущего цикла получения данных[6]

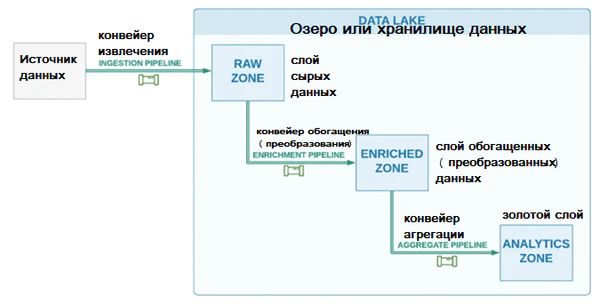

После этапа получения информации возникает необходимость её размещения для обеспечения доступа к последующим операциям обработки и анализа. Современная архитектура данных предусматривает различные варианты хранилищ:

- аналитические хранилища — структурированные репозитории, оптимизированные для выполнения сложных аналитических запросов;

- информационные озёра — хранилища, содержащие необработанные данные в их первоначальном виде и формате;

- буферные хранилища — промежуточные зоны временного размещения данных в процессе их трансформации[7].

Затем информация обрабатывается для последующей трансформации или передачи пользователю. Среди основных методов обработки выделяют:

- обработку массивами (пакетную) — метод, позволяющий единовременно работать с крупными массивами информации;

- обработку в реальном времени (потоковую) — подход, ориентированный на непрерывное преобразование поступающих данных;

- параллельную обработку на множестве вычислительных узлов (распределённую) — технологию одновременного выполнения операций на нескольких серверах.

При трансформации данных происходит модификация их формата, структуры или содержания в соответствии с требованиями принимающей системы. Этот этап включает:

- санацию информации — выявление и исправление ошибок, исключение отсутствующих значений и повторяющихся записей;

- расширение контекста — комбинирование информации из различных источников для получения более полной картины;

- сведение и обобщение — консолидацию наборов данных для упрощения последующего анализа;

- структурное преобразование — изменение формата представления или реорганизацию структуры данных.

Аналитический этап подразумевает исследование, трансформацию и построение моделей для извлечения ценных сведений. В рамках этого процесса выделяют:

- ретроспективный анализ — изучение произошедших событий;

- причинно-следственный анализ — выявление факторов, повлиявших на наблюдаемые явления;

- прогностический анализ — моделирование вероятных сценариев развития;

- рекомендательный анализ — формирование стратегий действий на основе полученных данных.

Завершающим этапом выступает передача обработанной информации конечным пользователям. Она может осуществляться посредством:

- визуализации в форме отчётов и информационных панелей;

- программных интерфейсов, обеспечивающих взаимодействие с другими информационными системами;

- экспорта данных в файлы различных форматов.

Типы и виды Data Pipeline

Пакетная обработка предполагает обработку данных группами через определённые интервалы. Подход применяется для обработки больших объёмов данных, когда нет необходимости в немедленном результате.

| Преимущества: | Недостатки: |

|---|---|

|

|

Примеры использования: ежедневные отчёты о продажах, еженедельный анализ клиентских данных, ежемесячные финансовые отчёты[3].

Потоковая обработка идёт непрерывно, по мере поступления данных в режиме реального времени.

| Преимущества: | Недостатки: |

|---|---|

|

|

Примеры использования: мониторинг активности пользователей на веб-сайте, обнаружение мошенничества в реальном времени, анализ данных с датчиков IoT[4].

Гибридные архитектуры сочетают элементы пакетной и потоковой обработки для получения преимуществ обоих подходов.

Lambda-архитектура включает три слоя:

- cлой пакетной обработки для точных, но отложенных результатов;

- cлой скоростной обработки для результатов в реальном времени;

- cлой обслуживания для объединения результатов обоих слоёв.

Kappa-архитектура упрощает Lambda-архитектуру, используя единую систему потоковой обработки как для данных в реальном времени, так и для исторических данных[4].

Сравнение и отличия Data Pipeline от ETL

Процесс ETL (от англ. Extract, Transform, Load — извлечение, преобразование, загрузка) и Data Pipeline зачастую решают схожие задачи, однако между ними есть существенные функциональные различия[8]:

| Характеристика | ETL | Data Pipeline |

|---|---|---|

| Назначение | Специализируется на перемещении данных из операционных систем в хранилища данных | Более общий термин, охватывающий любое автоматизированное перемещение данных |

| Гибкость | Обычно имеет фиксированную структуру: извлечение, преобразование, загрузка | Может включать различные этапы и процессы, не ограничиваясь тремя шагами ETL |

| Направление данных | Обычно однонаправленный (из источника в хранилище) | Может быть однонаправленным или двунаправленным |

| Обработка данных | Преобразование обычно происходит до загрузки в целевую систему | Преобразование может происходить на любом этапе конвейера |

| Частота обновления | Традиционно пакетная обработка | Может быть пакетной, потоковой или гибридной |

ETL можно рассматривать как специфический тип Data Pipeline, ориентированный на загрузку данных в хранилище. С развитием технологий и появлением потребности в обработке данных в реальном времени, традиционные ETL-процессы эволюционировали в более гибкие и мощные конвейеры данных[3][9][8].

Преимущества и недостатки

Безошибочно спроектированный конвейер данных предлагает ряд существенных преимуществ для организаций[6][8].

- Автоматизация процессов — снижение ручного вмешательства и связанных с ним ошибок;

- масштабируемость — возможность обрабатывать растущие объёмы данных;

- надёжность и отказоустойчивость — механизмы восстановления после сбоев;

- гибкость и адаптивность — возможность адаптации к изменяющимся требованиям;

- повышение качества данных — встроенные механизмы проверки и очистки данных;

- централизованное управление — единая точка контроля для всех процессов обработки данных;

- повышение производительности — оптимизация использования ресурсов;

Вместе с тем разработка, настройка и поддержка конвейера являются весьма ресурсозатратными мероприятиями, а искажение в исходных данных может сделать полностью неэффективной всю систему[10][8].

- Сложность разработки и поддержки — требуются специализированные навыки и знания;

- требования к инфраструктуре — необходимость в надёжной и масштабируемой инфраструктуре;

- проблемы безопасности — риски, связанные с перемещением и хранением данных;

- стоимость внедрения и эксплуатации — затраты на инструменты, инфраструктуру и персонал;

- зависимость от качества исходных данных — проблемы с источниками данных могут повлиять на весь конвейер;

- сложность отладки — трудности в выявлении и устранении проблем в распределённых системах.

Сферы применения

Data Pipeline находит применение во многих отраслях и сценариях использования:

- бизнес-аналитика и отчётность — сбор и подготовка данных для бизнес-отчётов и дашбордов;

- машинное обучение и искусственный интеллект — подготовка данных для обучения и тестирования моделей;

- интернет вещей (IoT) — обработка данных с датчиков и устройств;

- финансовый сектор — анализ рыночных данных, обнаружение мошенничества, оценка рисков;

- электронная коммерция — анализ поведения пользователей, персонализация рекомендаций;

- здравоохранение — анализ медицинских данных, исследования;

- телекоммуникации — анализ использования сети, оптимизация инфраструктуры;

- маркетинг — анализ эффективности кампаний, сегментация клиентов;

- логистика — оптимизация маршрутов, управление запасами;

- производство — мониторинг оборудования, контроль качества.

Инструменты для разработки и настройки Data Pipeline

- Apache NiFi — платформа для автоматизации потоков данных между системами;

- airbyte — платформа с открытым исходным кодом для интеграции данных;

- talend — набор инструментов для интеграции данных, управления данными и приложениями;

- stitch — облачное решение для интеграции данных;

- fivetran — автоматизированная платформа для интеграции данных.

- Apache Spark — унифицированная аналитическая система для обработки больших данных;

- apache Flink — платформа для потоковой обработки данных;

- apache Beam — унифицированная модель программирования для пакетной и потоковой обработки;

- dask — библиотека для параллельных вычислений на Python;

- ray — фреймворк для масштабирования приложений Python.

- Apache Airflow — платформа для программирования потоков обработки данных;

- prefect — современная платформа для оркестрации рабочих процессов;

- dagster — система оркестрации данных для разработки, производства и наблюдения за конвейерами данных;

- luigi — библиотека Python для построения конвейеров данных;

- argo Workflows — инструмент оркестрации рабочих процессов для Kubernetes.

- AWS Data Pipeline — веб-сервис для обработки и перемещения данных между различными сервисами AWS;

- Google Cloud Dataflow — унифицированная потоковая и пакетная обработка данных;

- Azure Data Factory — облачная служба интеграции данных;

- Yandex Data Transfer — сервис для переноса данных между различными источниками и приёмниками;

- Snowflake Data Pipeline — функциональность для непрерывной загрузки данных в Snowflake.