Искусственный интеллект в проектах Wikimedia

Искусственный интеллект в проектах Wikimedia (англ. Artificial intelligence in Wikimedia projects) — использование искусственного интеллекта для развития и поддержки проектов Wikimedia[1].

Описание

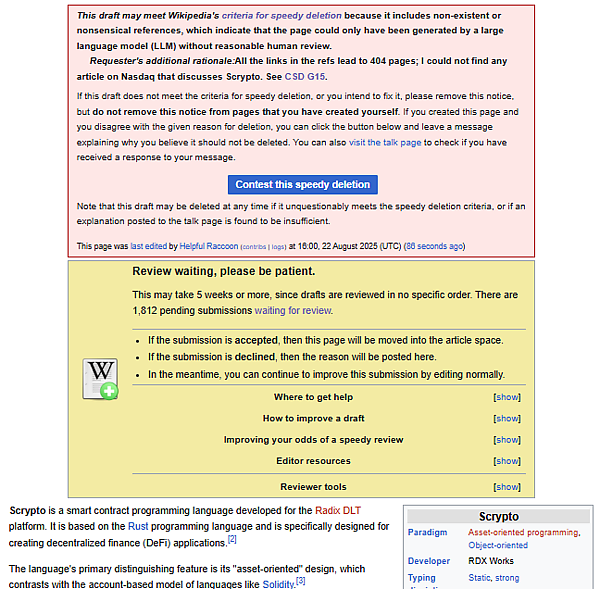

Ряд статей в Википедии были созданы полностью или частично с помощью искусственного интеллекта. Контент, сгенерированный ИИ, может быть вреден для Википедии, если он является недостоверным или содержит поддельные ссылки на источники.

Для борьбы с низким качеством автоматически сгенерированных материалов в 2023 году сообществом Википедии был создан проект Очистка от ИИ-контента. В августе 2025 года была принята политика, позволившая редакторам выставлять подозрительные на автогенерацию статьи на быстрое удаление.

Использование искусственного интеллекта для Википедии

Проект Objective Revision Evaluation Service (ORES) — сервис искусственного интеллекта для оценки качества правок в Википедии[2][3]. Фонд Викимедиа представил проект ORES в ноябре 2015 года[4].

В августе 2018 года компания Primer сообщила о попытке использовать искусственный интеллект для создания статей о женщинах с целью борьбы с гендерной предвзятостью в Википедии[5][6].

После публичного запуска ChatGPT в 2022 году начались эксперименты по написанию статей в Википедии с помощью ИИ. Это вызвало споры о допустимости использования большие языковые модели (Large language models, LLM) из-за их склонности генерировать правдоподобно звучащую дезинформацию, включая несуществующие ссылки; несоответствие энциклопедическому стилю и воспроизведение предвзятостей[7][8]. С 2023 года шла работа по подготовке политики Википедии по отношению к ChatGPT и аналогичным LLM, в том числе рекомендовалось пользователям, не знакомым с такими инструментами, воздерживаться от их применения из-за вышеописанных рисков, а также отмечались риски клеветы и нарушения авторских прав[8].

6 декабря 2022 года участник Pharos создал статью «Artwork title» в своём черновике, указав, что использовал ChatGPT для экспериментов и будет дорабатывать её вручную. Другой редактор пометил статью как «оригинальное исследование», указав, что первоначально это был автосгенерированный текст без источников, а ссылки добавлены затем, а не использованы с самого начала. Другой участник, также тестировавший ранний ChatGPT, отметил, что его обзор темы был приемлем, но ссылки были вымышленными[9]. Фонд Wiki Education отмечал, что опытные редакторы считают ИИ полезным для черновиков и новых статей, но предупреждал о склонности ChatGPT использовать рекламные формулировки и другие проблемы[10]. Мигель Гарсия, бывший член Wikimedia из Испании, утверждает, что с запуском ChatGPT число автосгенерированных статей резко выросло, но затем стабилизировалось благодаря усилиям сообщества: большинство статей без источников удаляются быстро или номинируются на удаление[11].

В 2023 году сообщество Википедии создало проект AI Cleanup, помогающий удалять низкокачественный ИИ-контент. В октябре 2024 года исследование Принстонского университета показало, что около 5 % из 3000 новых статей англоязычной Википедии, созданных в августе 2024 года, были написаны с помощью искусственного интеллекта. Было установлено, что иногда ИИ использовался просто как вспомогательное средство, но часть публикаций носила рекламный или политический характер[12][13].

В августе 2025 года политика Википедии официально разрешила номинировать статьи, подозреваемые в автосгенерации, на быстрое удаление. Такие статьи обычно узнают по не относящимся к теме или вымышленным сноскам, а также характерной формулировке. Например, если статья написана в стиле ответа LLM («Вот ваша статья по теме…», «На момент моего последнего обучения…»), она обычно помечается на удаление[12][14]. Другие признаки использования ИИ: чрезмерное употребление длинных тире, слова «более того», рекламных выражений («захватывающий»), а также некорректные кавычки. В процессе обсуждения политики быстрых удалений один рецензент отмечал «поток ужасных автосгенерированных черновиков», другие пользователи жаловались на «ложь и поддельные ссылки» в подобных статьях и большие затраты времени на исправление последствий[15][16].

Основатель WikiProject AI Cleanup Ильяс Леблю и другие редакторы отмечают, что по ряду особенностей — неестественному языку, массовому производству правдоподобного, но лживого контента — возможно выявлять поддельные статьи-обманы, которые приходится оперативно удалять[17][18]. Википедия создала руководство по распознаванию признаков ИИ-текста — Signs of AI writing[19].

В 2023 году учёные выявили частые случаи фабрикации данных и ссылок в ChatGPT. В тот период полный запрет на ИИ в Википедии сочли слишком жёстким решением[20][21]. ИИ использовался для создания различных мистификаций: например, статья объёмом 2000 слов про несуществующую османскую крепость была разоблачена Ильясом Леблю и его командой[22][23]. В другом случае в статью о Estola albosignata (жук) был вставлен сфабрикованный абзац, который ссылался на нерелевантный источник[24].

ИИ применялся для продвижения политической повестки в контентных разделах Википедии.

В 2025 году Фонд Викимедиа начал тестировать функцию «Simple Article Summaries», автоматически генерируемую ИИ-сводку содержания статей, аналогично AI Overviews в Google Search. Решение вызвало быструю и жёсткую критику редакторов Википедии, отметивших снижение доверия к ресурсу из-за склонности ИИ к галлюцинациям и отсутствие очевидной необходимости такой функции[25]. В результате Фонд Викимедиа приостановил внедрение функции, но сохранил интерес к дальнейшей интеграции генеративного ИИ[26].

Использование Википедии для искусственного интеллекта

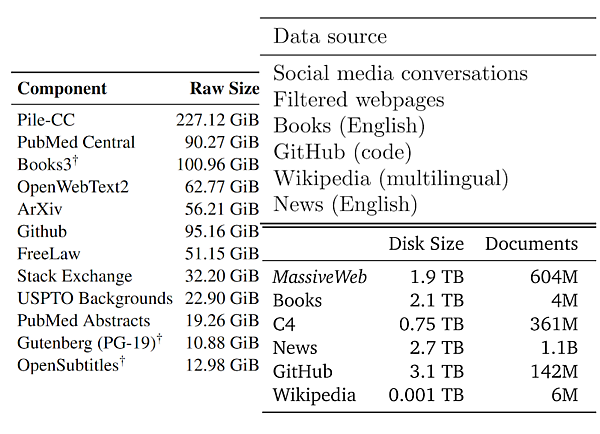

При создании Google Perspective API — инструмента для оценки токсичности комментариев на форумах, был использован датасет из сотен тысяч обсуждений на страницах Википедии, где люди вручную разметили токсичность сообщений[28]. Подкорпуса Википедии считаются одними из крупнейших и наиболее тщательно обработанных выборок для обучения ИИ[29].

По данным работы 2012 года, более 1000 научных публикаций (включая ИИ-исследования) анализировали Википедию, повторно использовали её тексты, применяли технические расширения или исследовали коммуникацию на её платформе[30]. Работа 2017 года характеризует Википедию как «золотую жилу» для любого машинного обучения на человеческих текстах[31].

В проекте-обзоре «Столетнее исследование искусственного интеллекта» (2016) Википедия названа важной платформой для изучения взаимодействия ИИ и человеческого участия[32].

Существует опасение по поводу отсутствия атрибуции Википедии при обучении языковых моделей типа ChatGPT[29][33]. Хотя лицензия Википедии позволяет использовать её тексты даже в переработанном виде, она требует обязательного указания авторства, поэтому интеграция Википедии как источника для ИИ без раскрытия происхождения может идти вразрез с условиями использования[29].

Использование искусственного интеллекта для других проектов Wikimedia

Detox — исследовательский проект Google и Фонда Викимедиа по методикам борьбы с грубостью и токсичными высказываниями в обсуждениях сообществ Wikimedia[34]. В числе прочего Wikimedia Foundation и Jigsaw экспериментировали с искусственным интеллектом для поиска и разработки технических решений данной проблемы. В октябре 2016 года эти организации опубликовали исследование «Ex Machina: Personal Attacks Seen at Scale»[35][36]. Мирные СМИ освещали эти исследования и их социальный контекст[37][38][39]. Для перевода статей используются системы машинного перевода, такие как DeepL[40][29][41].

Реакция

В ноябре 2023 года сооснователь Википедии Джимми Уэйлс отметил, что искусственный интеллект не является достоверным источником и что он не будет использовать ChatGPT для написания статей. В июле 2025 года он предложил использовать LLM для предоставления индивидуальных подсказок участникам при отклонении черновиков[42].

Директор по продукту фонда Викимедиа Маршалл Миллер заявил, что проект AI Cleanup поддерживает нейтральность и надёжность сайта, а ИИ способствует созданию низкокачественного контента. В интервью 404 Media Ильяс Леблю назвал быструю политику удаления лишь «пластерем» для наиболее серьёзных проблем, подчеркнув, что фундаментальная проблема остаётся. Некоторые ИИ-статьи, по его словам, обсуждаются до недели перед удалением[43].

Примечания

Литература

- Nielsen, Finn Årup (2012). “Wikipedia Research and Tools: Review and Comments”. SSRN Working Paper Series [англ.]. DOI:10.2139/ssrn.2129874. ISSN 1556-5068.

- Mehdi, Mohamad; Okoli, Chitu; Mesgari, Mostafa; Nielsen, Finn Årup; Lanamäki, Arto (март 2017). “Excavating the mother lode of human-generated text: A systematic review of research that uses the wikipedia corpus”. Information Processing & Management. 53 (2): 505—529. DOI:10.1016/j.ipm.2016.07.003. S2CID 217265814. Проверьте дату в

|date=(справка на английском) - Wulczyn, Ellery. Ex Machina: Personal Attacks Seen at Scale // Proceedings of the 26th International Conference on World Wide Web / Ellery Wulczyn, Nithum Thain, Lucas Dixon. — 2017. — P. 1391–1399. — ISBN 9781450349130. — doi:10.1145/3038912.3052591.