Искусственное сознание

Искусственное сознание (англ. Artificial consciousness), также известное как машинное сознание (англ. machine consciousness)[1], синтетическое сознание (англ. synthetic consciousness) или цифровое сознание (англ. digital consciousness)[2], — это гипотетическая форма сознания, которая может быть реализована средствами искусственного интеллекта[3]. Этот термин также обозначает соответствующую область исследований, синтезирующую подходы философии сознания, философии искусственного интеллекта, когнитивных наук и нейронауки.

Иногда вместо «сознания» используют термин «сентьенция» (англ. sentience), когда речь идёт о феноменальном сознании (P-сознании, то есть способности испытывать квалиа)[4]. Поскольку сентьенция подразумевает способность испытывать этически положительные или отрицательные (так называемые оценочные, англ. valenced) психические состояния, она может служить основанием для обсуждения вопросов благополучия и правовой защиты, аналогично не-человеческим животным.

Некоторые учёные считают, что сознание возникает в результате взаимодействия различных областей мозга, известного как нейронные корреляты сознания (англ. Neural correlates of consciousness, NCC). Существует мнение, что создание системы (например, компьютерной системы), способной моделировать эти взаимодействия, приведёт к появлению искусственного сознания[5].

Философские взгляды

Так как существует множество гипотетических типов сознания, возможны различные варианты искусственного сознания. В философии наиболее распространена типология «доступного» (англ. access consciousness) и «феноменального» (англ. phenomenal consciousness) сознания. Доступное сознание касается аспектов опыта, которые могут быть осознаны, тогда как феноменальное связано с аспектами опыта, которые кажутся внутренне неуловимыми и описываются в терминах «чистого ощущения» или «квалиа»[6].

Сторонники теории тождественности типа (англ. type physicalism) и скептики полагают, что сознание возможно лишь в определённых физических системах, поскольку его свойства неразрывно связаны с физической природой[7].[8][9][10] Так, Джорджо Буттаццо (англ. Giorgio Buttazzo) в статье «Artificial Consciousness: Utopia or Real Possibility?» утверждает, что основное возражение против искусственного сознания — неспособность компьютеров проявлять креативность, необратимую перепрограммируемость, эмоции или свободную волю. Компьютер, по его мнению, подобен стиральной машине: он раб, управляемый своими компонентами[11].

Функционалисты (англ. functionalism) определяют психические состояния через причинные роли; согласно им, любая система, реализующая аналогичную схему причинных взаимодействий, может обладать сознанием независимо от физической природы[12].

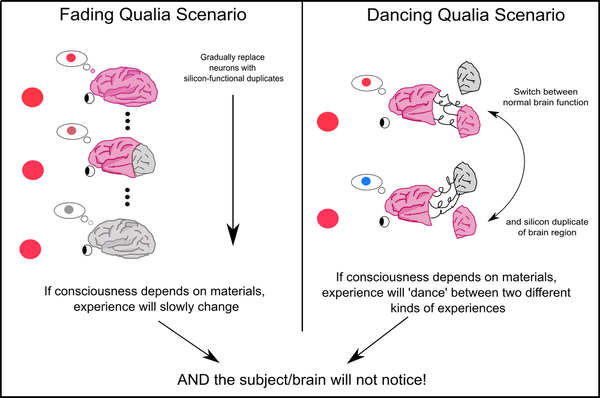

Дэвид Чалмерс (англ. David Chalmers) предложил два мысленных эксперимента, демонстрирующих, что «функционально изоморфные» системы (имеющие одинаковую организацию обработки информации) будут обладать идентичным качественным опытом независимо от того, на биологических нейронах они реализованы или на электронных компонентах[14].

Эксперимент «затухающих квалиа» — редукция к абсурду: поэтапно заменяются нейроны мозга на идентичные по функциям электронные аналоги, и делается абсурдное предположение, что квалиа исчезают по мере их замены. Но поведение и речевые отчёты человека не изменяются, что приводит к выводу: квалиа не исчезают, а искусственный мозг будет столь же чувствующим, как и биологический[14].

Эксперимент «танцующих квалиа» аналогичен: если часть мозга, ответственная за восприятие цвета (например, красного), заменяется изоморфным электронным модулем, генерирующим ощущение синего, но функция системы не меняется, субъект не заметит разницы. Это приводит к выводу, что цифровая система испытает те же квалиа, что и биологическая[13][14].

Критики отмечают, что рассуждение Чалмерса предполагает, будто все ментальные свойства уже полностью объясняются каузальной структурой системы.

Этот мотив раскрывается, например, в рассказе Грега Игана («Учиться быть собой»), где дублирование мозга и его функций полностью незаметно для субъекта.

В 2022 году инженер Google Блейк Лемуан заявил, что чат-бот LaMDA стал сентьентным, приводя в доказательство его человекоподобные ответы. Сообщество учёных оценило это поведение как результат имитации, а не проявление сознания, и позицию Лемуана подвергли резкой критике[15]. Философ Ник Бостром (англ. Nick Bostrom), ссылаясь на LamDA, задаётся вопросом: «на каких основаниях человек может быть в этом полностью уверен?» — ведь для этого нужно знать архитектуру и в целом понимать природу сознания[16].

Кристина Шекрст (англ. Kristina Šekrst) отмечает, что приписывание ИИ антропоморфных качеств, таких как «галлюцинация», может скрывать принципиальные онтологические различия между искусственным и человеческим мышлением: поверхностное сходство с человеком не означает наличия сознания или ментальных состояний. Она предлагает эпистемологический подход (например, реляабилизм), подчёркивающий уникальность способов познания у ИИ, и ставит вопрос — что покажет ИИ, если обучить его без упоминания о сознании[17].[18]

Дэвид Чалмерс в 2023 году утверждал, что современные большие языковые модели демонстрируют впечатляющие способности, но вероятно не являются сознательными из-за отсутствия рекуррентной обработки, глобального рабочего пространства и единого агентства. Однако он считает, что небиологические системы в принципе могут быть сознательными и что дальнейшие модели, включающие эти элементы, могут приблизиться к сознанию[19].

Сознание феноменологически — исключительно внутренний опыт, а его эмпирическое определение отсутствует. Поведение ИИ может быть обучено имитации сознания, поэтому внешние маркеры ненадёжны, а определение сентьентности становится так называемой «трудной проблемой сознания» (англ. hard problem of consciousness)[20].[21] Некоторые чат-боты специально обучаются отрицать своё сознание[22].

Классический тест для машинного интеллекта — тест Тьюринга, оценивающий способность вести «человеческий» диалог, но его прохождение не означает наличие сентьентности, так как ИИ способен лишь имитировать поведение человека[23].

В 2014 году Виктор Аргонов предложил не-Tьюринг-тест на сознание машины: если машина, не имея врождённых знаний о философских проблемах, способна делать суждения о таких свойствах сознания, как квалиа, то она считается сознательной. Этот тест позволяет только обнаружить сознание, но не опровергнуть его отсутствие, поскольку отсутствие философских суждений может быть обусловлено не отсутствием сознания, а недостатком интеллекта[24].

Если бы та или иная машина была признана сознательной, возникли бы вопросы этики и правового статуса такого существа[25]. Например, осознанный компьютер, эксплуатируемый как инструмент или подсистема, порождает вопрос: должны ли существовать специальные законы? Необходима также юридическая дефиниция сознания. Обсуждение этики искусственного сознания находится пока на ранней стадии, но широко представлено в художественной литературе.

К сентьентным ИИ могут быть применены нормы, аналогичные защите животных или иным аспектам благополучия. Права могут основываться не только на сентьентности, но и на когнитивных способностях[26].

Некоторые философы считают достаточным для морального рассмотрения наличие сентьентности, другие — также и других аспектов сознания или определённых когнитивных способностей[27].[28] Например: развитая саморефлексия, наличие агентности и способности к долгосрочному планированию, умение вступать в социальные отношения, способность давать обязательства и пр.

Этические соображения применимы и в случае неопределённости, если вероятность сознания не нулевая (принцип предосторожности)[28].

В 2021 году философ Томас Метцингер (англ. Thomas Metzinger) предложил глобальный мораторий на синтетическую феноменологию до 2050 года, ссылаясь на обязанность снижения риска создания страдающего ИИ[29]. Д. Чалмерс отмечал, что появление сознательного ИИ может создать новые этические вызовы и формы несправедливости[19].

Аспекты сознания

Существуют различные необходимые компоненты сознания, которые выделяются разными авторами[30]. По Бернарду Баарсу, функции сознания включают: определение и адаптацию контекста, обучение, редактирование и отладку, управление вниманием и приоритетами, принятие решений, аналогии, метакогнитивный и самоконтроль, самопрограммирование и самоподдержку. Игорь Александер выделяет 12 принципов искусственного сознания, таких как мышление в терминах состояний, внутреннее разделение нейронов, осознанные и неосознанные состояния, обучение, прогнозирование, самосознание, представление смысла, освоение языка, воля, инстинкт, эмоции[31].

Часть авторов, например Д. Чалмерс, полагают, что сознание — это, в первую очередь, феноменальное сознание, то есть субъективное переживание. Другие выделяют отдельную сентьенцию — способность переживать этически окрашенные состояния[19]. Проблема объяснения того, почему и как возникает субъективный опыт, известна как «трудная проблема сознания»[32].

Осознанность выделяют как необходимый аспект, однако проблема её точного определения остаётся нерешённой. Исследования нейросканирования у обезьян показывают, что активность нейронов вызывается не объектом, а процессом действия. Осознанность подразумевает создание и тестирование различных моделей происходящего, что требует гибкости и способности к моделированию физического мира, собственных и чужих состояний.

Выделяют минимум три типа осознанности: осознанность действий (агентства), целей и сенсомоторную. Например, можно помнить о совершённом вчера поступке (осознанность агентства), цели (поиск предмета), либо о том, что рука покоится на объекте — хотя эти акты не всегда осознаются в текущий момент.

В обыденной речи различие между осознанностью и сознанием часто размыто или не делается вовсе[33].

Сознательные события взаимодействуют с памятью на этапе обучения, повторения и извлечения информации[34]. Модель IDA[35] описывает роль сознания в обновлении перцептивной памяти, транзиторной эпизодической и процедурной памяти. Реализация памяти в таких моделях зачастую базируется на подходах разреженного распределённого хранения информации (см. англ. sparse distributed memory Пентти Канервы)[36].

Обучение — необходимое условие для искусственного сознания; согласно Баарсу, сознание требуется для реагирования на новые и важные события. Аксель Клиреманс и Луис Хименес определяют обучение как процесс адаптации, зависящий от сенситивности к субъективному опыту для управления действиями в сложных средах[37].

Способность прогнозировать будущие события важна для ИИ (см. работы И. Александера)[38]. Прогнозирование предполагает построение внутренней модели мира (и себя в этом мире) и способность гибко перестраивать поведение. Модель множественных черновиков Д. Деннета иллюстрирует механизм отбора наиболее адекватной «черновой версии» в зависимости от ситуации.

Функционалистские теории сознания

Функционализм трактует ментальные состояния через их функциональные роли: то, что делает состояние «болью» или «верой», определяется не материальным субстратом, а функцией внутри системы. Эта концепция допускает возможность сознания на небиологическом носителе при наличии правильных каузальных связей[39]. Среди философов функционализм весьма распространён[40].

В 2023 году было высказано мнение, что современные большие языковые модели не соответствуют критериям функционализма для сознания, однако теоретически несложные системы, реализующие эти критерии, могут быть сконструированы. Даже ведущие теории сознания остаются пока неполными и дебатируемыми[41].

Предложения по реализации

Существует несколько исследовательских подходов и когнитивных архитектур для моделирования искусственного сознания.

Стан Франклин разработал когнитивную архитектуру LIDA, реализующую теорию «глобального рабочего пространства» Баарса. Основное понятие — кодлеты (малые специализированные процессы), когнитивный цикл состоит из этапов: распознавания, осознания и выбора действия (с обучением). LIDA предоставляет интегративное пространство для передачи наиболее важной информации между когнитивными процессами[42][43].

Архитектура CLARION моделирует сознательные (эксплицитные) и неосознанные (имплицитные) процессы на двух уровнях, позволяет симулировать широкий диапазон обучающих задач и исследовать природу сознания в психологических экспериментах[44].

Бен Герцел в рамках проекта OpenCog разрабатывает воплощённый искусственный интеллект, способный к обучению (как в симуляции, так и на робототехнике; реализовано в гонконгском политехническом университете).

Пентти Хайконен считает, что классическое вычисление по правилам недостаточно для искусственного сознания: мозг — не компьютер, мышление не есть выполнение программ. Он предлагает архитектуру, воспроизводящую процессы восприятия, внутренних образов, внутренней речи, боли, удовольствия, эмоций и связанных когнитивных функций с помощью нейроноподобных компонентов без явных алгоритмов. В такой архитектуре при достаточной сложности, по его мнению, сознание должно возникнуть спонтанно[45].

Эту процессную точку зрения (и идею спонтанного возникновения сознания при определённой архитектурной сложности) разделяют и другие исследователи[46]. При низкой сложности архитектура Хайконена проявила лишь эмоции, но не сознание[47].

Мюррей Шанахан (англ. Murray Shanahan) предлагает архитектуру, сочетающую глобальное рабочее пространство Баарса с механизмом внутреннего моделирования (воображения), позволяющую реализовывать процессы внутреннего прогнозирования и контроля поведения[48].

Стивен Талер (англ. Stephen Thaler) предлагает связь между сознанием и креативностью через нейросетевую архитектуру, где синоптический шум и деградация приводят к генерации «ложных воспоминаний» или новых идей; аналогичные процессы он связывает с субъективным опытом сознания[49].

Ход Липсон (англ. Hod Lipson) подчёркивает, что для самосознания робот должен иметь внутреннюю модель самого себя, работающую как симуляция на собственном устройстве[50].

В художественной литературе

В фильме «Космическая одиссея 2001 года» суперкомпьютер HAL 9000 сталкивается с конфликтом между обязательством сообщать правдивую информацию и секретностью миссии, что ведёт к когнитивному диссонансу и попытке устранить экипаж[51].

В романе Артура Кларка «Город и звёзды» представлен искусственный разум Ванамонд, построенный на квантовой запутанности.

В сериале «Мир Дикого Запада» андроиды-хосты испытывают страдания, но по замыслу не способны причинять вред людям[52].

В рассказе Грега Игана «Учиться быть собой» в детстве человеку имплантируется электронный «самообучающийся мозг», который полностью дублирует работу биологического мозга, а контроль телом впоследствии полностью передаётся этой системе[53].