Модели на основе трансформеров

Модели на основе трансформеров (часто встречается название трансформерные модели) — класс глубоких нейронных сетей, использующих механизм само-внимания (self-attention) для параллельной обработки последовательных данных и эффективного захвата длинных зависимостей. Архитектура была впервые представлена в статье «Attention Is All You Need» (2017) исследователями Google Brain[1]. С момента появления трансформеры стали основой большинства современных достижений в искусственном интеллекте, включая большие языковые модели (BERT, GPT-4, ChatGPT) и Vision Transformer (ViT)[2].

Общие сведения

| Модели на основе трансформеров | |

|---|---|

| англ. Transformer-based models | |

| Область использования | Машинное обучение, Обработка естественного языка |

| Дата появления | 2017 |

| Место появления | Google Brain |

| Автор понятия | Исследователи Google Brain |

Определение

Трансформерная модель — это нейронная сеть энкодер-декодерного типа, ключевыми особенностями которой являются:

- использование механизма само-внимания для вычисления значимости разных частей входной последовательности;

- полная параллельная обработка элементов, что резко ускоряет обучение по сравнению с RNN;

- позиционное кодирование, добавляющее информацию о порядке токенов, так как само-внимание не учитывает позицию явным образом[3].

Основное назначение трансформеров — преобразование одной последовательности в другую (many-to-many). Типичные задачи:

- Машинный перевод

- генерация текста (чат-боты, копирайтинг)

- суммаризация документов

- распознавание и синтез речи

- прогнозирование временных рядов[4]

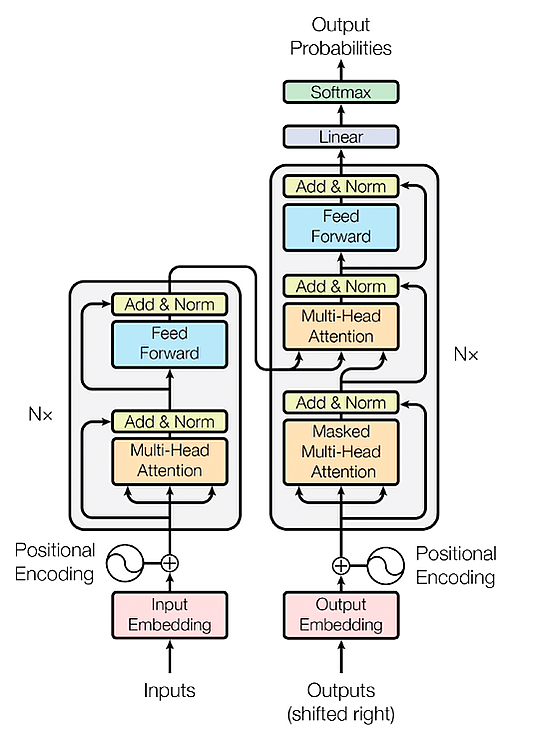

Структурные элементы моделей на основе трансформеров

Классическая архитектура, описанная в «Attention Is All You Need», включает следующие компоненты[1]:

- Входные эмбеддинги — преобразуют токены в векторы фиксированной размерности.

- Позиционные эмбеддинги — фиксированные или обучаемые векторы, добавляемые к входным эмбеддингам для кодирования порядка.

- Механизм само-внимания (Self-Attention)

- вычисляет три матрицы — Query, Key, Value — и оценивает релевантность каждого токена по отношению к остальным

- Multi-Head Attention параллельно запускает несколько «голов», что позволяет модели учитывать различные типы взаимосвязей

- Полносвязный блок Feed-Forward — две линейные проекции с нелинейностью ReLU, применяемые к каждому положению отдельно.

- Остаточные соединения (Residual) — упрощают распространение градиентов и стабилизируют обучение.

- Layer Normalization — нормализует активации после добавления остаточного сигнала.

- Блок энкодера — пакует многоголовочное само-внимание и Feed-Forward с нормализацией; в стек обычно входит 6-12 однотипных блоков.

- Блок декодера — содержит

- маскированное само-внимание (исключает «заглядывание» вперёд)

- внимание «энкодер-декодер»

- Feed-Forward слой, — также окружённые остаточными связями и нормализацией[2]

Этапы обучения и дообучения

Обучение и адаптация моделей на основе трансформеров включает несколько последовательных этапов, каждый из которых играет ключевую роль в достижении высокой производительности на различных задачах.

На этом этапе модель обучается на огромном неразмеченном корпусе текстов, решая самоконтролируемые задачи, такие как предсказание следующего слова или маскированное моделирование токенов. Это позволяет модели усвоить общие языковые закономерности и сформировать универсальные представления[5].

На втором этапе параметры предобученной модели адаптируются к конкретной задаче с помощью обучения на сравнительно небольшом размеченном датасете. Fine-tuning позволяет модели специализироваться под нужды пользователя или отрасли[6][7].

Этот этап включает методы, позволяющие эффективно адаптировать большие трансформерные модели к новым задачам с минимальными вычислительными затратами и потреблением памяти. К основным подходам относятся:

- Adapter-tuning — обучение небольших модулей-адаптеров, вставляемых между слоями трансформера, при этом остальные веса модели остаются замороженными[8]

- Prompt-tuning — добавление обучаемых «мягких» промптов к входу модели, при этом параметры самого трансформера не изменяются[9]

Такие методы радикально снижают вычислительные затраты и потребность в памяти при адаптации моделей[10].

Преимущества и недостатки

- Параллельная обработка последовательности — высокая скорость обучения на GPU/TPU

- Улавливание дальних зависимостей без проблем затухающего градиента, характерных для RNN[4]

- Гибкость: одна и та же базовая модель переносится на множество задач посредством fine-tuning

- Масштабируемость — качество моделей растёт почти линейно с увеличением параметров и данных[11]

- Более стабильное обучение благодаря остаточным связям и Layer Norm

- Высокие вычислительные и энергетические затраты на обучение крупных моделей

- Требовательность к объёму данных: без больших корпусов качество падает

- Ограниченное контекстное окно, за пределами которого информация «забывается»

- Сложность интерпретации решений модели

- Риск «галлюцинаций» — генерации недостоверного контента языковыми моделями[12]

Сферы применения

- Обработка естественного языка — машинный перевод, суммаризация, диалоговые системы, анализ тональности

- Компьютерное зрение — классификация, сегментация и генерация изображений моделями ViT, DALL-E, Stable Diffusion[13]

- Обработка речи и аудио — ASR, TTS, музыкальная генерация[3]

- Биоинформатика — предсказание структуры белков и анализ геномных последовательностей[14]

- Прогнозирование временных рядов и рекомендательные системы

- Мультимодальные системы — объединение текста, изображений и звука в единой модели

Инструменты и фреймворки для моделей на основе трансформеров

- Hugging Face Transformers — библиотека с тысячами предобученных моделей и высоким уровнем API (pipeline, Trainer)[15]

- PyTorch — фреймворк с динамическими вычислительными графами и модулем torch.nn.Transformer

- TensorFlow / Keras — высокоуровневый API, поддержка экспорта в TFLite для мобильных устройств

- JAX — JIT-компиляция и автоматическое дифференцирование для TPU

- DeepSpeed — библиотека оптимизации и распределённого обучения крупных моделей (ZeRO, квантование)[16]

- Megatron-LM — фреймворк NVIDIA для масштабного обучения GPT-, BERT-, T5-подобных моделей[17]

- Hugging Face Optimum — набор инструментов для аппаратно-специфичной оптимизации и экспорта в ONNX, TFLite и др[18]

- W&B, TensorBoard — отслеживание экспериментов и визуализация обучения[19]

Примечания

| Правообладателем данного материала является АНО «Интернет-энциклопедия «РУВИКИ». Использование данного материала на других сайтах возможно только с согласия АНО «Интернет-энциклопедия «РУВИКИ». |