Amazon SageMaker

Amazon SageMaker — полностью управляемый сервис компании Amazon Web Services (AWS), предназначенный для упрощения и ускорения всего жизненного цикла машинного обучения (ML) — от подготовки данных и разработки моделей до их развёртывания, мониторинга и управления в промышленной среде[1]. Платформа автоматизирует трудоёмкие задачи, такие как создание обучающих наборов данных, выбор алгоритмов, настройка гиперпараметров и масштабирование инфраструктуры, что позволяет разработчикам и исследователям быстрее создавать и внедрять модели[2].

Что важно знать

| Amazon SageMaker | |

|---|---|

| Тип | Управляемый облачный сервис машинного обучения |

| Разработчик | Amazon Web Services |

| Операционная система | Кроссплатформенный веб-сервис |

| Языки интерфейса | Английский и другие |

| Первый выпуск | 29 ноября 2017 года |

| Состояние | Активно разрабатывается и обновляется |

| Лицензия | Проприетарная (с поддержкой компонентов с открытым исходным кодом) |

| Сайт | aws.amazon.com/sagemaker |

Определения

- AutoML (Automated Machine Learning) — набор инструментов и методов, автоматизирующих процесс создания моделей машинного обучения: от предобработки данных до выбора лучших алгоритмов и настройки гиперпараметров.

- Эндпоинт API (endpoint, конечная точка) — конкретный URL-адрес (например, https://api.example.com/users), по которому клиентское приложение обращается к серверу для выполнения действий или получения данных.

- Serverless Inference (бессерверный вывод/инференс) — модель развертывания и использования моделей машинного обучения (ML) и искусственного интеллекта (ИИ), при которой облачный провайдер автоматически управляет всей инфраструктурой: выделением серверов, масштабированием и остановкой ресурсов.

- SDK (Software Development Kit) — набор инструментов для разработки программного обеспечения, предоставляемый разработчикам для создания приложений под определенную платформу, язык программирования или сервис.

- MLOps (Machine Learning Operations) — культура и набор практик, объединяющий разработку (Data Science) и эксплуатацию (DevOps) моделей машинного обучения.

- Feature Store (хранилище признаков) — централизованная платформа для хранения, управления, трансформации и предоставления признаков (фич) для ML-моделей.

Функции

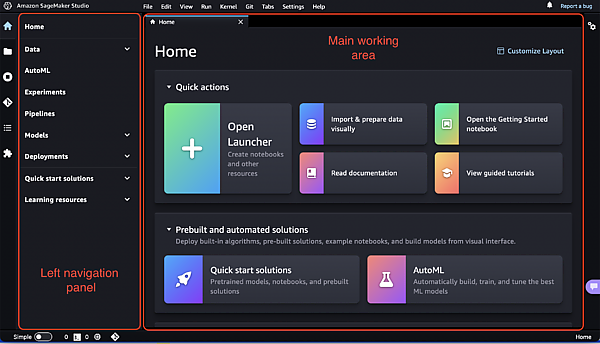

Amazon SageMaker представляет собой набор взаимосвязанных инструментов, объединённых в единую облачную платформу. Ключевая особенность сервиса — возможность работать с полным циклом ML из одного веб-интерфейса SageMaker Studio или через Python SDK[3].

Основные компоненты SageMaker условно делятся на пять групп:

- инструменты подготовки данных

- SageMaker Data Wrangler — визуальная подготовка и трансформация наборов данных без написания кода

- SageMaker Ground Truth — создание обучающих выборок с помощью ручной и автоматизированной разметки[3]

- инструменты построения и обучения моделей

- встроенные алгоритмы и поддержка фреймворков (TensorFlow, PyTorch и др.)

- SageMaker Autopilot — AutoML-служба для автоматического подбора моделей

- Hyperparameter Tuning — автоматическая оптимизация гиперпараметров

- SageMaker Experiments и Debugger — управление серией экспериментов и отладкой[1]

- инструменты обеспечения ответственности моделей

- SageMaker Clarify — выявление предвзятости и объяснимость прогнозов[4]

- инструменты развёртывания и MLOps

- одно-кликовое развёртывание на управляемые энд-поинты

- SageMaker Model Monitor и Edge Manager

- бессерверный вывод (Serverless Inference) и автоматическое масштабирование

- инструменты продуктивной разработки и обмена

- SageMaker Feature Store

- SageMaker Pipelines

- реестр моделей (Model Registry)

- JumpStart с готовыми моделями и решениями

Жизненный цикл модели в Amazon SageMaker обычно проходит через несколько последовательных этапов.

На этом этапе осуществляется импорт данных из Amazon S3 или сторонних источников, их очистка и обогащение с помощью инструмента Data Wrangler. Это позволяет привести данные к единому формату, устранить пропуски и аномалии, а также подготовить их для последующей разметки и обучения.

Если задача требует наличия размеченных данных, используется SageMaker Ground Truth для создания высококачественных меток. Разметка может выполняться вручную, с помощью автоматизированных инструментов или с привлечением внешних подрядчиков.

Разработка и обучение модели происходят в среде SageMaker Studio или Jupyter Notebook. Пользователь выбирает подходящий алгоритм или фреймворк (например, TensorFlow, PyTorch), настраивает параметры и запускает тренировку на распределённых кластерах, что обеспечивает масштабируемость и ускоряет процесс обучения.

Для повышения качества модели применяется автоматическая настройка гиперпараметров с помощью Hyperparameter Tuning или AutoML-службы SageMaker Autopilot. Эти инструменты автоматически подбирают оптимальные конфигурации, что позволяет добиться лучших результатов без ручного перебора параметров.

На данном этапе проводится оценка качества модели и её отладка. SageMaker Experiments фиксирует параметры и результаты различных запусков, а Debugger собирает метрики и предупреждает о возможных проблемах в процессе обучения, таких как переобучение или неэффективное использование ресурсов.

После успешного обучения модель развёртывается как API-эндпойнт для онлайн-инференса или в виде пакетной джобы для пакетной обработки данных. Также доступен вариант бессерверного вывода (Serverless Inference), что позволяет автоматически масштабировать ресурсы в зависимости от нагрузки.

На финальном этапе осуществляется мониторинг работы модели и управление её жизненным циклом. SageMaker Model Monitor отслеживает дрейф данных и производительность модели, Clarify проверяет отсутствие предвзятости в прогнозах, а Edge Manager обеспечивает распространение обновлений на периферийные устройства[5].

- В отличие от Azure Machine Learning, SageMaker предлагает интегрированный Feature Store и JumpStart с готовыми базовыми моделями, что сокращает время начала проекта[1].

- От Google Vertex AI сервис отличает поддержка бессерверного вывода и Edge Manager для управления устройствами на периферии[2]. Vertex AI считается более оптимизированным и унифицированным (Unified AI Platform), в то время как SageMaker — это набор инструментов для тонкой настройки. Vertex AI проще в развертывании моделей.

- По сравнению с самостоятельным развёртыванием в кластере Kubernetes SageMaker устраняет необходимость в управлении инфраструктурой и предоставляет оплату «по факту использования».

- Databricks часто выигрывает в задачах подготовки данных (data engineering) и совместной работе над Spark-задачами, предлагая более унифицированный опыт, чем раздельные инструменты AWS.

- Azure ML имеет лучшую интеграцию с корпоративными сервисами Microsoft и часто предпочтительнее для компаний, уже работающих в экосистеме MS.

Преимущества

- Полностью управляемая инфраструктура и «одно-кликовое» развёртывание моделей[2].

- Богатый набор специализированных инструментов (Data Wrangler, Clarify, Pipelines, Feature Store) в едином интерфейсе[3].

- Гибкое ценообразование с возможностью бессерверного инференса и автоматического масштабирования.

Недостатки

- Проприетарность платформы и зависимость от экосистемы AWS.

- Возможные затраты при длительных экспериментах с большими кластерами GPU.

- Ограниченная кастомизация среды по сравнению с собственными кластерами Kubernetes[5].

- SageMaker часто критикуют за перегруженность интерфейса и сложность настройки. В отличие от более унифицированного Google Cloud Vertex AI, SageMaker требует глубоких знаний инфраструктуры AWS.

- Рабочие процессы обучения и вывода моделей могут быть запутанными, что затрудняет диагностику ошибок.

- Платформа тесно интегрирована с экосистемой AWS. Перенос решений на другую облачную платформу требует значительной переработки кода.

- SageMaker может быть дороже конкурентов, особенно для небольших проектов, из-за почасовой оплаты управляемых инстансов и дополнительных сервисов (S3, ECR).

- С марта 2022 года Amazon прекратила регистрацию новых клиентов из России и Беларуси, что делает использование официальных сервисов невозможным для новых проектов в этих регионах.

SageMaker используется в различных отраслях:

- обработка медицинских изображений и улучшение клинических процессов в здравоохранении;

- детектирование мошеннических операций и прогнозирование денежных потоков в финансовом секторе;

- персонализированные рекомендации и борьба с мошенничеством в электронной коммерции;

- оптимизация маршрутных сетей и обслуживания авиаперевозок;

- генеративный ИИ и обработка естественного языка.

- SageMaker Studio — полнофункциональная IDE для всего цикла ML.

- SageMaker Studio Lab — отдельный бесплатный продукт для обучения и экспериментов; не требует аккаунта AWS[6].

- Python SDK под лицензией Apache 2.0 для программного управления всеми возможностями сервиса[7].

- SageMaker Pipelines — визуальная и кодовая оркестрация MLOps-конвейеров.

- Processing Jobs — масштабируемые задания для пред- и постобработки данных.

- Feature Store — хранилище признаков с он-лайн и офф-лайн зонами.

- Model Registry — централизованное хранилище артефактов моделей и их версий.

Примеры использования

- 3M применяет SageMaker для разработки моделей, повышающих точность диагностики и оптимизирующих клинические процессы.

- C2FO строит модели выявления мошенничества и прогнозирования денежного потока, ускоряя финансовые операции.

- United Airlines прогнозирует задержки рейсов и оптимизирует управление расписанием.

- Zola использует сервис для персонализированных рекомендаций товаров и обнаружения мошенничества, повышая конверсию онлайн-платформы.

- Vevo применяет SageMaker для рекомендаций музыкальных видео и оптимизации рекламной монетизации.

Примечания

| Правообладателем данного материала является АНО «Интернет-энциклопедия «РУВИКИ». Использование данного материала на других сайтах возможно только с согласия АНО «Интернет-энциклопедия «РУВИКИ». |