Влияние искусственного интеллекта на рабочее место

Влияние искусственного интеллекта на рабочее место (англ. impact of artificial intelligence on workers) — тема, охватывающая как применения искусственного интеллекта (ИИ) для повышения безопасности и здоровья работников, так и новые профессиональные риски, требующие контроля. Широкое внедрение ИИ во многих отраслях связано с возможностями автоматизации опасных задач, предотвращения травм и профессиональных заболеваний, повышением эффективности, но одновременно порождает психосоциальные и организационные проблемы, включая вопросы приватности, надзора и смещения необходимых компетенций[1].

ИИ может использоваться для устранения источников профессиональных рисков путём дистанцирования человека от опасных условий труда, мониторинга и прогнозирования состояния работников, автоматизации рутинных операций и совершенствования программ обучения с помощью виртуальной реальности. Вместе с тем, ИИ способен создавать новые опасности, связанные с непредсказуемым поведением алгоритмов, вопросами кибербезопасности и приватности данных, а также усиления надзора и изменения организации труда[2]. По оценкам ряда экспертов, ИИ также выступает одной из причин сокращения рабочих мест в ряде сфер экономики[3].[4]

Применение для обеспечения безопасности и здоровья

Эффективное внедрение ИИ в процессы охраны труда возможно только с поддержкой как руководства, так и самих работников[5]. Настороженность работников могут вызывать проблемы информационной приватности[6], недостаточная прозрачность работы систем или отсутствие обучения при внедрении новых технологий[7].:26–28, 43–45 Менеджеры, в свою очередь, могут фокусироваться на повышении производительности, а не на улучшении условий труда[8].

ИИ способен увеличить число рабочих операций, от которых человек может быть полностью освобождён[9]. Если традиционная автоматизация заменяет телесные функции работника, то ИИ способен подменять интеллектуальные функции. К числу рисков, которые могут быть устранены, относятся стресс, переработки, профессиональные заболевания опорно-двигательного аппарата, монотонность[2].:5–7

В отличие от прежней автоматизации, распространившейся в промышленности, современные системы ИИ проникают и в сферы умственного и сервисного труда: медицину, финансы, ИТ[10]. К примеру, операторы колл-центров испытывают высокие нагрузки и подвергаются микроскопическому надзору; автоматизация ИИ решает одну из основных проблем, устраняя необходимость ручной обработки типовых заявок[2].:5–7

Технологии машинного обучения применяются для управленческой аналитики, прогнозирования поведения сотрудников и оценки продуктивности, что может использоваться не только для нужд менеджмента, но и для профилактики профессиональных заболеваний. Анализ основан на данных сетевой активности, мониторинге коммуникаций, геолокации, анализе голоса и языка тела во время интервью. Например, анализ настроений (sentiment analysis) помогает выявлять признаки усталости для предотвращения переутомления[2]:3–7 Аналитические и экспертные системы также используются для анализа причин аварий, скорейшего реагирования на чрезвычайные ситуации.[12].

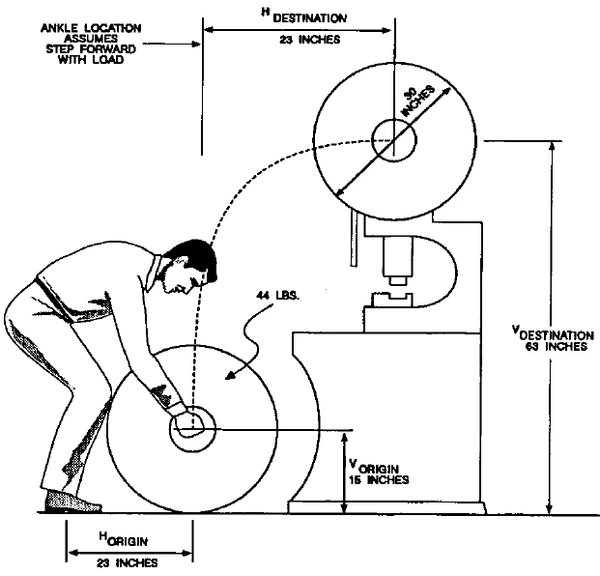

Для работников, выполняющих тяжёлые физические задачи, ИИ и предиктивная аналитика позволяют выявлять индивидуальные риски травматизации, основываясь на показаниях потоковых данных носимых сенсоров[6].

Носимые устройства с поддержкой ИИ также дают возможность ранней профилактики воздействия токсичных веществ. Обработка больших массивов данных позволяет совершенствовать системы производственного мониторинга и оценку профессиональных рисков[12].

ИИ используется и для оптимизации рабочих процессов по обеспечению безопасности и здоровья[13]. Виртуальные ассистенты (например, Amazon Alexa, Google Assistant, Apple Siri) автоматизируют рутинные задачи, способствуя высвобождению трудовых ресурсов для более сложной деятельности[14]. Однако интеграция подобных решений осложняется проблемами приватности и корректности работы[14]

Пример: автоматизация процессов кодирования заявок на выплаты по травмам, поступающих в виде неструктурированного текста. ИИ позволяет ускорить и удешевить обработку, снизить число ошибок.[15].[16]

Виртуальная реальность с поддержкой ИИ также может использоваться для тренингов по выявлению опасных ситуаций[12].

ИИ способствует более эффективной фиксации и анализу ситуаций, едва не приведших к аварии (near miss), что важно для снижения аварийности[17].

Риски

Ключевые риски связаны не с наличием ИИ само по себе, а с особенностями внедрения и контроля[2]:2–3

Системы, основанные на подсознаковом (sub-symbolic) ИИ, например, на машинном обучении, склонны к непредсказуемости и т. н. «чёрному ящику» в принятии решений, особенно в ситуациях вне обучающей выборки или недостаточно структурированной среды. Опасные последствия возникают из-за дефектов восприятия, некорректного представления знаний, ошибок программирования.[7].:14–18 Ошибки в данных обучения или превышение зоны действия алгоритмов приводят к дополнительным рискам[2]:12–13 Символические ИИ в меньшей степени подвержены описанным проблемам.[7].:14–18

Внедрение ИИ также увеличивает киберриски (например, внедрение вредоносных программ или утечку данных) и вызывает опасения работников по поводу безопасности личной информации[6].

Психосоциальные риски обусловлены тем, как проектируется, организуется и управляется труд, а также социальными и экономическими условиями. Такие риски приводят не только к психическим, но и к физическим последствиям — от профессионального выгорания и депрессии до сердечно-сосудистых и мышечных заболеваний[18]. Психосоциальные последствия ИИ часто не получают должного внимания на этапе проектирования, несмотря на влияние на изменение организационной структуры и взаимодействия факторов[8].

Исследования показывают, что успешная интеграция ИИ требует осознанного подхода и участия работников. Авторы отмечают опасность безусловного технологического оптимизма и необходимость учёта особенностей конкретных трудовых экосистем при разработке и внедрении ИИ[19].[20]

Внедрение ИИ требует новых навыков от работников и готовности к переобучению[1]. При этом сочетание традиционной компетентности с компьютерными навыками становится отдельной сложностью[8]. Опережающее автоматизация способно привести к деградации профессиональных навыков[12]

Распространение ИИ среди поколений Z и миллениалов сопровождается снижением межличностных коммуникаций на рабочем месте и опасностями размывания командного взаимодействия.[21].[22][23]

Рост мониторинга приводит к стрессу, ощущению тотального контроля и развитию микроменеджмента[24]. Использование сенсоров, трекеров и систем дополненной реальности может вызывать дополнительное психическое напряжение, особенно у работников сервисной экономики и временных контрактников[2]:2–10

ИИ влияет на структуру принятия решений и общее распределение власти в организации. Научные исследования подчеркивают необходимость осознанного внедрения, учитывающего социальные эффекты.[25]. Ещё один риск — принуждение работников к работе по непривычному графику, синхронизированному с роботами или алгоритмами[2]:5–7

Алгоритмы, обученные на исторических данных, могут тиражировать дискриминацию — например, в кадровых решениях.[2]:3–5 Дизайн систем принятия решений порождает информационное неравенство между менеджером и сотрудником, вызывающее стресс.

Предвзятость может быть как неосознанной (разработчики не замечают зависимости), так и целенаправленной, если метрики подбираются в пользу определённых групп.[2]:12–13 Оценка происшествий также может смещаться в пользу защиту ИИ и переносить ответственность за ошибки на человека.[12]

Физические опасности связаны с риском столкновений между людьми и роботами, работающими на основе ИИ, особенно когда речь идёт о совместных (коллаборативных) роботах — коботах.[26]. В отличие от обычных промышленных роботов, коботы работают в непосредственной близости от людей, что исключает классические методы безопасности (ограждения, заграждения)[7]:5, 29–30 Для таких систем выход из строя датчика или необычная среда могут привести к потере контроля над движением.[2]:5–7

Ещё один пример — автомобили с автопилотом и эргономические риски интерфейсов взаимодействия человек–машина.[8]

Контроль и снижение рисков

Для предотвращения киберугроз и вторжений ИИ требует внедрения мер кибербезопасности,[7]:17 а также политики приватности.[6] Прозрачная коммуникация относительно использования персональных данных снижает психосоциальные риски.[6] Лучшей практикой признаётся добровольность работы с датчиками, прекращение сбора данных вне рабочего времени, открытое информирование работников и надёжное хранение информации.[12]

Международная организация по стандартизации (ISO) рекомендует для промышленных коботов с ИИ: контролируемую остановку, ручное управление, контроль скорости и разделения зон, ограничение мощности.[12] Сетевые коботы могут обмениваться информацией о ЧП для повышения безопасности всей системы. Ещё одной мерой контроля является человеческий надзор.[2]:12–13

Управление профессиональными рисками

Все ИИ-приложения и порождаемые ими опасности могут быть интегрированы в существующие отраслевые модели управления рисками труда. Ранняя идентификация рисков наиболее эффективна на этапе проектирования.[8]

В задачах профмониторинга недостаточная детализация агрегированных трудовых данных и акцент на экономических параметрах усложняют учёт реальных изменений риска ввиду внедрения ИИ. Универсальные классификаторы, такие как система O*NET в США, помогают анализировать состав навыков — однако глобальной картины нет.[10].

Использование ИИ в производстве ставит ряд этических вопросов: приватность, справедливость, защиту достоинства и обеспечение прозрачности. ОЭСР отмечает необходимость строгого регулирования, прозрачных политик в отношении использования данных и алгоритмической объяснимости[27].

Стандартизация и регулирование

По состоянию на 2019 год ISO разрабатывала стандарт, рекомендующий применять панели мониторинга и метрики для контроля состояния производства и персонала. В нём предусматриваются правила сбора и представления информации[2]:11[28].[29]

В Европейском союзе Общий регламент по защите данных (GDPR) распространяется и на рабочую сферу, предоставляя работникам право не быть объектом полностью автоматических решений. Дополнительные положения содержатся в директивах по безопасности машин, радиооборудованию и стандартам товарной безопасности[2]:10, 12–13

США: Национальная конференция законодательных собраний отмечает, что федеральные и региональные власти уделяют всё больше внимания регулированию трудовых отношений с элементами ИИ: контролю над мониторингом, устранению предвзятости, переквалификации и равнодоступности новых технологий.[30].