FastText

FastText — открытая и легковесная библиотека для задач обработки естественного языка (NLP), разработанная подразделением Facebook AI Research (FAIR)[1]. Она предназначена для эффективного обучения векторных представлений слов и решения задач классификации текста, оставаясь масштабируемой даже при работе с многомиллионными корпусами[2].

Что важно знать

| FastText | |

|---|---|

| Тип | Библиотека обработки естественного языка |

| Разработчик | Facebook AI Research |

| Состояние | Активно разрабатывается и обновляется |

| Лицензия | Бесплатное программное обеспечение с открытым исходным кодом |

| Сайт | fasttext.cc |

Определения

- CBOW (Continuous Bag of Words, Непрерывный мешок слов) — один из двух основных алгоритмов обучения векторных представлений слов (word embeddings), который предсказывает целевое слово на основе окружающего его контекста.

- Skip-gram — один из двух основных алгоритмов (архитектур) обучения векторных представлений слов (word embeddings), который предсказывает окружающие слова (контекст) на основе текущего центрального слова.

- Softmax — функция активации (или метод оптимизации), используемая на выходном слое модели для преобразования числовых выходов (логитов) в вероятностное распределение классов. Она позволяет модели классификации определить, к какому из возможных классов с наибольшей вероятностью относится текст.

- Subword (подслово) — представление слов не как атомарных единиц (целых слов), а через комбинацию их частей — символьных n-грамм (цепочек символов).

- Эмбеддинг (embedding) — это плотное векторное представление слов (числовой вектор фиксированного размера), которое, в отличие от Word2Vec, строится не только на основе самого слова, но и на основе его подслов (n-gramm).

Функции

FastText сочетает высокую скорость работы с качеством моделей, предлагая разработчикам следующие ключевые возможности:

- Обучение векторных представлений слов — библиотека поддерживает архитектуры CBOW и Skip-gram, формируя высококачественные эмбеддинги слов, отражающие их семантические и синтаксические связи[3].

- Поддержка субслов (Subword Information) — каждое слово представляется как набор символьных N-грамм, что позволяет модели строить осмысленные векторы для неизвестных слов и лучше учитывать морфологические особенности языков[3][4].

- Классификация текста — FastText применяет иерархический softmax для ускорения обучения в задачах с большим числом классов, обеспечивая высокую точность и скорость в таких областях, как обнаружение спама, анализ тональности и тематическая классификация[5][6].

- Масштабируемость — благодаря эффективной реализации на многоядерных процессорах библиотека способна обучаться на корпусах из миллиардов слов за считанные минуты[7].

Ограничения

- Отсутствие контекстуального представления. FastText создает статические эмбеддинги (векторы) для слов, то есть слово всегда имеет один и тот же вектор, независимо от контекста, в котором оно употребляется.

- Игнорирование порядка слов. В задачах классификации FastText часто использует «мешок слов» (bag of words) с N-граммами, что означает потерю информации о точном порядке слов, что может быть критично для понимания смысла некоторых фраз.

- Ограниченная семантика. Из-за своей легковесности и простоты алгоритм уступает более сложным трансформерным моделям (например, BERT) в задачах, требующих глубокого понимания контекста и семантических связей.

- Чувствительность к предварительной обработке. Качество модели сильно зависит от очистки данных (удаление тегов, нижний регистр, убрание знаков пунктуации).

- Ограничение на размер словаря. В практических реализациях могут существовать ограничения на общее число векторов (например, лимиты на словарь n-грамм) для управления потреблением памяти.

Примеры использования

FastText находит применение в различных прикладных задачах:

- Определение языка текста — предварительно обученные модели FastText распознают до 217 языков и используются для автоматической маршрутизации многоязычного контента, улучшения машинного перевода и модерации пользовательских сообщений.

- Анализ тональности — при классификации отзывов о товарах FastText достигал точности свыше 92 % на корпусе из 3,6 млн записей Amazon[8]. Библиотека также комбинируется с моделями BERT и Attention-механизмами для повышения качества анализа коротких сообщений[9].

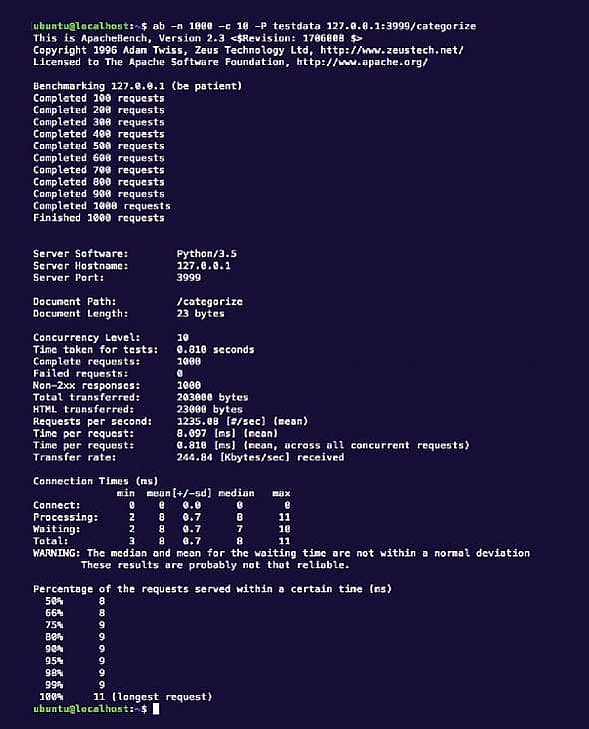

- Тематическая классификация документов — FastText используется для автоматической категоризации новостных статей, писем или пользовательских запросов, эффективно обрабатывая большие массивы текстов и широкий набор категорий[10][11].

Примечания

| Правообладателем данного материала является АНО «Интернет-энциклопедия «РУВИКИ». Использование данного материала на других сайтах возможно только с согласия АНО «Интернет-энциклопедия «РУВИКИ». |