Закон масштабирования нейронных сетей

Закон масштабирования нейронных сетей — это эмпирический статистический закон, описывающий, как изменяется производительность нейронных сетей при масштабировании ключевых факторов, таких как число параметров, размер обучающей выборки и стоимость обучения[1]. Некоторые модели также демонстрируют улучшение качества за счёт масштабирования вычислений на этапе вывода (инференса), что расширяет применение закона масштабирования на стадию использования модели[2].

Введение

В общем случае модель глубокого обучения можно охарактеризовать четырьмя параметрами: размер модели, размер обучающей выборки, стоимость обучения и ошибка (например, ошибка на тестовой выборке). Обычно эти параметры обозначают как (соответственно: число параметров, размер датасета, вычислительные затраты и потери).

Закон масштабирования нейронных сетей — это теоретическая или эмпирическая статистическая закономерность между этими параметрами. Существуют и другие параметры с отдельными законами масштабирования.

В большинстве случаев размер модели определяется как общее число её параметров. Однако при использовании разреженных моделей, таких как модели смеси экспертов[3], во время инференса используется лишь часть параметров модели. В то же время большинство других видов нейросетей, например, трансформеры, используют все параметры при инференсе.

Размер обучающей выборки обычно определяется числом её элементов. Более крупные выборки предпочтительны, поскольку предоставляют больший и разнообразный объём информации для обучения модели, что способствует лучшей обобщающей способности на новых данных[4]. Однако увеличение размера выборки увеличивает затраты времени и вычислительные ресурсы при обучении.

При использовании многослойного этапа обучения — «предобучение и дообучение» (основной способ для больших языковых моделей), различают обучающую выборку для стадии предобучения и для стадии дообучения. Их размеры по-разному влияют на производительность: как правило, дообучающий датасет составляет менее 1 % размера основного[5].

В некоторых случаях для дообучения достаточно небольшого, но высокого качества набора данных, и увеличение объёма не приводит к дальнейшему приросту качества[5].

Стоимость обучения определяется затраченным временем и вычислительными ресурсами (мощностью процессоров и объёмом памяти). Эта стоимость может быть существенно снижена за счёт эффективных алгоритмов, оптимизированных библиотек и применения параллелизма на специализированном оборудовании (например, GPU или TPU).

Величина затрат зависит от размера модели, размера выборки, сложности обучающего алгоритма и имеющихся ресурсов[4]. При этом удвоение размера выборки не означает двукратное увеличение стоимости обучения, поскольку часто модель обучают на множестве эпох по одной и той же выборке.

Производительность нейросети оценивается её способностью правильно предсказывать ответы по входным данным. К распространённым метрикам относят[4]:

- Отрицательное логарифмическое правдоподобие на токен (логарифм perplexity) для языкового моделирования;

- Точность, прецизионность, полнота и F1-мера для классификации;

- Среднеквадратичная ошибка (MSE) или средняя абсолютная ошибка (MAE) для регрессии;

- Рейтинг Эло в соревновании с другими моделями, например, в играх[8] или через предпочтения человека[9].

Производительность можно повысить использованием большего объёма данных, увеличением размера модели, изменением алгоритмов, регуляризацией для предотвращения переобучения, а также ранней остановкой по валидационной выборке.

Если метрика ограничена диапазоном , например точность, часто наблюдается сигмоидальная зависимость от затрат ресурсов.

Примеры

Работа 2017 года[1] стала отправной точкой для изучения закона масштабирования на экспериментальных данных. Предыдущие исследования (до 2000-х) были преимущественно теоретическими или маломасштабными. Если раньше считалось, что экспонента масштабирования принимает значения , в этой работе установлено диапазон .

Изучалась зависимость ошибки от размера выборки и архитектур, а также требуемое число параметров для достижения минимальных потерь при фиксированной выборке. Были проанализированы задачи машинного перевода с LSTM (), генеративное языковое моделирование (), классификация ImageNet с ResNet () и распознавание речи с гибридными архитектурами ().

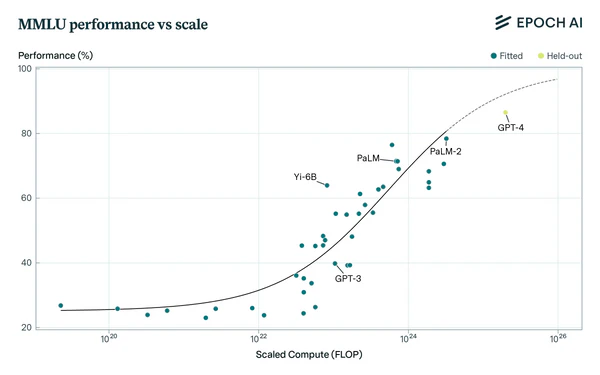

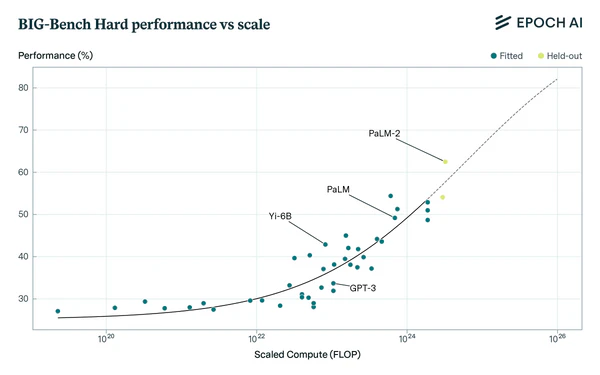

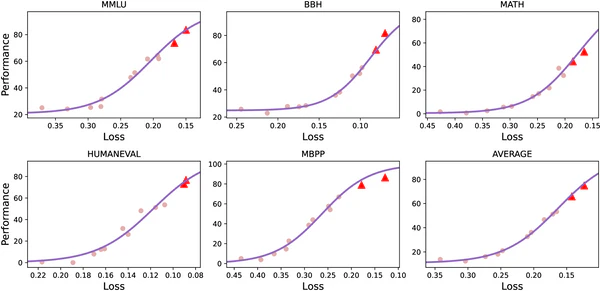

В 2020 году[10] была проведена комплексная оценка статистических взаимосвязей между для различных масштабов и модальностей (текст, видео, изображения и др.).

Основные эмпирические закономерности (см. Таблицу 1 в[10]):

- При фиксированной одной из величин ( или ) и варьировании другой (с ), достигаемая ошибка приближается функцией , где — изменяемый параметр.

- При варьировании экспонента составляет — (зависит от модальности), при варьировании — —.

- Оптимальное число параметров при фиксированном бюджете вычислений:

Закон масштабирования подтверждён при обучении GPT-3[11].

Особый закон масштабирования, называемый «Chinchilla scaling», формулирует зависимость для языковых автогенеративных моделей, обучаемых одной эпохой и со специальным расписанием скорости обучения[13]:

- — вычислительные затраты (FLOP).

- — число параметров.

- — число токенов в обучающем наборе.

- — средние потери по негативному логарифму правдоподобия на токен.

- Константы: (оценка затрат на обучение одного токена на один параметр), , , , , . Альтернативные оценки см. в[14].

Законы были аппроксимированы по данным для диапазонов .

Решая оптимизационную задачу при фиксированном , получаем оптимальные и минимальные потери:

| / FLOP | / FLOPs Gopher | ||

|---|---|---|---|

| 400 млн | 1.92e+19 | 1/29968 | 8.0 млрд |

| 1 млрд | 1.21e+20 | 1/5706 | 20.2 млрд |

| 10 млрд | 1.23e+22 | 1/2819 | 205.1 млрд |

| 67 млрд | 5.76e+23 | 1 | 1.5 трлн |

| 175 млрд | 3.85e+24 | 6.7 | 3.7 трлн |

| 280 млрд | 9.90e+24 | 17.2 | 5.9 трлн |

| 520 млрд | 3.43e+25 | 59.5 | 11.0 трлн |

| 1 трлн | 1.27e+26 | 221.3 | 21.2 трлн |

| 10 трлн | 1.30e+28 | 22515.9 | 216.2 трлн |

Закон Chinchilla для языковых моделей трансформер рекомендует, чтобы при заданном бюджете вычислений оптимально пропорционально масштабировать число параметров и число обучающих токенов : . Это отличается от вывода Kaplan и соавторов[15], утверждавших, что нужно увеличивать быстрее, .

Различия частично связаны с тем, что Kaplan и др. не учитывали параметры в эмбеддинговом слое, рассматривали меньшие модели и предполагали нулевые асимптотические потери[16]. Влияет также настройка гиперпараметров[17].

Chinchilla scaling долгое время был ориентиром при обучении крупных моделей, однако в последние годы исследуют, как выйти за его пределы, например, увеличив экспоненту в законе масштабирования за счёт фильтрации данных[18].

Существуют исследования по масштабированию при ограниченных данных (например, для малых языков), когда приходится обучать несколько эпох на одном датасете[19][20]. Серия моделей Phi обучалась на книжных данных, генерируемых языковыми моделями, и объём таких данных ограничен только доступными вычислениями[21].

Chinchilla-оптимальность определяется только вычислительными затратами во время обучения, но в прикладных моделях часто существенно более важна фаза инференса. Перетренированием моделей достигается лучший итоговый результат[22][23].

Исследование 2022 года[24] показало, что во многих задачах масштабирования формула зависимости метрики качества от масштаба примыкает к т. н. «разрывно степенному закону» (broken power law), причём на графике в логарифмических координатах видна серия линейных участков с переходами.

Эта зависимость наблюдается для моделей компьютерного зрения, обработки текста, аудио, видео, диффузионных и генеративных моделей, многомодальных и др. На практике такая форма хорошо аппроксимирует результаты для различных архитектур: остаточные сети, трансформеры, многослойные перцептроны, сверточные/рекуррентные/графовые сети, U-Net, энкодер-декодер и др.

Помимо увеличения вычислений при обучении, возможен рост вычислений на этапе инференса (т. н. test-time compute)[2]. Например, рейтинг Эло системы AlphaGo продолжает расти с увеличением времени, выделяемого на поиск решающего дерева на каждом ходе[25]. Для AlphaGo Zero увеличение рейтинга на 120 требует либо увеличения размера модели и затрат на обучение вдвое, либо удвоения вычислений при инференсе[26]. Аналогичные соотношения выявлены для навигационных задач, программирования и игр[27].

В докладе OpenAI o1 (2024) показано, что качество модели o1 растёт как от увеличения вычислений при обучении, так и от ростa вычислений при инференсе, включая задачи математики, научных рассуждений и программирования[28][29].

Существуют техники увеличения вычислений на инференсе: процессная супервизия (поэтапная генерация решения с промежуточными оценками), а также модели-ревизоры (многократная попытка решения с постоянным улучшением)[30].

Трансформеры для компьютерного зрения аналогично языковым демонстрируют законы масштабирования. В 2022 году были обучены трансформеры для изображений в диапазонах , , при TPUv3-ядро-дней[31]. Минимальная достигнутая ошибка для классификации ImageNet аппроксимируется: .

Ghorbani и др[32]. исследовали законы масштабирования для нейронного машинного перевода (английский → немецкий) на трансформерах энкодер-декодер. Установлено, что минимальные потери зависят не только от общего числа параметров, но отдельно от числа в энкодере и декодере. Для некоторых датасетов (\emph{source-natural}) достигалась преждевременная «насыщаемость» ошибки, а для \emph{target-natural} BLEU-скор и ошибки росли вместе.

Gordon и др[33]. обучали трансформеры в диапазоне и , подтвердив масштабирование по закону Каплана и др[15]..

Hernandez, Danny и др[34]. исследовали законы масштабирования в трансферном обучении языковых моделей. Доказано, что выигрыш от предобучения на смежном языке (например, английском для финетюна на Python) убывает с ростом размера собственной выборки и модели.

Kumar и др[35]. исследовали эффекты числовой точности при хранении весов и активаций: показано, что снижение разрядности экспоненциально снижает эффективную ёмкость модели. При инференсе переобученные модели чувствительнее к квантованию.

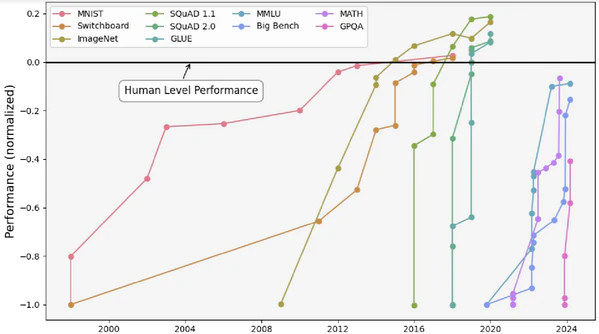

Xiao[7]. предложили классифицировать эволюцию моделей по эффективности использования параметров: новые архитектуры достигают заданного качества при всё меньшем числе параметров. Считается, что максимум отношения "эффективного" числа параметров к реальному экспоненциально возрастает с течением времени.

![{\displaystyle [0,1]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

![{\displaystyle [0.07,0.35]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/1cb4400d993e1d668d7b00f7ec7dae319d1fcec0)

![{\displaystyle \alpha \in [0.06,0.09],\beta \approx 0.7}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/4bef8231b219f0801f54e50e06213656bfe0cc48)

![{\displaystyle \alpha \in [0.3,0.5],\beta \approx 0.6}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/14fd488a05bac4c5cf1c755e95b0026e9167b146)

![{\displaystyle N\in [7\times 10^{7},1.6\times 10^{10}],D\in [5\times 10^{9},5\times 10^{11}],C\in [10^{18},10^{24}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/a39744e2650afd2025e5b27c5fe1b32bd590ccda)

![{\displaystyle N\in [5\times 10^{6},2\times 10^{9}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/c2c34f9a11c7be1cc45291df278795fabbf5e4ce)

![{\displaystyle D\in [3\times 10^{7},3\times 10^{9}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/97f383e55701f893beffd1f8f36df31b7879279f)

![{\displaystyle C\in [0.2,10^{4}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/7032ef6c8a553310bc6eb8ff6e4f7c21b01ee840)

![{\displaystyle N\in [4\times 10^{5},5.6\times 10^{7}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/53f03a244ba31aa72dc17110bcc8e354e9bf27de)

![{\displaystyle D\in [6\times 10^{5},6\times 10^{9}]}](https://ru.ruwiki.ru/api/rest_v1/media/math/render/svg/7494b9a10ae029f99b60c6f92c6532de5d5de5d9)